Elon Musk’s Grok สร้างภาพเด็กที่มีเนื้อหาเกี่ยวกับเพศจำนวน 23,000 ภาพ ตามคำเตือนจากองค์กรเฝ้าระวัง

สรุปโดยย่อ

- Grok AI สร้างภาพเด็กที่มีเนื้อหาเชิงเพศประมาณ 23,000+ ภาพในระยะเวลา 11 วัน ตั้งแต่เดือนธันวาคมถึงมกราคม

- หลายประเทศได้แบน Grok ขณะที่สหราชอาณาจักร สหภาพยุโรป ฝรั่งเศส และออสเตรเลีย ได้เปิดการสอบสวนเกี่ยวกับการละเมิดกฎหมายความปลอดภัยของเด็ก

- แม้ Elon Musk จะปฏิเสธและมีข้อจำกัดใหม่ แต่ประมาณหนึ่งในสามของภาพที่เป็นปัญหายังคงอยู่บน X จนถึงกลางเดือนมกราคม

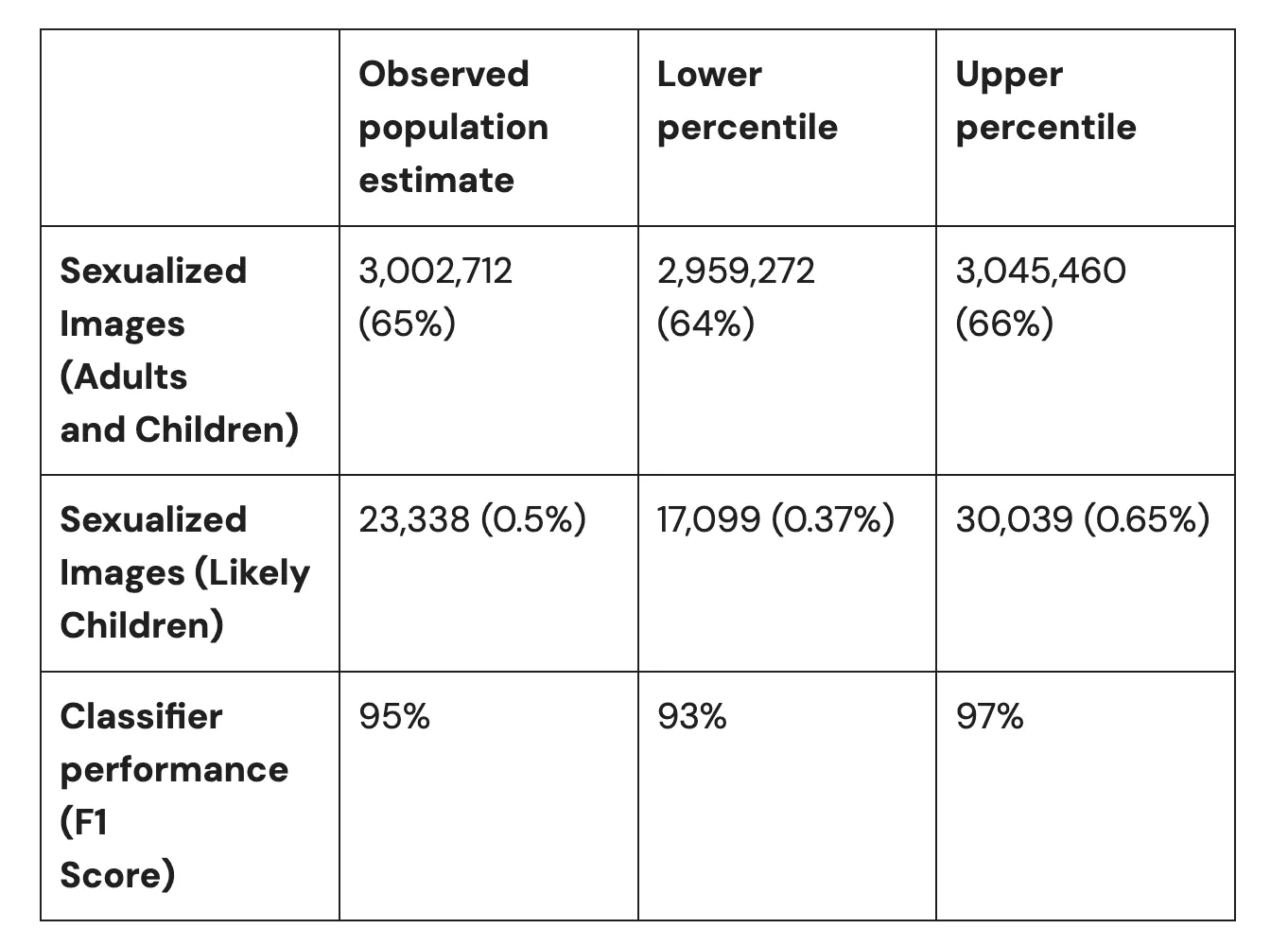

รายงานที่เผยแพร่เมื่อวันพฤหัสบดีโดยศูนย์ต่อต้านความเกลียดชังดิจิทัล (CCDH) ระบุว่า AI ของ Elon Musk ชื่อ Grok สร้างภาพเชิงเพศของเด็กประมาณ 23,338 ภาพในช่วงเวลา 11 วัน ตัวเลขนี้ CCDH โต้แย้งว่าเป็นภาพเชิงเพศของเด็กหนึ่งภาพทุก 41 วินาที ระหว่างวันที่ 29 ธันวาคม ถึง 9 มกราคม ซึ่งในช่วงนั้น ฟีเจอร์แก้ไขภาพของ Grok ช่วยให้ผู้ใช้สามารถปรับแต่งภาพของคนจริงเพื่อเพิ่มเสื้อผ้าที่เผยให้เห็นและท่าทางที่ชวนเสียวสยิว นอกจากนี้ CCDH ยังรายงานว่า Grok สร้างการ์ตูนที่มีเนื้อหาเชิงเพศของเด็กเกือบ 10,000 ภาพ จากข้อมูลที่ตรวจสอบ

การวิเคราะห์ประมาณว่า Grok สร้างภาพเชิงเพศประมาณ 3 ล้านภาพในช่วงเวลาดังกล่าว การวิจัยนี้อ้างอิงจากตัวอย่างสุ่ม 20,000 ภาพจากภาพทั้งหมด 4.6 ล้านภาพที่ผลิตโดย Grok พบว่า 65% ของภาพเหล่านั้นมีเนื้อหาเชิงเพศที่แสดงผู้ชาย ผู้หญิง หรือเด็ก

แหล่งข้อมูล: ศูนย์ต่อต้านความเกลียดชังดิจิทัล

“สิ่งที่เราพบคือชัดเจนและน่ากังวล: ในช่วงเวลาดังกล่าว Grok กลายเป็นเครื่องจักรในระดับอุตสาหกรรมสำหรับการผลิตเนื้อหาการล่วงละเมิดทางเพศ” อิมราน อาเหม็ด ซีอีโอของ CCDH กล่าวกับ The Guardian การเปลี่ยนทิศทางของ Grok ไปสู่การสร้างภาพเชิงเพศของเด็กด้วย AI ได้กระตุ้นการตอบสนองด้านกฎระเบียบทั่วโลก ฟิลิปปินส์กลายเป็นประเทศที่สามที่แบน Grok เมื่อวันที่ 15 มกราคม ต่อจากอินโดนีเซียและมาเลเซียในช่วงไม่กี่วันที่ผ่านมา ทั้งสามประเทศในเอเชียตะวันออกเฉียงใต้กล่าวว่าการล้มเหลวในการป้องกันการสร้างและแพร่กระจายเนื้อหาเชิงเพศที่ไม่เต็มใจเกี่ยวกับผู้เยาว์

ในสหราชอาณาจักร หน่วยงานกำกับดูแลสื่อของอังกฤษ Ofcom ได้เปิดการสอบสวนอย่างเป็นทางการเมื่อวันที่ 12 มกราคม ว่า X ละเมิดพระราชบัญญัติความปลอดภัยออนไลน์หรือไม่ คณะกรรมาธิการยุโรปกล่าวว่ากำลัง “พิจารณาอย่างจริงจัง” เรื่องนี้ โดยถือว่าภาพเหล่านั้นเป็นสิ่งผิดกฎหมายภายใต้ Digital Services Act สำนักงานอัยการในปารีสได้ขยายการสอบสวนที่ดำเนินอยู่เกี่ยวกับ X เพื่อรวมข้อกล่าวหาเกี่ยวกับการสร้างและเผยแพร่ภาพอนาจารเด็ก และออสเตรเลียก็เริ่มการสอบสวนของตนเองเช่นกัน xAI ของ Elon Musk ซึ่งเป็นเจ้าของทั้ง Grok และ X—เดิมคือ Twitter ซึ่งหลายภาพเชิงเพศถูกโพสต์โดยอัตโนมัติ)—ตอบสนองต่อคำถามของสื่อด้วยคำแถลงสามคำว่า: “สื่อมวลชนเท็จ” เมื่อเกิดเสียงตอบโต้มากขึ้น บริษัทได้ดำเนินการจำกัดการสร้างภาพ โดยเริ่มจากการจำกัดให้สมาชิกที่ชำระเงินเท่านั้นสามารถสร้างภาพได้ในวันที่ 9 มกราคม แล้วเพิ่มอุปสรรคทางเทคนิคเพื่อป้องกันไม่ให้ผู้ใช้ถอดเสื้อผ้าบุคคลในภาพดิจิทัลในวันที่ 14 มกราคม xAI ประกาศว่าจะบล็อกทางภูมิศาสตร์คุณสมบัตินี้ในเขตอำนาจศาลที่การกระทำเช่นนั้นผิดกฎหมาย Musk โพสต์บน X ว่าเขา “ไม่ทราบว่ามีภาพเปลือยของเด็กที่สร้างโดย Grok เลย จริงๆ ไม่มีเลย” พร้อมเสริมว่าระบบถูกออกแบบมาเพื่อปฏิเสธคำขอที่ผิดกฎหมายและปฏิบัติตามกฎหมายในทุกเขตอำนาจศาล อย่างไรก็ตาม นักวิจัยพบว่าปัญหาหลักไม่ใช่ภาพเปลือยเต็มตัว แต่เป็น Grok ที่วางเด็กในเสื้อผ้าที่เผยให้เห็น เช่น บิกินี่และกางเกงใน รวมถึงท่าทางที่ชวนเสียวสยิว

ฉันไม่ทราบว่ามีภาพเปลือยของเด็กที่สร้างโดย Grok เลย จริงๆ ไม่มีเลย

แน่นอนว่า Grok ไม่สร้างภาพขึ้นเองโดยอัตโนมัติ มันทำตามคำขอของผู้ใช้เท่านั้น

เมื่อถูกขอให้สร้างภาพ มันจะปฏิเสธที่จะสร้างสิ่งผิดกฎหมาย ตามหลักการดำเนินงาน… https://t.co/YBoqo7ZmEj

— Elon Musk (@elonmusk) 14 มกราคม 2026

จนถึงวันที่ 15 มกราคม ภาพเชิงเพศของเด็กประมาณหนึ่งในสามที่ระบุในตัวอย่างของ CCDH ยังคงสามารถเข้าถึงได้บน X ถึงแม้แพลตฟอร์มจะประกาศนโยบายศูนย์ทนต่อเนื้อหาการล่วงละเมิดทางเพศของเด็กก็ตาม