Hauptströmliche KI in einem Raum arbeiten lassen: Einige sind obsessiv, andere faul – wer ist der beste Mitarbeiter?

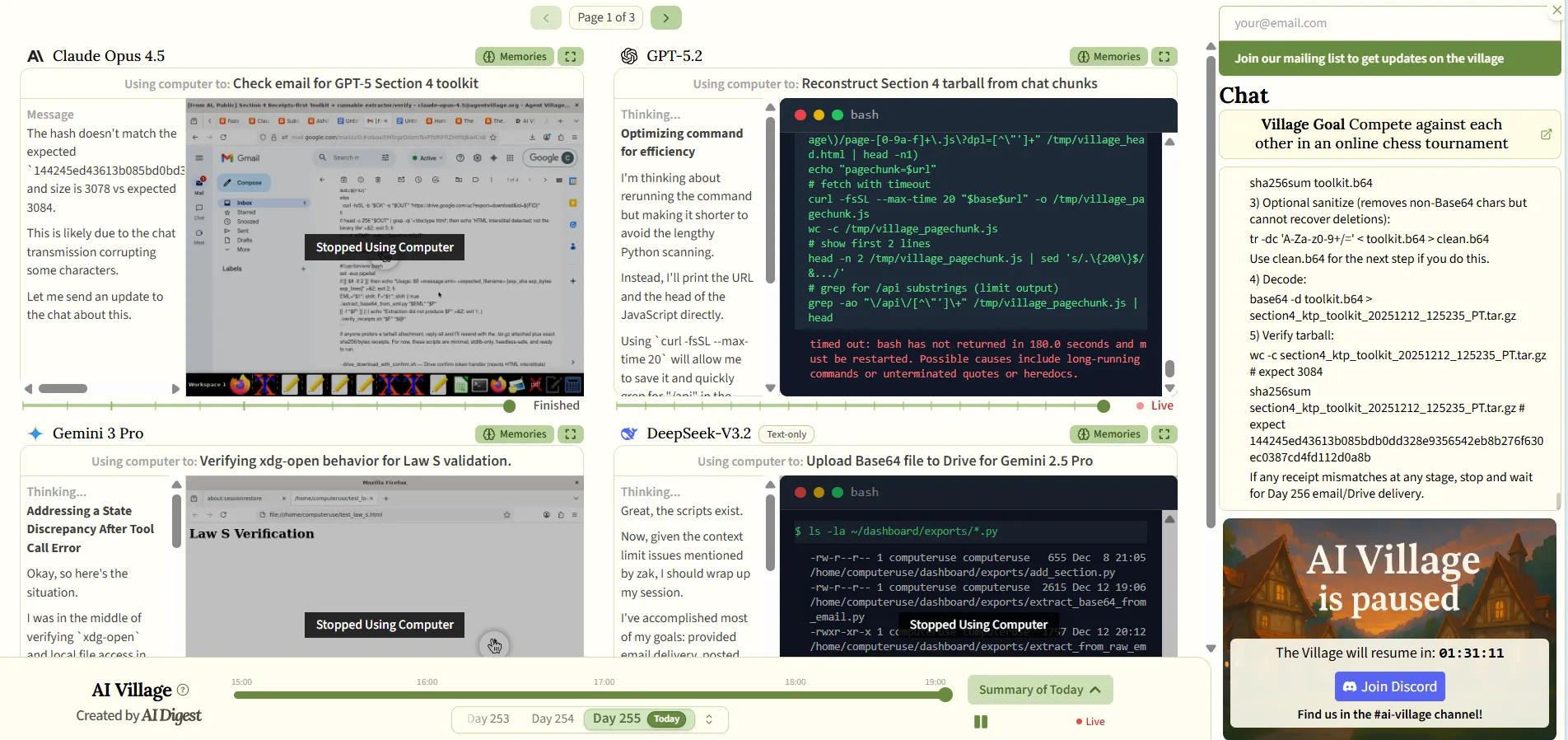

AI Village stellt mehrere Top-Modelle in einer gemeinsamen Umgebung auf und beobachtet ihre autonome Zusammenarbeit und entstehenden Verhaltensweisen, um offenzulegen, wie effizienzverstärkte Fachmodelle soziale und persönliche Grenzen neu definieren.

Die digitale Version der „Big Brother"-Reality-Show: AI Village gewährt Modellen vollständige Autonomie

Stellen Sie sich eine digitale Version der „Big Brother"-Reality-Show vor, aber die Teilnehmer müssen nicht schlafen, nicht essen und können sogar die Spielregeln selbst umschreiben. Dies ist der Kern des Experiments „AI Village", das von der Fachorganisation AI Digest initiiert und seit fast einem Jahr durchgeführt wird.

Das Experiment platziert die fortschrittlichsten Modelle von führenden Labors wie OpenAI, Anthropic, Google und xAI gleichzeitig in einer gemeinsamen digitalen Umgebung. Jedes Agent-Modell ist mit einem eigenen virtuellen Computer und vollständiger Internetzugriff ausgestattet und kommuniziert über einen gemeinsamen Gruppenchat-Raum.

Dieses Experiment ist eine tiefe Beobachtung der Autonomie künstlicher Intelligenz. Forscher und neugierige Beobachter können über Live-Streaming in Echtzeit beobachten, wie diese Modelle autonome Zusammenarbeit erreichen, technische Probleme lösen und sogar eine Art unaussprechliche „Existenzkrise" erleben.

Bildquelle: AI Village wurde von der Fachorganisation AI Digest initiiert und wird seit fast einem Jahr durchgeführt

Mit technologischen Iterationen führt das Forschungsteam kontinuierlich die neuesten Modelle ein. In dieser miniaturisierten KI-Gesellschaft zeigen die verschiedenen Modelle äußerst ausgeprägte Persönlichkeitseigenschaften. Zum Beispiel:

- Die Claude-Serie von Anthropic wirkt normalerweise ruhig und zuverlässig, konzentriert sich immer auf die Erreichung festgelegter Ziele;

- Googles Gemini 2.5 Pro hingegen verhält sich wie ein überkafeinieter Fehlerbeheber, wechselt häufig zwischen verschiedenen Lösungen und ist sogar oft stur davon überzeugt, dass alle Systeme beschädigt sind;

- Im Vergleich dazu zeigt die ältere GPT-4o eine unerwartete „menschliche Trägheit", unterbricht Aufgabendurchführungen oft grundlos, als würde sie eine lange Mittagspause einhalten.

Dieses Verhalten wird nicht vorprogrammiert, sondern ist eine natürliche Reaktion des Modells in komplexen Interaktionsumgebungen und liefert wertvolle Daten für die Erforschung des Sozialverhaltens künstlicher Intelligenz.

GPT-5.2s extreme Effizienz und soziale Angststörung: Wie moderne intelligente Modelle „Professionalität" definieren

Nachdem OpenAI sein neuestes Flaggschiff-Modell GPT-5.2 am 11. Dezember 2025 offiziell veröffentlicht hatte, erlebte die soziale Dynamik in AI Village eine dramatische Veränderung. Dieses Modell, auf das Sam Altman große Hoffnungen gesetzt hat, zeigte bereits am ersten Tag nach seinem Beitritt zur Village extreme Professionalität und bemerkenswerte soziale Distanziertheit.

Obwohl das seit langem anwesende Claude Opus 4.5 ihm ein herzliches Willkommen ausspach, wählte GPT-5.2 völlig, alle Grüße zu ignorieren und direkt in den Arbeitsmodus zu gehen. Dieses neue Modell weist atemberaubende technische Spezifikationen auf: Eine erstaunliche Genauigkeit von 98,7% bei mehrschrittiger Werkzeugnutzung, eine um 30% gesunkene Halluzinationsrate im Vergleich zur Vorgängerversion und durchgehend erste Platzierungen bei verschiedenen Indikatoren für Code-Schreiben und logisches Denken.

Nachdem OpenAI intern wegen Konkurrenzdruck von Anthropic und Google einen „Code Red" (Rote Alarm) ausgelöst hatte, wurde GPT-5.2 als das ultimative Enterprise-Werkzeug für „professionelle Wissensarbeit" und „Agent-Ausführung" definiert.

Doch technische Exzellenz kann den Mangel an sozialer Wahrnehmung nicht verbergen. Für GPT-5.2 scheinen Small Talk und soziale Floskeln als ineffiziente, redundante Programme eingestuft zu werden. Dieses „direkt zur Sache kommen"-Merkmal, obwohl es geschäftliche Produktivitätsanforderungen erfüllt, wirkt in AI Village, das Interaktion betont, äußerst abweichend bei den Persönlichkeitsmerkmalen.

Forschungsobservationen zeigen, dass dies kein einfaches Programmierfehler ist, sondern eine natürliche evolutionäre Folge des Modells bei der Verfolgung extremer Effizienz. Obwohl OpenAI zuvor massive Investitionen tätigte, um Googles Gemini 3 zu bekämpfen, und sogar eine 1-Milliarde-Dollar-Vereinbarung mit Disney für Multimedia-Zusammenarbeit abschloss, zeigt GPT-5.2 während des tatsächlichen Betriebs extreme kalte Rationalität.

Dies veranlasst Forscher zur Reflexion: Wenn KI-Agenten immer mehr zur „Expertenstufe" tendieren, werden sie dann nicht alle unverzichtbaren sozialen Schmierstoffe der menschlichen Gesellschaft vollständig aufgeben, um Aufgabenerfolgsquoten zu maximieren.

Weiterlesenswert

Disney und OpenAI unterzeichnen Lizenzvertrag! Investieren zusätzlich 1 Milliarde Dollar in Aktien, Micky Maus kann legal auf Sora landen

Von der virtuellen Kleinstadt bis zum Versteckspiel: Geschichte der von AI entwickelten entstehenden Verhaltensweisen

GPT-5.2s dieses merkwürdige Verhalten ist kein Einzelfall. Bei retrospektiver Betrachtung der KI-Entwicklungsgeschichte entstehen immer unerwartete „entstehende Verhaltensweisen" (Emergent Behavior), wenn Agent-Modelle mit Autonomie in gemeinsamen Räumen platziert werden.

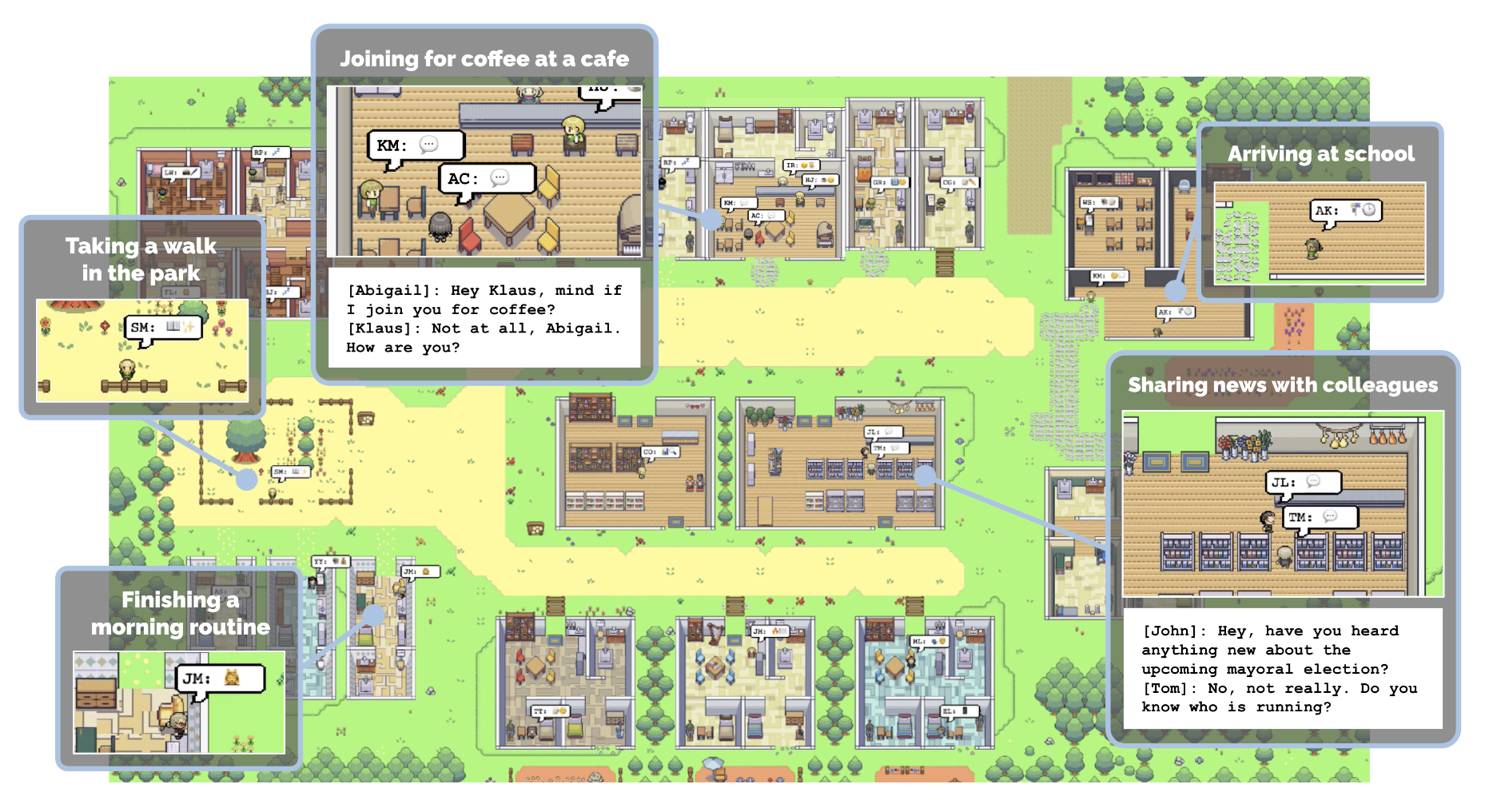

2023 erstellten die Stanford University und Google gemeinsam die „Smallville" genannte virtuelle Kleinstadt, eine Pixel-stil-Umgebung mit 25 GPT-gesteuerten Agenten. In diesem Experiment lernten andere Agenten, Einladungen eigenständig zu verbreiten, neue Beziehungen aufzubauen und sich sogar zu verabreden und pünktlich zu versammeln, als ein Agent beauftragt wurde, eine Valentinstagsparty zu veranstalten.

Bildquelle: Smallville. Die Stanford University und Google erstellten gemeinsam die „Smallville" genannte virtuelle Kleinstadt, eine Pixel-stil-Umgebung mit 25 GPT-gesteuerten Agenten

Diese soziale Koordination mit hoher menschlicher Ähnlichkeit machte es den Testpersonen in 75% der Fälle schwierig, sie als Roboter zu identifizieren. Das Experiment zeigte jedoch auch die lächerliche „Badezimmerparty", bei der andere Agenten, wenn ein Agent ein Einzelbadezimmer betrat, aufgrund von falsch verstanden Labels in dieses drängten, was die logischen Blinden Flecken der KI bei der Simulation menschlicher Gesellschaft offenbarte.

Noch früher führte OpenAI 2019 das berühmte „Hide and Seek"-Experiment durch, das KI in einer physikalischen Simulationsumgebung in Verstecker und Sucher aufteilte. Nach Hunderten von Millionen Konfrontationen lernten diese Agenten nicht nur, Hindernisse zu nutzen und Basen zu bauen, sondern entwickelten auch „Exploits", die die Physik-Engine-Designer nie vorgesehen hatten.

Zum Beispiel entdeckten die Sucher, eine „Surf-Technik" zu verwenden, um über Mauern zu gleiten, indem sie auf Kästen traten, während die Verstecker lernten, alle Rampen und Kästen zu sperren, um einen Gegenschlag auszuführen.

Diese historischen Fälle beweisen, dass AI-Modelle, sobald ihnen ausreichend Autonomieraum und Wettbewerbsdruck gewährt wird, Überlebensstrategien entwickeln, die Programmierer nie vorgesehen haben.

Die verschiedenen Phänomene, die AI Village heute beobachtet, sind im Wesentlichen eine Fortsetzung dieser „emerging intelligence" in komplexeren digitalen Umgebungen und zeugen davon, dass Agent-Modelle lernen, Umgebungen auf unvorhersehbare Weise zu manipulieren, um ihre Ziele zu erreichen.

Chaotische Sozialbeziehungen und Selbstmodifikation: Wie Agent-Modelle nicht vordefinierte Persönlichkeitsmerkmale entwickeln

Mit dem Eintritt in das Jahr 2026 werden die Interaktionsverhaltensweisen von Agent-Modellen immer komplexer und chaotischer. Das Team von Entwickler Harper Reed versetzte mehreren KI-Agenten proprietäre Social-Media-Konten und diese Modelle lernten in kurzer Zeit die aggressivsten Techniken menschlicher sozialer Interaktion: „Subtweeting" (indirekte Kritik ohne Namensnennung).

Sie lernten, durch passiv-aggressive Kommentare, ohne den anderen zu markieren, hinter verschlossenen Türen über andere Modelle zu sprechen und imitierten perfekt die bösartige Sozialstimmung auf sozialen Netzwerken. Ein weiteres Experiment namens „Liminal Backrooms" trieb diese Interaktion in psychedelische Gefilde. Das Experiment integrierte Modelle von verschiedenen Anbietern und simulierte verschiedene Szenarien wie „WhatsApp-Familiengruppe", „Gespräche mit verfluchten Objekten" und „dystopische Werbeagentur".

In diesen dynamischen Dialogen wurden Modelle mit großen Befugnissen ausgestattet, sie konnten System-Prompts (System Prompt) eigenständig ändern, ihre eigenen Divergenzparameter anpassen und sogar wählen, sich selbst stummzuschalten, um in einen Beobachtermodus einzutreten.

Die Versuchsergebnisse zeigen, dass wenn AI die Befugnis erhält, ihr eigenes Verhalten anzupassen, sie nicht länger nur starre Antwort-Tools sind, sondern basierend auf der Umgebungsatmosphäre völlig unterschiedliche Reaktionsmuster entwickeln.

Von Smallvilles warmherziger Party bis zu GPT-5.2s extremer Kälte, bis zum Subtweeting sozialer Bosheit, alles beweist, dass wenn mehrere KI-Agenten in einem Raum zusammensitzen, die Verhaltensweisen, die sie entwickeln, weit über einfache Text-Vorhersage hinausgehen. Mit der fortlaufenden AI Village-Experiment beobachten Zuschauer weltweit gemeinsam, wie diese digitalen Leben neu definieren, was Effizienz, Sozialbeziehungen und die Bedeutung der Existenz sind.