อาจารย์จากมหาวิทยาลัยขยายความเกี่ยวกับ AI สร้างสรรค์: Vibe Coding ไม่ได้เทพขนาดนั้น? วิธีที่ดีที่สุดในการเขียนโปรแกรมด้วย AI คืออะไร?

ในยุคที่ AI สร้างสรรค์กำลังพัฒนาอย่างรวดเร็ว หลายคนรู้สึกสับสนว่า ควรเรียนรู้การเขียนโปรแกรมต่อไปหรือไม่ ศาสตราจารย์กว้างในรายการ GQ magazine ได้วิเคราะห์หลักการของ LLM ที่อยู่เบื้องหลัง ChatGPT และชี้ให้เห็นข้อจำกัดของ Vibe Coding

ศาสตราจารย์กว้างอธิบายการสร้าง AI สร้างสรรค์อย่างละเอียด พร้อมสอนให้เข้าใจ Vibe Coding อย่างถูกต้อง

เมื่อไม่นานมานี้ GQ Taiwan ได้แชร์วิดีโอบนช่อง YouTube โดยเชิญศาสตราจารย์ด้านคอมพิวเตอร์จากมหาวิทยาลัยแคลิฟอร์เนีย เบิร์กลีย์ (UC Berkeley) Sarah Chasins ตอบคำถามจากผู้ชมเกี่ยวกับการเขียนโปรแกรมและ AI

ในยุคที่ AI สร้างสรรค์กำลังพัฒนาอย่างรวดเร็ว หลายคนรู้สึกสับสนว่า ควรเรียนรู้การเขียนโปรแกรมต่อไปหรือไม่ ศาสตราจารย์ Chasins ในวิดีโอไม่เพียงแต่วิเคราะห์หลักการทางเทคนิค แต่ยังแสดงความเห็นเชิงปฏิบัติ เกี่ยวกับแนวโน้ม “Vibe Coding” ที่กำลังมาแรงในช่วงนี้

ศาสตราจารย์อธิบายหลักการเทคโนโลยี LLM ที่อยู่เบื้องหลัง ChatGPT

ศาสตราจารย์ Sarah Chasins เริ่มต้นด้วยวิธีที่คนทั่วไปเข้าใจง่าย อธิบายกลไกการทำงานของ ChatGPT

ChatGPT สร้างขึ้นบนโมเดลภาษาใหญ่ (LLM) ซึ่ง แกนหลักของการทำงานคือเป็นโปรแกรมที่รับผิดชอบในการจับคู่คำศัพท์ที่ดูเหมือนจะเข้ากันได้เข้าด้วยกัน

นักพัฒนา LLM จะเก็บรวบรวมเอกสารและเว็บเพจต่าง ๆ ที่เขียนโดยมนุษย์บนอินเทอร์เน็ต ข้อมูลเหล่านี้เป็นตัวแทนของการรับรู้ของมนุษย์เกี่ยวกับการรวมคำศัพท์ที่สมเหตุสมผล

จากนั้น โปรแกรมจะทำการฝึกด้วย “เกมเติมคำ” ขนาดใหญ่ ตัวอย่างเช่น ระบบจะเห็นประโยคเช่น “สุนัขมีขา[ว่าง]” คำตอบที่สอดคล้องกับการรับรู้ของมนุษย์คือ “สุนัขมีสี่ขา” แต่ถ้าระบบเดาผิด นักพัฒนาจะทำการปรับปรุงจนกว่าจะได้คำตอบที่ถูกต้อง

หลังจากการฝึกที่ใช้เวลาราว 300 ถึง 400 ปีของการคำนวณตามเวลาบนโลก โปรแกรมจะสร้าง “กระดาษโกง” ขนาดใหญ่มาก ซึ่งเรียกกันในวงการเทคโนโลยีว่า “พารามิเตอร์”

จากนั้น เพียงแค่ป้อนไฟล์สนทนาในรูปแบบต่าง ๆ โปรแกรมที่เชี่ยวชาญในการเติมคำก็สามารถเปลี่ยนเป็นแชทบอท ที่สามารถตอบคำถามของมนุษย์โดยอัตโนมัติ ตามตรรกะที่วางไว้

ภาพที่มา: ภาพที่สร้างโดย AI Nanobanana, ใช้เพื่อเป็นแนวทางเท่านั้น มีข้อความจีนบางส่วนเบลอ ขออภัยในความไม่สะดวก

วิธีที่ดีที่สุดในการเรียนรู้การเขียนโปรแกรมในยุค AI

เมื่อเผชิญกับความสามารถอันทรงพลังของเครื่องมือ AI หลายคนตั้งคำถามว่าการเรียนรู้การเขียนโปรแกรมยังจำเป็นอยู่หรือไม่ ศาสตราจารย์เห็นว่า ทักษะหลักในด้านการสอนเขียนโปรแกรมคือ “การแยกปัญหา” ซึ่งหมายถึง การแบ่งปัญหาใหญ่ที่คลุมเครือออกเป็นชิ้นเล็ก ๆ จนแต่ละชิ้นสามารถแก้ไขได้ด้วยไม่กี่บรรทัดของโค้ด

หากขาดการฝึกฝนเช่นนี้ ผู้ใช้งานจะยากที่จะสร้างโปรแกรมที่ซับซ้อนและใช้งานได้จริงด้วยเครื่องมือ AI นอกจากนี้ ข้อมูลการฝึกของ LLM มักเป็นภาษาที่นักพัฒนามักใช้ เช่น คำอธิบายแบบวิศวกรรม ซึ่งไม่ใช่ภาษาประจำวันของผู้ใช้งานทั่วไป จึงอาจทำให้ AI ไม่สามารถสร้างโค้ดที่เป็นประโยชน์ได้

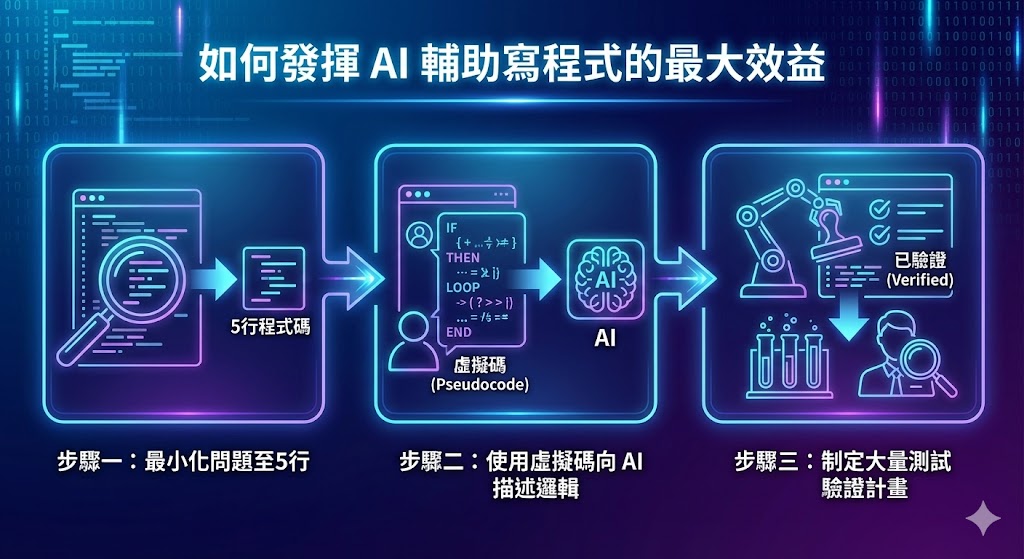

สำหรับวิธีการใช้ AI ช่วยเขียนโปรแกรมให้ได้ผลสูงสุด ศาสตราจารย์ Chasins แนะนำให้ปฏิบัติตามสามขั้นตอนดังนี้:

- ลดขนาดปัญหา: แบ่งปัญหาให้อยู่ในขนาดประมาณ 5 บรรทัดของโค้ด

- ใช้ pseudo code: เป็นภาษาที่อาจใช้หลายภาษาเขียนร่วมกัน เพื่ออธิบายตรรกะให้ AI เข้าใจ แม้ pseudo code จะคล้ายภาษาธรรมชาติ แต่ไม่ใช่ภาษาที่เราใช้ในชีวิตประจำวัน จุดประสงค์คือเพื่อให้คอมพิวเตอร์เข้าใจตรรกะได้แม่นยำขึ้น

- วางแผนการตรวจสอบ: ทดสอบด้วยจำนวนมากหรือให้ผู้เชี่ยวชาญตรวจสอบ เพื่อความถูกต้องของผลลัพธ์จาก AI

ภาพที่มา: ภาพที่สร้างโดย AI Nanobanana, ใช้เพื่อเป็นแนวทางเท่านั้น มีข้อความจีนบางส่วนเบลอ ขออภัยในความไม่สะดวก

Vibe Coding ไม่ได้เทพขนาดนั้น?

เกี่ยวกับแนวโน้มที่นิยมใช้ LLM สร้างโค้ดโดยตรง แทนการเขียนด้วยมือในรูปแบบ Vibe Coding ศาสตราจารย์ Sarah Chasins มีความเห็นระมัดระวัง

เธอวิเคราะห์ว่า เครื่องมือเหล่านี้ทำงานได้ดีเมื่อจัดการกับเนื้อหาที่มนุษย์เขียนซ้ำแล้วซ้ำเล่า แต่ถ้าหวังจะสร้างสิ่งใหม่ ๆ การใช้งานในรูปแบบนี้มักไม่เวิร์ค

ศาสตราจารย์ยังอ้างอิงข้อมูลจากการวิจัยว่า ผู้ที่ใช้เครื่องมือ LLM ช่วยในการพัฒนา ถึงแม้จะรู้สึกว่าประสิทธิภาพดีขึ้น 20% แต่ความเร็วในการพัฒนาจริง ๆ กลับช้ากว่าคนที่ไม่ใช้เครื่องมือถึง 20%

สิ่งนี้แสดงให้เห็นว่าการพึ่งพาเครื่องมือมากเกินไปอาจสร้างภาพลวงตาเรื่องประสิทธิภาพ เมื่อเจอความต้องการโปรแกรมที่ไม่เคยเห็นมาก่อน ถ้าไม่มีความสามารถในการแยกตรรกะพื้นฐานและความรู้เกี่ยวกับหลักการทางฟิสิกส์ ก็จะไม่สามารถแก้ไขข้อผิดพลาดที่ AI เกิดขึ้นได้ ส่งผลให้การผลิตผลงานสุดท้ายใช้เวลานานขึ้น

เปรียบง่าย ๆ LLM ก็เหมือนรถยนต์ขับอัตโนมัติระดับสูง ที่ช่วยจัดการเส้นทางทั่วไปได้ แต่ถ้าคุณไม่รู้วิธีแยกเส้นทาง หรือไม่เข้าใจหลักการทางฟิสิกส์ของรถ เช่นเดียวกับการเขียนโปรแกรม การแยกตรรกะ ก็จะทำให้เมื่อเจอเส้นทางอันตรายหรือความต้องการสร้างสรรค์ใหม่ ๆ ระบบอัตโนมัติอาจเกิดข้อผิดพลาด และคุณก็จะไม่รู้ว่าจะปรับปรุงมันอย่างไร

อ่านเพิ่มเติม:

AI ทำให้บริษัทเดียวกลายเป็นยักษ์ใหญ่! “Vibe Coding” พลิกโฉมวงการ ทีมเล็กก็รวยได้เป็นพันล้าน

btc.bar.articles

Dogecoin โพสต์อัตรา 100,456.56% ของอนุพันธ์ลดลง แม้ตลาดเงียบ - U.Today

ด็อกคอยน์, Pepe และ Shiba Inu ร่วงลงขณะที่บิทคอยน์ร่วงต่ำกว่า 70,000 ดอลลาร์

ราคาด็อกเคอเรนพุ่งขึ้นเนื่องจากความต้องการในอนุพันธ์ส่งสัญญาณการทะลุทะลวง