AI迎來“USB-C時刻”,MCP如何與以太坊完美融合?

內容 | Bruce

編輯 & 排版 | 環環

設計 | Daisy

AI 進化史上的"USB-C時刻",2024 年 11 月,Anthropic 發佈的 MCP 協議正在引發硅谷地震。這個被喻為"AI 界 USB-C"的開放標準,不僅重構了大模型與物理世界的連接方式,更暗藏著破解 AI 壟斷困局、重構數字文明生產關係的密碼。當我們還在爭論 GPT-5 的參數規模時,MCP 已悄然鋪就通向 AGI 時代的去中心化之路…

Bruce:最近在研究 Model Context Protocol(MCP)。這是繼 ChatGPT 之後,在 AI 領域第二個讓我非常興奮的東西,因為它有希望解決我思考多年的三個問題:

- 非科學家和天才,普通人如何參與 AI 行業並獲得收入?

- AI 和 Ethereum 有什麼雙贏的結合之處?

- 如何實現 AI d/acc?避免中心化的大公司壟斷、審查,AGI 毀滅人類?

01、MCP 是什麼?

MCP 是一個開放標準框架,可以簡化 LLM 與外部數據源和工具的集成。如果我們把 LLM 比作 Windows 操作系統,Cursor 等應用是鍵盤和硬件,那麼 MCP 就是 USB 接口,支持將外部數據和工具靈活插入,然後用戶可以讀取使用這些外部數據和工具。

MCP 提供了三種能力對 LLM 進行擴展:

- Resources(知識擴展)

- Tools(執行函數,調用外部系統)

- Prompts(預編寫提示詞模板)

MCP 可以由任何人進行開發和託管,以 Server 的方式提供,可以隨時下線停止服務。

02、為什麼需要 MCP

目前 LLM 使用盡可能多的數據進行大量的運算並生成大量的參數,將知識融入到模型裡面,從而實現對話輸出相應知識。但是存在比較大的幾個問題:

- 大量的數據和運算需要大量的時間和硬件,用於訓練的知識通常是過時的。

- 大量參數的模型,很難在本地設備進行部署和使用,但實際上使用者大部分場景可能並不需要全部信息完成需求。

- 部分模型採用爬蟲的方式讀取外部信息進行運算以實現時效性,但是由於爬蟲的限制和外部數據的質量,可能產出誤導性更強的內容。

- 由於 AI 並沒有很好的給創作者帶來利益,很多網站和內容開始實施反 AI 措施,生成大量垃圾信息,將會導致 LLM 的質量逐步下降。

- LLM 很難擴展到方方面面的外部功能和操作,例如準確調用 GitHub 接口實現一些操作,它會按照可能過時的文檔生成代碼,但無法確保可以精準執行。

03、胖 LLM 和瘦 LLM + MCP 的架構演進

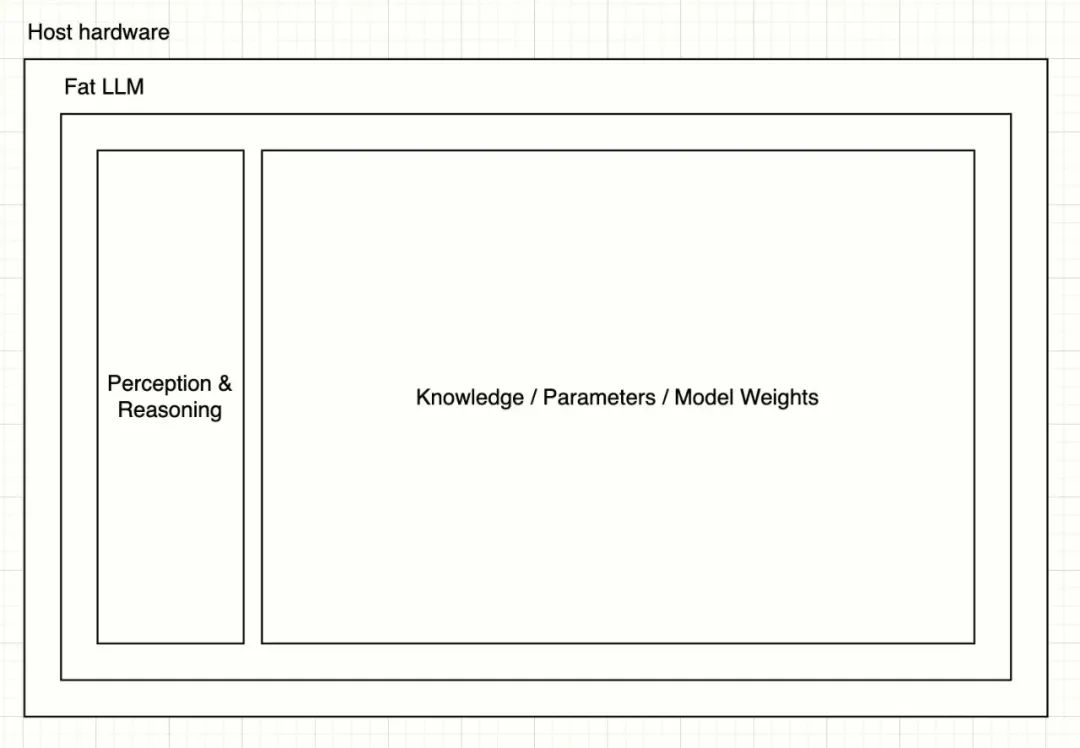

我們可以將目前的超大規模模型視為胖 LLM,其架構可以以下面簡單圖示表示:

用戶輸入信息之後,通過 Perception & Reasoning 層對輸入進行拆解和推理,然後調用龐大的參數進行結果生成。

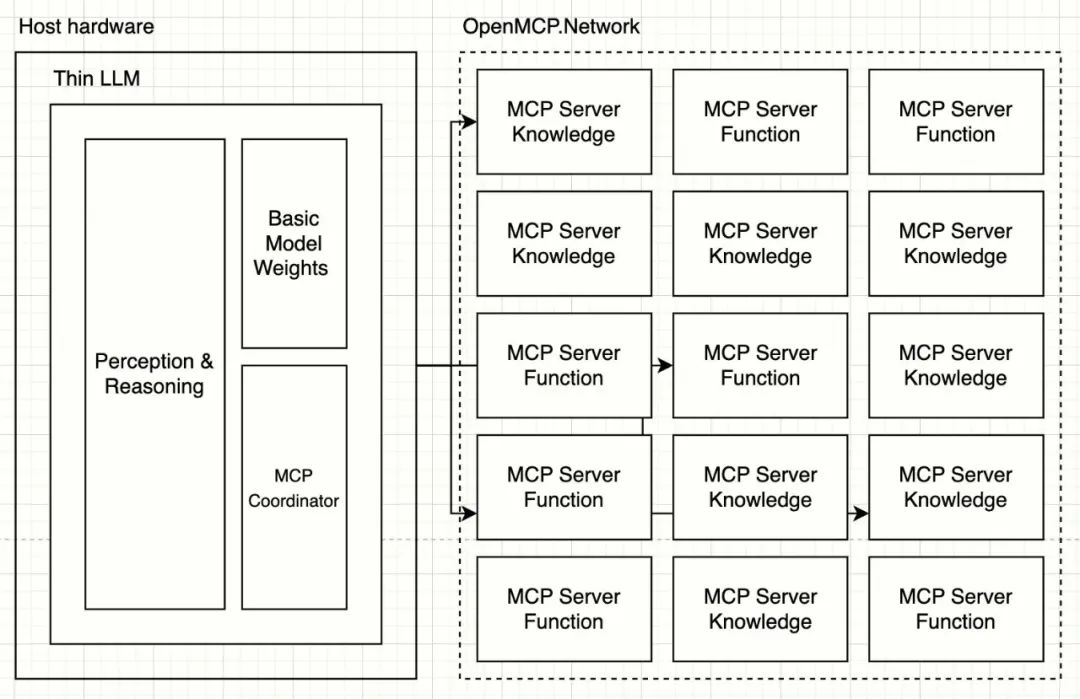

基於 MCP 之後,LLM 可能聚焦在語言解析本身,剝離出去知識和能力,變成瘦 LLM:

瘦 LLM 的架構下,Perception & Reasoning 層將會關注如何將全方面的人類物理環境信息解析成為 tokens,包括但不限於:語音、語氣、氣味、圖像、文字、重力、氣溫等,然後通過 MCP Coordinator 編排和協調多達數百的 MCP Servers 完成任務。瘦 LLM 的訓練成本和速度將會極速提升,對於部署設備的要求變得很低。

04、MCP 如何解決三大問題

普通人如何參與 AI 行業?

任何有獨特才能的人,都可以創建自己的 MCP Server 對 LLM 提供服務。例如一個鳥類愛好者可以將自己多年的鳥類筆記通過 MCP 對外提供服務。當有人使用 LLM 搜索跟鳥類相關的信息,就會調用到當前鳥類筆記 MCP 服務。創作者也會因此獲得收入分成。

這是一種更為精準和自動化的創作者經濟循環,服務內容更加標準化,調用的次數、輸出的 token 都可以很精準的統計。LLM 提供商甚至可以同時調用多個鳥類筆記 MCP Servers 讓用戶選擇和評分來確定誰的質量更好獲得更高匹配權重。

AI 和 Ethereum 的雙贏結合

a. 我們可以基於 Ethereum 構建一個 OpenMCP.Network 創作者激勵網絡。MCP Server 需要託管和提供穩定的服務,用戶對 LLM 提供商付費,LLM 提供商將實際的激勵通過網絡分配到被調用的 MCP Servers 上從而維持整個網絡的可持續性和穩定性,激發 MCP 的創作者持續創作和提供高質量內容。這一套網絡將需要使用智能合約實現激勵的自動化、透明、可信和抗審查。運行過程中的簽名、權限驗證、隱私保護都可以使用以太坊錢包、ZK 等技術實現。

b. 開發 Ethereum 鏈上操作相關的 MCP Servers,例如 AA 錢包調用服務,用戶將支持在 LLM 裡面通過語言實現錢包付款而不暴露相關私鑰和權限給 LLM。

c. 還有各種開發者工具,進一步簡化 Ethereum 智能合約開發和代碼生成。

實現 AI 去中心化

a. MCP Servers 將 AI 的知識和能力去中心化,任何人都可以創建和託管 MCP Servers,註冊到例如 OpenMCP.Network 這樣的平臺上面之後按照調用獲得激勵。沒有任何一個公司可以掌握全部的 MCP Servers。如果一個 LLM 提供商給予不公平的激勵到 MCP Servers,創作者將支持屏蔽該公司,用戶得不到優質結果後將會更換其他 LLM 提供商實現更公平的競爭。

b. 創作者可以對自己的 MCP Servers 實現細粒度的權限控制以保護隱私和版權。瘦 LLM 提供商應該通過提供合理的激勵來讓創作者貢獻高質量的 MCP Servers。

c. 瘦 LLM 能力差距將慢慢抹平,因為人類的語言是有遍歷上限的,演進也很緩慢。LLM 提供商將需要把目光、資金瞄向高質量的 MCP Servers,而非重複使用更多顯卡煉丹。

d. AGI 的能力將得到分散和降權,LLM 僅作為語言處理和用戶交互,具體能力分佈在各個 MCP Servers 裡面。AGI 將不會威脅到人類,因為關閉 MCP Servers 之後就只能進行基礎語言對話。

05、總體回顧

- LLM + MCP Servers 的架構演進,本質上是將 AI 能力的去中心化,降低了 AGI 毀滅人類的風險。

- LLM 的使用方式,使其對 MCP Servers 的調用次數和輸入輸出可以做到 token 級別的統計和自動化,為 AI 創作者經濟系統的搭建奠定了基礎。

- 好的經濟系統可以驅動創作者主動貢獻創作高質量 MCP Servers,從而帶動整個人類的發展,實現正向飛輪。創作者不再抵禦 AI,AI 也會提供更多崗位和收入,將類似 OpenAI 這樣的壟斷商業公司的利潤合理分配。

- 這一套經濟系統,結合其特性和創作者的需求,非常適合基於 Ethereum 實現。

06、未來展望:下一步的劇本演進

- MCP 或者類 MCP 的協議將會層出不窮,幾家大公司將開始競爭標準的定義。

- MCP Based LLM 將會出現,專注於解析和處理人類語言的小模型,附帶 MCP Coordinator 接入 MCP 網絡。LLM 將支持自動發現和調度 MCP Servers,無需複雜手工配置。

- MCP Network 服務提供商將出現,每家有自己的經濟激勵系統,MCP 創作者將自己的 Server 註冊和託管即可得到收入。

- 如果 MCP Network 的經濟激勵系統使用 Ethereum 構建,基於智能合約,那麼 Ethereum 網絡的 transactions 保守估計將增加約 150 倍(按照非常保守的每天 1 億次 MCP Servers 的調用量,目前 12s 一個 Block 包括 100 txs 計算)。