คอมพิวเตอร์ของฉันสามารถรันโมเดล AI ได้ในเครื่องหรือไม่? CanIRun.ai ช่วยคุณวิเคราะห์อย่างรวดเร็ว

เครื่องมือ AI CanIRun.ai สามารถตรวจจับสเปคฮาร์ดแวร์ของผู้ใช้โดยอัตโนมัติผ่านเบราว์เซอร์ เพื่อประมาณความสามารถในการรันโมเดล LLM ต่างๆ และความเร็วในการประมวลผล สำหรับผู้สนใจสามารถลองใช้งานเพื่อทำความเข้าใจได้

(เรื่องราวก่อนหน้า: Clawdbot เทพเจ้าแห่ง AI ที่ทำให้ Mac mini ขายหมดสต็อก 24 ชม. ต่อวัน)

(ข้อมูลเพิ่มเติม: อย่าเดินตามกระแส OpenClaw อย่างเดียว ครีบปู AI ก็เก่ง แต่ไม่จำเป็นต้องเหมาะกับคุณเสมอไป)

สารบัญบทความ

Toggle

- ข้อเสียเล็กน้อยของ Canirun.ai

- ทางเลือกในเชิงคำสั่ง llmfit เปิดตัวแล้ว

- สิ่งที่ชุมชนอยากได้มากที่สุด

คุณอยากติดตั้งโมเดลภาษาใหญ่ (LLM) บนเครื่องของคุณเองไหม? ปัญหาหลักที่มือใหม่มักเจอคือ: คอมพิวเตอร์ของฉันสามารถรันโมเดลอะไรได้บ้าง? บทความนี้จะแนะนำเครื่องมือที่เพิ่งเป็นที่พูดถึงในชุมชน Hacker News อย่าง CanIRun.ai

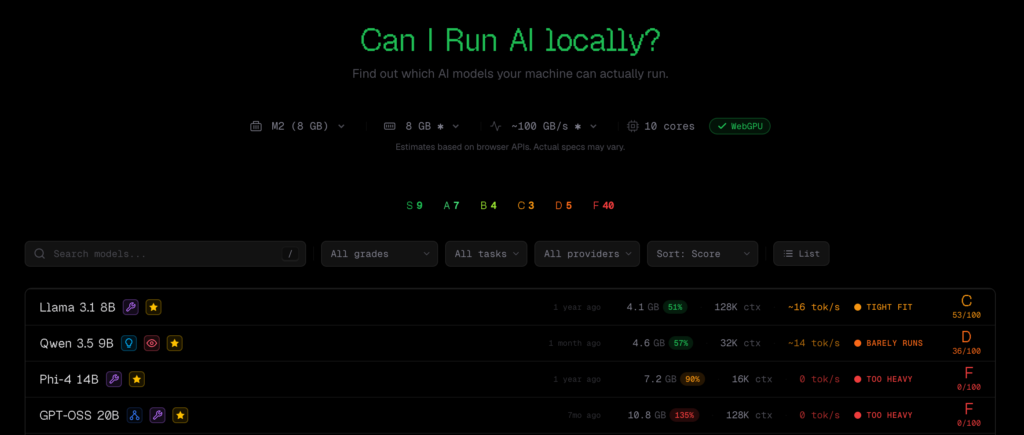

CanIRun.ai เป็นเครื่องมือบนเว็บล้วนๆ ใช้งานง่ายมาก: เพียงเปิดเบราว์เซอร์ มันจะตรวจจับรุ่น GPU และสเปคหน่วยความจำของคุณโดยอัตโนมัติผ่าน WebGPU API จากนั้นจะประมาณความสามารถในการรันโมเดลต่างๆ และความเร็วในการทำนาย (token/s) โดยอิงจากจำนวนพารามิเตอร์ ระดับการควอไทซ์ (Q4_K_M, Q8_0, F16 ฯลฯ) และแบนด์วิดธ์ของหน่วยความจำ พร้อมให้คะแนนเป็นระดับ S ถึง F

ครอบคลุมตั้งแต่โมเดลเบาๆ ที่มี 0.8 พันล้านพารามิเตอร์ ไปจนถึงโมเดลขนาดใหญ่ระดับ 1 เทรา (T) ที่เป็น MoE (Mixture of Experts) ข้อมูลมาจาก llama.cpp, Ollama และ LM Studio ซึ่งเป็นเครื่องมือรันบนเครื่องหลัก

ข้อเสียเล็กน้อยของ CanIRun.ai

แม้แนวคิดของเครื่องมือนี้จะได้รับการยอมรับจากชุมชน แต่ก็มีข้อวิจารณ์อยู่บ้าง โดยเน้นไปที่สองด้านคือ: การครอบคลุมฮาร์ดแวร์ไม่ครบถ้วน และความแตกต่างระหว่างผลประมาณกับผลทดสอบจริง

ปัญหาเรื่องรายการฮาร์ดแวร์ที่ขาดไปเป็นเรื่องที่พูดถึงบ่อยที่สุด เช่น RTX Pro 6000, RTX 5060 Ti 16GB, GPU สำหรับโน้ตบุ๊กจากหลายค่าย ปัจจุบันยังไม่มีในรายการ แม้แต่ชิป Apple ก็มีการระบุไว้ แต่สูงสุดเพียง 192GB ในขณะที่ M3 Ultra จริงๆ แล้วรองรับได้ถึง 512GB

ส่วนปัญหาเรื่องความคลาดเคลื่อนของการประมาณผล บางคนทดสอบแล้วผลไม่ตรงกับที่ CanIRun.ai ประมาณไว้ เช่น บางกรณีรันได้จริงแต่เว็บไซต์บอกว่าไม่สามารถรันได้ ซึ่งเป็นประเด็นที่พูดคุยกันในกระทู้ ทำให้บางคนตัดสินใจไม่เชื่อผลลัพธ์ของเครื่องมือนี้

แม้จะยังมีจุดที่สามารถปรับปรุงได้อีกมาก แต่สำหรับมือใหม่หรือผู้เริ่มต้น การใช้งานก็สามารถช่วยให้ตรวจสอบอุปกรณ์ของตนได้อย่างรวดเร็ว

ทางเลือกในเชิงคำสั่ง llmfit เปิดตัวแล้ว

ในชุมชนก็มีคนแนะนำเครื่องมืออีกตัวคือ llmfit ซึ่งเป็นโปรแกรมในเชิงคำสั่ง (CLI) ที่สามารถเรียกใช้เครื่องมือระบบ เช่น nvidia-smi เพื่อดึงข้อมูล GPU ได้อย่างแม่นยำ โดยไม่ต้องพึ่ง API ของเบราว์เซอร์ หลายคนมองว่ามันใช้งานได้จริงและแม่นยำกว่ารุ่นบนเว็บ

แต่ก็มีประเด็นร้อนขึ้นมาอีกเรื่องคือ บางคนแปลกใจที่ llmfit สามารถระบุรุ่น GPU ได้อย่างแม่นยำโดยไม่ต้องขอสิทธิ์พิเศษใดๆ ซึ่งไปแตะประเด็นเรื่องการรู้จำลักษณะเฉพาะของเบราว์เซอร์ (browser fingerprinting) และความเป็นส่วนตัวของฮาร์ดแวร์ในชุมชน ถ้าเครื่องมือบนเว็บสามารถตรวจจับการ์ดจอของคุณได้โดยใช้ WebGPU แล้ว ข้อมูลนี้จะถูกนำไปใช้อย่างไร?

มีผู้แนะนำว่า ฟีเจอร์นี้ควรจะถูกรวมเข้าไปใน Ollama โดยตรง เพื่อให้ผู้ใช้สามารถเลือกโมเดลที่เหมาะสมกับฮาร์ดแวร์ของตนเองได้โดยอัตโนมัติจากเชิงคำสั่ง ลดความยุ่งยากในการค้นหาเอง

สิ่งที่ชุมชนอยากได้มากที่สุด

จากความคิดเห็นของชุมชน ปัจจุบันข้อจำกัดหลักของ CanIRun.ai ไม่ใช่แค่ความแม่นยำในการประมาณผล แต่เป็นการประเมินในมิติเดียวเท่านั้น ผู้ใช้ต้องการรู้ว่า ในฮาร์ดแวร์ของตน โมเดลไหนที่คุณภาพดีที่สุดและความเร็วอยู่ในระดับที่รับได้

เครื่องมือนี้สามารถบอกได้แค่ว่า “รันได้หรือไม่” แต่ไม่สามารถบอกได้ว่า “รันได้ดีแค่ไหน” ชุมชนหวังว่าจะมีการเพิ่มคะแนนมาตรฐานของความสามารถของโมเดล รวมกับการประมาณฮาร์ดแวร์ เพื่อให้ข้อมูลประกอบการตัดสินใจที่สมบูรณ์มากขึ้น

แนวทางการปรับปรุงด้านเทคนิคก็รวมถึง การสนับสนุนกลยุทธ์แชร์หน่วยความจำ CPU (เพื่อให้ GPU ที่มีหน่วยความจำไม่เพียงพอสามารถใช้หน่วยความจำระบบได้), การรองรับเทคนิค KV cache สำหรับการโหลดข้อมูล และการแก้ไขตรรกะการคำนวณของโมเดล MoE ให้ถูกต้องมากขึ้น

โดยรวมแล้ว เครื่องมือนี้เป็นแนวทางที่ถูกต้องและตลาดก็ต้องการอยู่แล้ว เพราะการใช้งาน AI บนเครื่องในระดับพื้นฐานสำหรับผู้ใช้ทั่วไปยังค่อนข้างสูง และการรู้ทันทีว่า “เครื่องของฉันเหมาะกับการรันอะไร” เป็นความต้องการที่สำคัญ CanIRun.ai จับจุดนี้ได้ดี แต่ก็ยังต้องพัฒนาอีกมากในอนาคต