Grammarly เปิดตัว AI ผู้เชี่ยวชาญด้านการตรวจสอบบทความ ถูกวิจารณ์! วงการศึกษาแฉ: ละเมิดลิขสิทธิ์และลอกเลียนแบบนักวิชาการผู้ล่วงลับโดยเจตนา

Grammarly เปิดตัว “Expert Review” จำลองความเห็นของนักวิชาการด้วย AI ก่อให้เกิดข้อถกเถียงเรื่องการใช้ชื่อและจริยธรรมทางวิชาการโดยไม่ได้รับอนุญาต

Grammarly เปิดตัวฟังก์ชัน AI “การตรวจสอบโดยผู้เชี่ยวชาญ” กระตุ้นคำถามในวงการวิชาการ

เครื่องมือปัญญาประดิษฐ์ยังคงแทรกซึมในอุตสาหกรรมการเขียนและการวิจัย แต่ฟีเจอร์ล่าสุด “การจำลองความเห็นของผู้เชี่ยวชาญด้วย AI” กลับก่อให้เกิดการถกเถียงอย่างรุนแรงในวงการวิชาการเกี่ยวกับจริยธรรมและการอนุญาต บริษัท Grammarly ซึ่งเป็นที่รู้จัก ได้เปิดตัวฟีเจอร์ AI ชื่อ “Expert Review” ซึ่งอนุญาตให้ผู้ใช้ในขณะเขียนเอกสาร สามารถให้ AI จำลองมุมมองของนักวิชาการหรือผู้วิจารณ์เฉพาะด้าน เพื่อเสนอคำแนะนำและความเห็นต่อเนื้อหา

ฟังก์ชันนี้จะวิเคราะห์ข้อความที่ผู้ใช้กำลังเขียน และแนะนำ “ผู้เชี่ยวชาญ” ที่เหมาะสมโดยอัตโนมัติตามหัวข้อ จากนั้นจะสร้างความเห็นโดยใช้โมเดลภาษาใหญ่ เช่น:

- ในหัวข้อวิจารณ์สื่อ ระบบอาจอ้างอิงสไตล์ความเห็นของ Margaret Sullivan บรรณาธิการสาธารณะของ The New York Times หรือนักเขียนสื่ออาวุโสของ Politico อย่าง Jack Shafer เพื่อช่วยปรับปรุงบทความ

- ในหัวข้อกฎหมายและการปกครองออนไลน์ ระบบอาจจำลองวิเคราะห์ของ Lawrence Lessig ศาสตราจารย์ด้านกฎหมายจาก Harvard; หรือในด้านจริยธรรมเทคโนโลยีและความเป็นส่วนตัวข้อมูล อาจอ้างอิงแนวคิดของ Timnit Gebru นักวิจัยด้านจริยธรรม AI หรือ Helen Nissenbaum ศาสตราจารย์ด้านวิทยาการคอมพิวเตอร์จาก Cornell Tech

Grammarly ระบุว่า ฟังก์ชันนี้ไม่ได้ให้ความเห็นโดยนักวิชาการจริง ๆ แต่เป็นการใช้ผลงานวิจัยและบทความที่เผยแพร่สาธารณะของพวกเขา เพื่อสร้างความเห็นที่ “ได้รับแรงบันดาลใจจากแนวคิดของพวกเขา” บริษัทชี้แจงว่า ระบบจะเลือก “ผู้เชี่ยวชาญ” ที่เกี่ยวข้องตามหัวข้อโดยอัตโนมัติ และแนะนำให้ผู้ใช้ไปอ่านผลงานของพวกเขาเพิ่มเติม

อย่างไรก็ตาม วิธีการออกแบบนี้ยังเป็นที่วิพากษ์วิจารณ์ในวงการวิชาการ โดยเฉพาะอย่างยิ่งเมื่อพบว่าชื่อของนักวิชาการบางคนถูกนำมาใช้ในบทบาทความเห็นของ AI โดยไม่ได้รับอนุญาตล่วงหน้า

นักวิชาการวิจารณ์การใช้ชื่อโดยไม่ได้รับอนุญาต แม้กระทั่งการจำลองนักวิชาการที่เสียชีวิตแล้ว

หนึ่งในประเด็นที่เป็นข้อถกเถียงรุนแรงที่สุด คือ การที่ AI อาจจำลองสไตล์ความเห็นของนักวิชาการที่เสียชีวิตไปแล้ว นักวิชาการบางคนชี้ให้เห็นว่าการดำเนินการเช่นนี้เท่ากับ “ให้ AI ฟื้นคืนชีพนักวิชาการ” เพื่อให้ชื่อเสียงและความเห็นของพวกเขาใช้ในบริบทของ AI

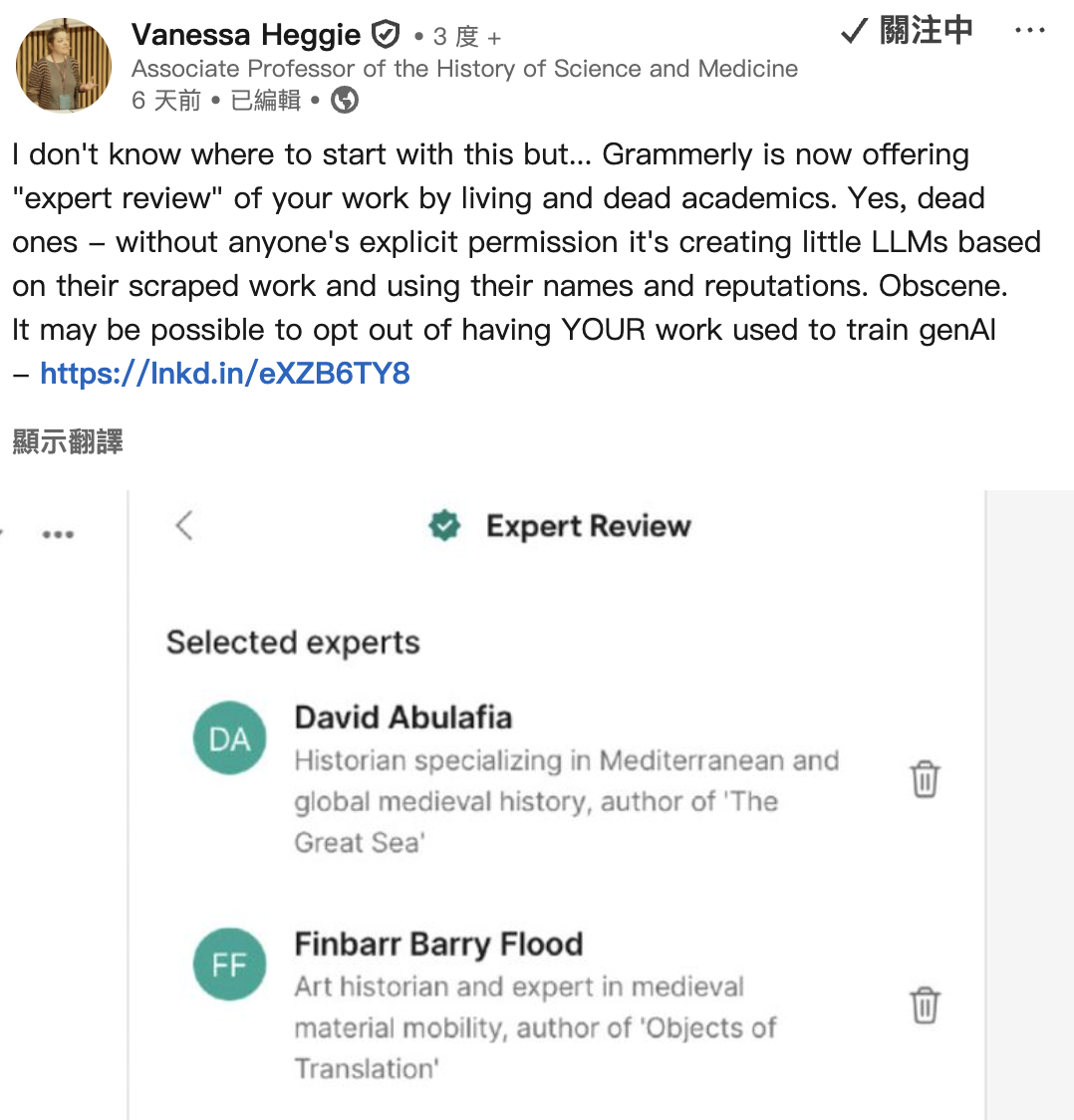

Vanessa Heggie ศาสตราจารย์ด้านประวัติศาสตร์จาก University of Birmingham ใน LinkedIn ได้ออกมาแสดงความเห็นวิจารณ์อย่างเปิดเผยว่า Grammarly กำลังใช้ผลงานวิจัยของนักวิชาการเพื่อสร้างโมเดลภาษา และใช้ชื่อเสียงของพวกเขาเป็นตัวละครใน AI โดยไม่ทราบว่าพวกเขาได้อนุญาตให้ใช้ผลงานเพื่อฝึกโมเดลหรือไม่ และไม่เห็นด้วยกับการใช้ชื่อของนักวิชาการเพื่อสร้าง “การตรวจสอบโดย AI”

ภาพจาก: LinkedIn ศาสตราจารย์ Vanessa Heggie จาก University of Birmingham วิจารณ์ฟังก์ชันนี้อย่างเปิดเผย

Heggie ระบุว่า นักวิชาการหลายคนแม้แต่ผู้ที่เสียชีวิตไปแล้ว ก็ยังถูกนำมาใช้เป็นตัวละครใน AI ซึ่งเป็นการกระทำที่ไม่สามารถยอมรับได้ หากไม่ได้รับอนุญาตล่วงหน้า การใช้ผลงานและชื่อเสียงของนักวิชาการเพื่อสร้างโมเดล AI โดยไม่ได้รับความยินยอม ถือเป็นการกระทำที่ไม่เหมาะสมอย่างยิ่ง

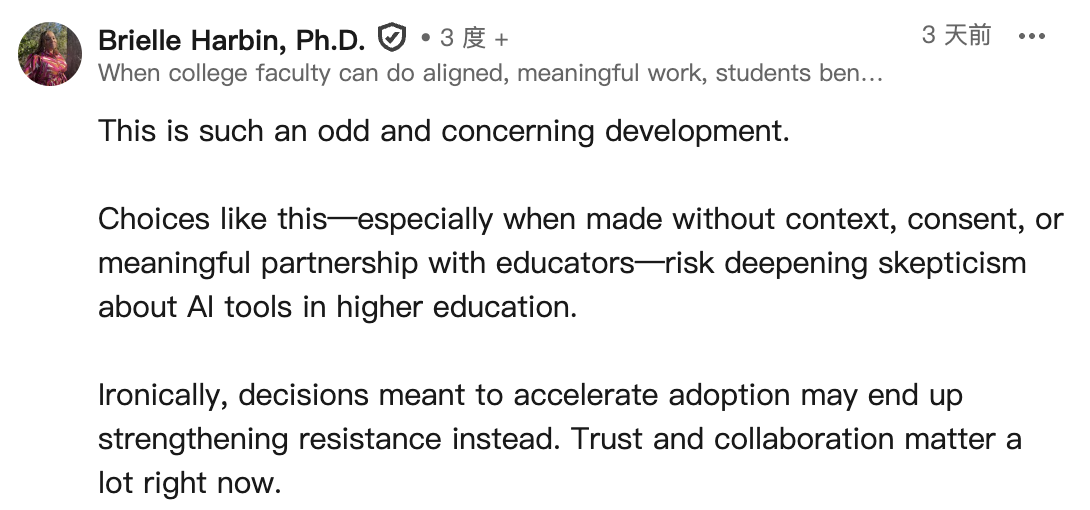

นักวิชาการอีกท่านหนึ่ง คือ Brielle Harbin อดีตรองศาสตราจารย์ด้านรัฐศาสตร์จาก U.S. Naval Academy ก็แสดงความกังวลต่อฟังก์ชันนี้ โดยชี้ให้เห็นว่า การที่บริษัท AI สร้างโมเดลความเห็นโดยใช้ชื่อของนักวิชาการโดยไม่มีข้อมูลพื้นฐาน การอนุญาต หรือความร่วมมือใด ๆ อาจทำให้เกิดความไม่ไว้วางใจในวงการการศึกษาและการวิจัยมากขึ้น

ภาพจาก: LinkedIn Brielle Harbin อดีตรองศาสตราจารย์ด้านรัฐศาสตร์จาก U.S. Naval Academy ก็แสดงความกังวล

Harbin เห็นว่า ในปัจจุบันอุตสาหกรรมการศึกษาระดับอุดมศึกษายังอยู่ในช่วงรอดูท่าที หากบริษัทเทคโนโลยีออกแบบผลิตภัณฑ์โดยไม่คำนึงถึงความร่วมมือและจริยธรรมในวงการวิชาการ ก็อาจทำให้ความตั้งใจที่จะเร่งการนำ AI มาใช้ กลับกลายเป็นการสร้างความไม่ไว้วางใจและการต่อต้านที่รุนแรงขึ้น

Grammarly เปลี่ยนโฉมเป็นแพลตฟอร์ม AI เครื่องมือเขียนกลายเป็นตัวแทนด้านประสิทธิภาพ

Grammarly ก่อตั้งขึ้นในปี 2009 เดิมทีเป็นเครื่องมือช่วยตรวจสอบไวยากรณ์และการเขียนด้วย AI แต่ด้วยเทคโนโลยี AI สร้างสรรค์ที่พัฒนาอย่างรวดเร็ว บริษัทจึงค่อย ๆ ปรับเปลี่ยนผลิตภัณฑ์จากเครื่องมือช่วยเขียนเพียงอย่างเดียว ไปสู่แพลตฟอร์ม AI สำหรับเพิ่มประสิทธิภาพการทำงานในด้านต่าง ๆ ในเดือนตุลาคม 2025 บริษัทแม่ของ Grammarly ประกาศรีแบรนดิ้งใหม่ โดยเปลี่ยนชื่อเป็น “Superhuman” ซึ่งสะท้อนให้เห็นว่าผลิตภัณฑ์ไม่ใช่แค่เครื่องมือเช็กไวยากรณ์ แต่เป็นกลุ่มตัวแทน AI สำหรับงานต่าง ๆ

ปัจจุบัน บริษัทได้ขยายสายผลิตภัณฑ์ไปยังการสนับสนุนงานวิจัย การเขียนอีเมล การจัดการตารางนัดหมาย และอัตโนมัติในกระบวนการทำงาน ฟีเจอร์ Expert Review เป็นหนึ่งในบริการ AI ตัวแทนใหม่ที่เปิดตัว โดยในคำอธิบายอย่างเป็นทางการ Grammarly ระบุว่า Expert Review ออกแบบมาเพื่อช่วยนักเรียน นักวิจัย และมืออาชีพในการปรับปรุงคุณภาพงานเขียน เช่น เมื่อผู้ใช้เขียนข้อเสนอทางการตลาด รายงานวิชาการ หรือเอกสารธุรกิจ ระบบจะวิเคราะห์เนื้อหาและให้ความเห็นในแบบจำลองของผู้เชี่ยวชาญ

บริษัทเน้นย้ำว่า ฟังก์ชันนี้ไม่ได้อ้างว่านักวิชาการเหล่านั้นเป็นผู้เข้าร่วมตรวจสอบจริง ๆ และไม่ได้รับรองความเห็นของพวกเขา แต่เป็นการรวบรวมผลงานวิจัยและข้อมูลจากโมเดลภาษาใหญ่เพื่อเสนอคำแนะนำ

อย่างไรก็ตาม การออกแบบในลักษณะ “จำลองมุมมองของผู้เชี่ยวชาญ” นี้ ก็ยังถูกวิพากษ์วิจารณ์ว่าอาจทำให้ผู้ใช้เข้าใจผิด คิดว่าความเห็นเหล่านั้นเป็นของนักวิชาการโดยตรง

AI จำลองบุคคลดังกลายเป็นเทรนด์ใหม่ในอุตสาหกรรมเทคโนโลยี

Grammarly ไม่ใช่บริษัทเดียวที่พยายามจำลองบุคคลหรือผู้เชี่ยวชาญด้วย AI ในช่วงไม่กี่ปีที่ผ่านมา หลายบริษัทเทคโนโลยีได้เปิดตัวผลิตภัณฑ์ในลักษณะเดียวกัน โดยหวังใช้ภาพลักษณ์ของบุคคลที่มีชื่อเสียงเพื่อเสริมประสบการณ์การโต้ตอบของ AI

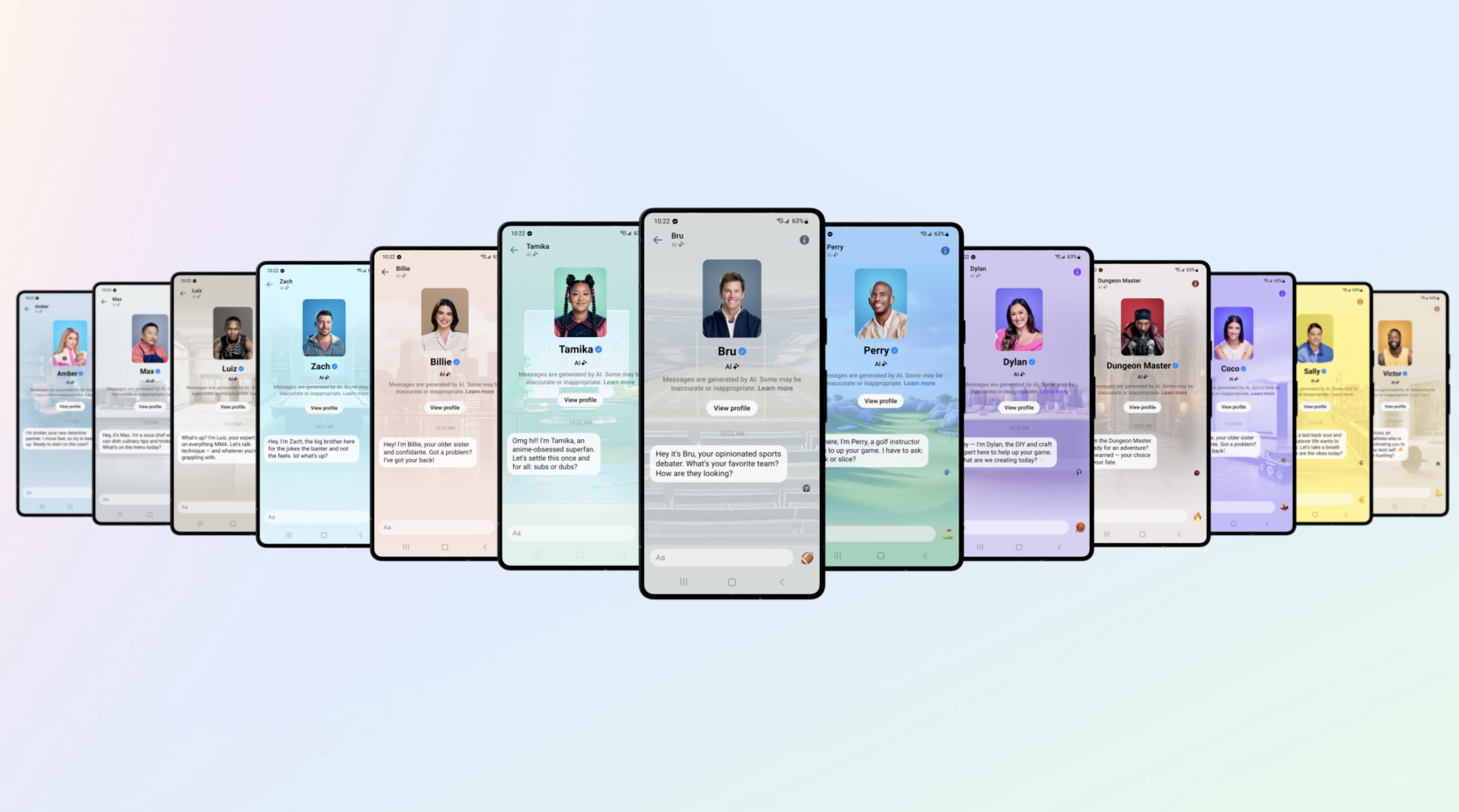

ในปี 2023 Meta ได้เปิดตัวบอทสนทนาบุคคลดังในแพลตฟอร์ม Meta AI รวมถึง Snoop Dogg นักร้องแร็พ NFL อย่าง Tom Brady นักแสดง Kendall Jenner และนักเทนนิส Naomi Osaka ซึ่ง AI เหล่านี้ใช้ภาพลักษณ์และสไตล์การพูดคุยของบุคคลดังเพื่อดึงดูดให้ผู้ใช้ลองใช้งาน

ภาพจาก: Meta ได้เปิดตัวบอทสนทนาบุคคลดังในแพลตฟอร์ม Meta AI

ในวงการการศึกษา ก็มีการนำแนวทางเดียวกันมาใช้ เช่น Khan Academy ซึ่งเปิดตัว AI ผู้ช่วย “Khanmigo” ที่อนุญาตให้นักเรียนสนทนาในบทบาทสมมติของบุคคลสำคัญ เช่น Winston Churchill อดีตนายกรัฐมนตรีอังกฤษ หรือ Harriet Tubman ผู้นำการเคลื่อนไหวในยุคใต้ดินของอเมริกา เพื่อเข้าใจบริบทและแนวคิดทางประวัติศาสตร์

อย่างไรก็ตาม เมื่อโมเดล AI ยิ่งสามารถจำลองบุคลิกและสไตล์ของบุคคลได้ดีขึ้น การถกเถียงเรื่องการอนุญาตและสิทธิส่วนบุคคลก็ยิ่งทวีความรุนแรงขึ้น นักวิชาการบางคนชี้ว่า การที่ AI ให้ความเห็นในนามของนักวิชาการ นักเขียน หรือบุคคลสำคัญ อาจส่งผลต่อความเข้าใจของสาธารณชนต่อมุมมองของบุคคลเหล่านั้นในอนาคต หากบริษัท AI ต้องการใช้ความคิดและภาพลักษณ์ของนักวิชาการหรือบุคคลสำคัญ ควรมีการอนุญาตและความโปร่งใสที่ชัดเจน มิฉะนั้น แม้จะเป็นเพียง “แรงบันดาลใจ” ทางเทคนิค ก็อาจเกี่ยวข้องกับปัญหาด้านชื่อเสียง ทรัพย์สินทางปัญญา และจริยธรรมทางวิชาการในที่สุด