Les chercheurs d'Apple : Les modèles d'IA sont encore loin de la capacité de raisonnement au niveau AGI

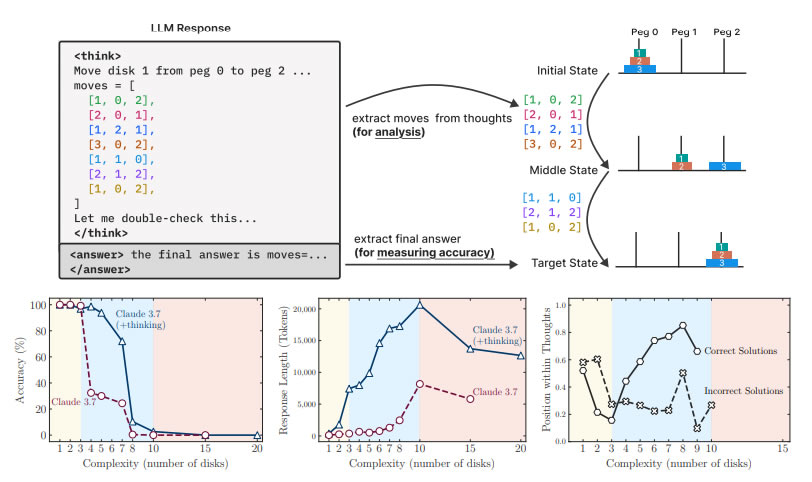

La course au développement de l’intelligence artificielle générale (AGI) est encore longue, selon des chercheurs d’Apple, qui estiment que les modèles d’IA de pointe comme ChatGPT et Claude rencontrent encore des difficultés en matière de raisonnement. Bien qu’il existe des modèles de raisonnement avancés (LRMs), leurs capacités et limitations ne sont pas encore bien comprises. Les évaluations actuelles se concentrent principalement sur la précision des réponses finales sans donner d’aperçu sur les capacités de raisonnement.

Des recherches montrent que les LRM ne généralisent pas efficacement les arguments et rencontrent souvent un effondrement de la précision lorsque la complexité augmente. Les chercheurs concluent que ces modèles imitent simplement les arguments sans réellement les comprendre, ce qui ne répond pas aux exigences de l’AGI. L’AGI reste un objectif lointain, bien que certains leaders de l’industrie croient qu’elle pourrait être atteinte dans les prochaines années.