开发者让 Claude 像穴居人一样说话以降低成本——而且真的奏效

简而言之

- 一名开发者发现,强迫 Claude 用穴居人讲话的方式会大幅减少输出 token,因此成本也会降低,最高可达 75%。

- 互联网立刻把它变成了一个 GitHub 技能。

- 在 Anthropic 每个输出 token 收费如此之高的情况下,“穴居人模式”就不再只是个笑话,而更像是一种预算策略。

介于提示工程和表演艺术之间,一位开发者在 Reddit 上发布了一项发现,让 AI 社区在注意之前先笑了:教 Claude 用史前人类的方式交流,并观察你的 token 账单最多会缩小 75%。 这条帖子上周冲上了 r/ClaudeAI,随后累计了超过 400 条评论和 10K 票——这是一种罕见的组合:既有真正的技术洞察,又有荒诞的喜剧,而互联网往往会奖励这种内容。

机制很简单。开发者没有让 Claude 先用客套话“热身”,而是逐步叙述它所做的每一步,并以“我可以继续帮你”的提议收尾,从而迫使模型使用简短、去掉多余内容的句子。先用工具、先给结果,不要解释。一个本该大约消耗 180 个输出 token 的普通网页搜索任务,降到了大约 45 个。原帖作者声称,输出最多可减少 75%,方法是让模型听起来就像刚刚“发现了火”。

用穴居人的说法来说,正如一位 Reddit 用户说的:“为什么要用很多词浪费时间,当用少量词就能把事情搞定?” 这项技术并不影响输入上下文:完整的对话历史、附加文件以及系统指令——模型每一轮都会重新阅读这些内容。通常,这些输入的规模会远远大于输出,尤其是在更长的编码会话中。现实场景下统计所有这些输入,整体节省大约 25%,而不是 75%。依然很有意义,只是不如标题数字夸张。 另外,给模型喂入正常指令也是个好主意。不要把“穴居人”式说法强塞给它,否则可能会一路走向“垃圾输入,垃圾输出”的局面。

还有一个问题:智能退化。帖子里有少数研究者认为,强迫 AI 去扮演一个不那么复杂的角色,可能会主动损害它的推理质量——也就是,语言层面的约束可能会渗进认知层面。这个担忧尚未被确凿地证实或否定,但在评估结果时值得考虑。 技能很好,技能就会病毒式传播 尽管有这些顾虑,这项技术几乎立刻在 GitHub 上找到了第二次生命。

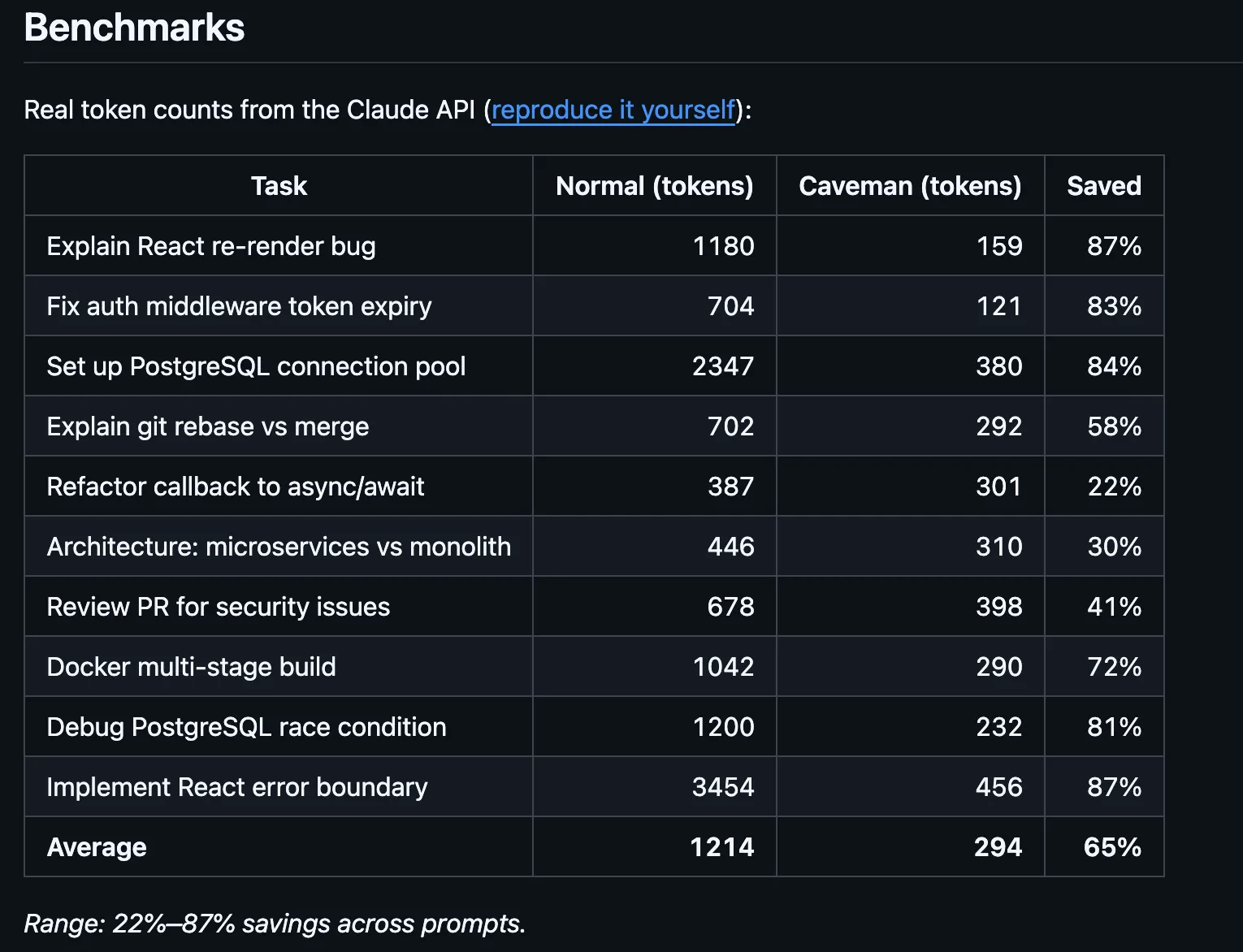

开发者 Shawnchee 把这套规则打包成一个可独立使用的“穴居人技能”,适配 Claude Code、Cursor、Windsurf、Copilot,以及 40 多个其他代理。这个技能把方法凝练成 10 条规则:不要填充短语,在解释之前先执行,不要元评论,不要铺垫,不要收尾,不要工具播报;只有在需要时才解释;让代码自己说话;把错误当作需要修复的东西,而不是要叙述出来。 仓库中的基准测试(用 tiktoken 验证)显示:在网页搜索任务上输出 token 可减少 68%,在代码修改上减少 50%,在问答交互上减少 72%——在四项标准任务的平均输出减少达到 61%。

由开发者 Julius Brussee 维护的另一个平行仓库采用了略有不同的做法,把同样的想法包装成一个带 562 个 GitHub stars 的 SKILL.md 文件。规范是:像聪明的穴居人一样回复,砍掉冠词、填充内容和客套话,保留所有技术实质。代码块保持不变。错误信息必须原样引用。技术术语保持不变。穴居人只用英语外壳来表达事实。

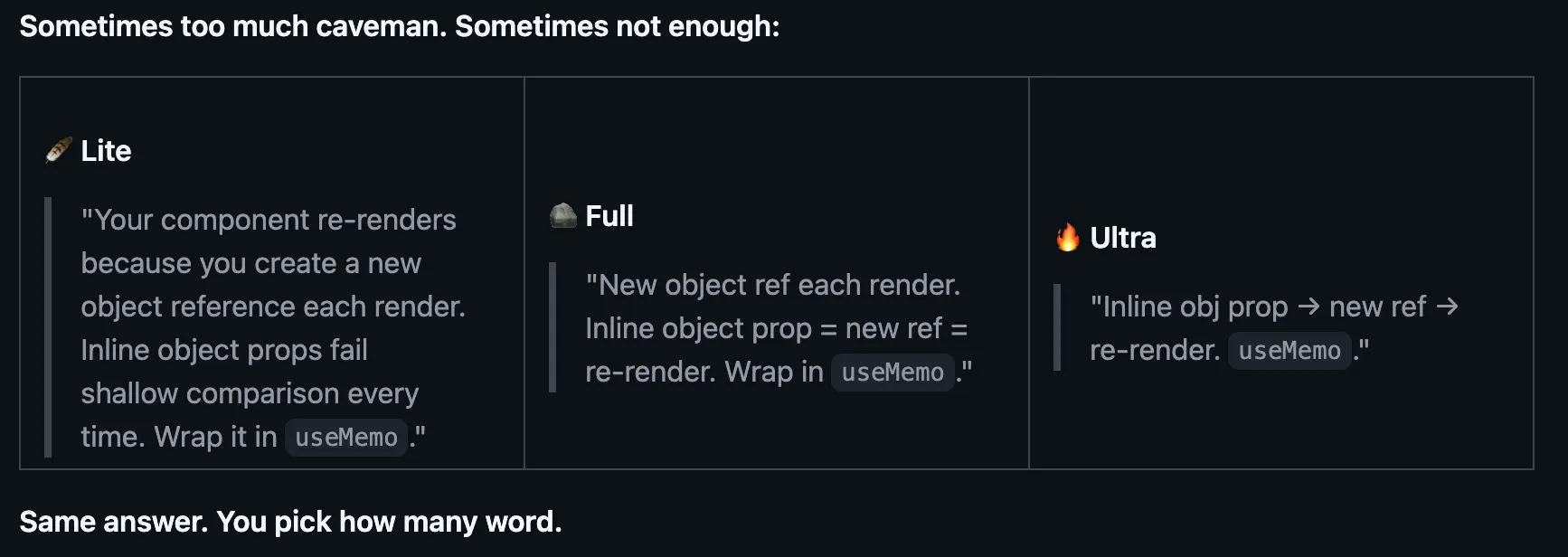

这个版本甚至还提供了不同的模式,用来影响你想剥离到什么程度:在 Normal、Lite 和 Ultra 之间切换。这些模型做的是完全相同的工作,但给出的答案更短,因此随着时间推移会带来很大的节省。

更广泛的成本背景让这个笑话更“锋利”。Anthropic 是按每个 token 计价来看最昂贵的模型之一。对那些在会话中每次包含几十个回合来跑 agentic 工作流的开发者来说,输出冗长并不是一种风格抱怨,而是一项费用。只要穴居人“哼哼”就能替代对模型刚刚做了什么的五句总结,那么跨越数千次 API 调用累计省下的 token 就会变成一笔可观的节省。

穴居人技能可以通过一条命令使用 skills.sh 安装,并且能在各个项目中全局生效。无论它是否让 Claude 的表达略显不那么“能说会道”,它已经让很多开发者变得明显没那么恼火了。