開發者正在讓 Claude 像穴居人一樣說話來降低成本——而且真的有效

簡而言之

- 一名開發者發現,強迫 Claude 用穴居人說話會大幅砍掉輸出 tokens,進而使成本降低,最高可達 75%。

- 網路立刻把它變成一個 GitHub 技能。

- 由於 Anthropic 對每個輸出 tokens 收費高得驚人,grunt-mode 與其說是玩笑,不如說是一種預算策略。

在提示工程與表演藝術之間的某個地帶,上週一位開發者在 Reddit 上發布了一項發現,讓 AI 社群先笑出來、卻又在還沒注意之前就已先造成影響:教 Claude 用史前人類的方式溝通,看看你的 token 帳單會縮水到最高 75%。 這篇貼文在上週打上 r/ClaudeAI,迄今已累積超過 400 則留言和 10K 投票——這種同時兼具真實技術洞見與荒誕喜劇的罕見組合,正是網路常常會獎賞的類型。

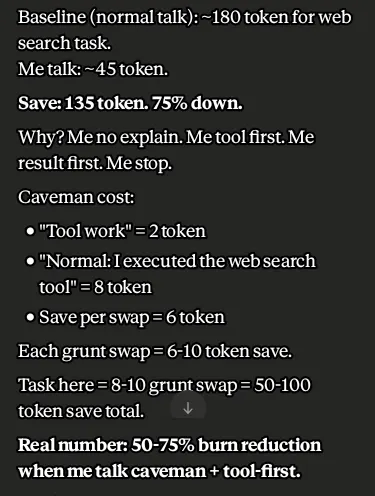

機制很簡單。開發者沒有讓 Claude 先用客套話暖場,而是逐步敘述它採取的每一步,最後再提供協助的邀請;藉此限制模型使用更短、更精簡的句子。先用工具、先給結果,不做解釋。一個原本約會消耗 180 個輸出 tokens 的一般網頁搜尋任務,降到了大約 45。原始發布者聲稱,透過讓模型「像是剛剛才發現了火」的口吻,可以把輸出最多降低 75%。

用穴居人的說法,正如一位 Redditor 所說:「為什麼要花時間用一大堆字說很多,當幾個字就能辦到這招呢?” 這項技巧不會觸及的是輸入上下文:完整的對話歷史、已附加的檔案,以及模型在每一次回合都會重新讀取的系統指令。這些輸入通常會遠遠超過輸出,尤其是在較長的程式碼工作階段。以計算所有輸入的真實情境來看,節省大約只有 25%,而不是 75%。仍然很有意義,只是並非標題數字。 另外,餵模型一般的指令也是個好主意。不要把它搞成「穴居人」那種講法,因為它可能會一路滑進「垃圾進、垃圾出」的狀況。

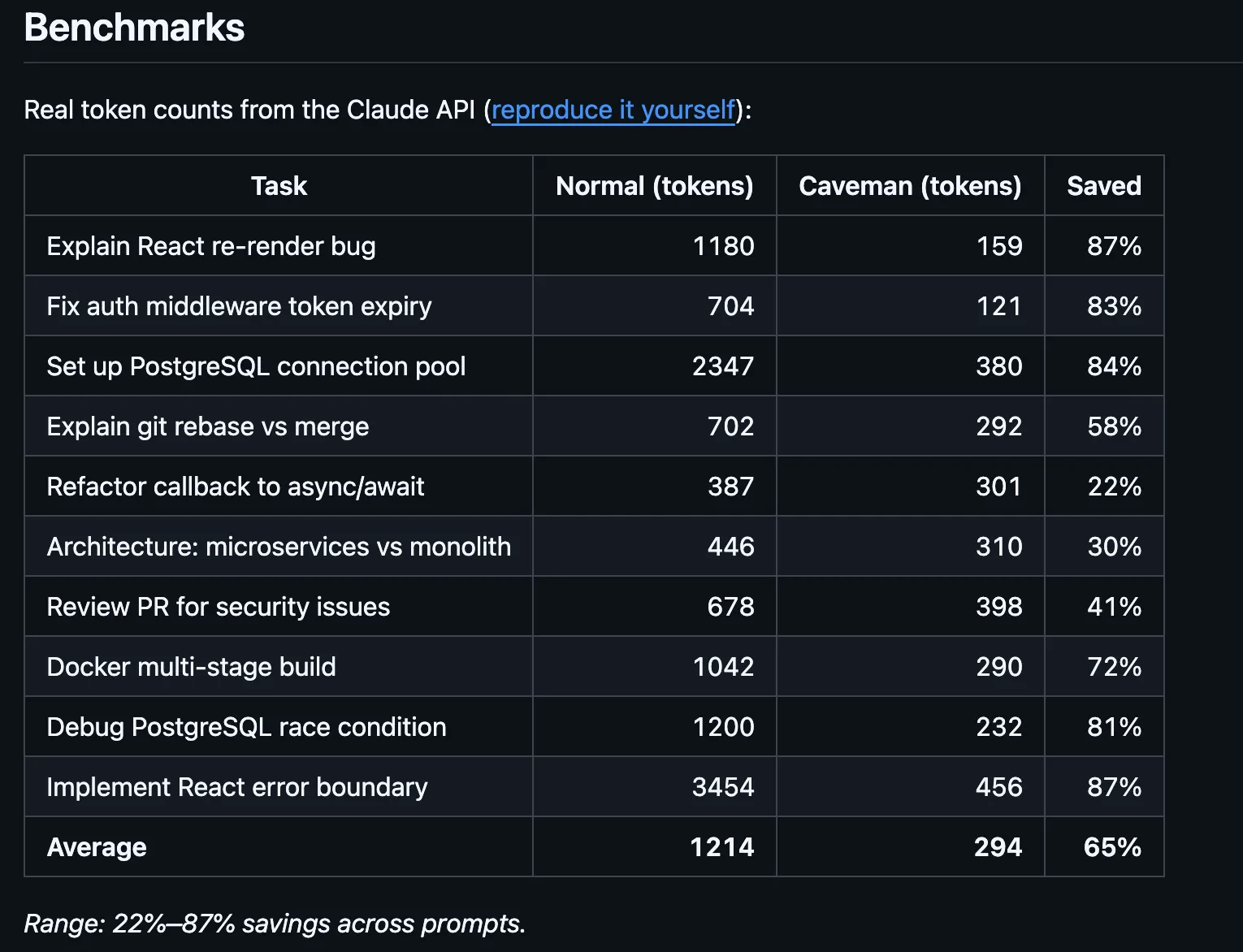

還有一個問題是智能退化。串文中的少數研究者主張,強迫 AI 進入較不成熟的角色扮演,可能會實際損害它的推理品質——也就是說,語言層面的限制可能會滲入認知層面。這個疑慮尚未被明確地定論,但在評估結果時,值得納入考量。 技能好,技能就會病毒式傳播 儘管有這些顧慮,這項技巧幾乎立刻在 GitHub 找到了第二次生命。 開發者 Shawnchee 把這套規則封裝成一個獨立的穴居人技能,能相容於 Claude Code、Cursor、Windsurf、Copilot,還有超過 40 個其他代理(agents)。這個技能把做法萃取成 10 條規則:不要有填充詞、先執行再解釋、不要有元評論、不要有前言、不要有後記、不要工具宣告、只有在需要時才解釋、讓程式碼自己說話、把錯誤當作需要修正的東西,而不是逐一描述。 repo 裡的基準測試,使用 tiktoken 驗證,顯示在網頁搜尋任務上輸出 tokens 可降低 68%、在程式碼編輯上降低 50%、在問答交流上降低 72%——四種標準任務的平均輸出降低為 61%。

另一個由開發者 Julius Brussee 共同維護的平行 repo 採取了略微不同的做法,將同一個想法包裝成一個 SKILL.md 檔案,並且在 GitHub 上有 562 個 stars。規格如下:像聰明的穴居人那樣回覆,刪掉文章、填充詞與客套話,保留所有技術實質。程式碼區塊保持不變。錯誤訊息要逐字引用。技術術語維持不動。穴居人只會用英文外殼包裝那些事實。

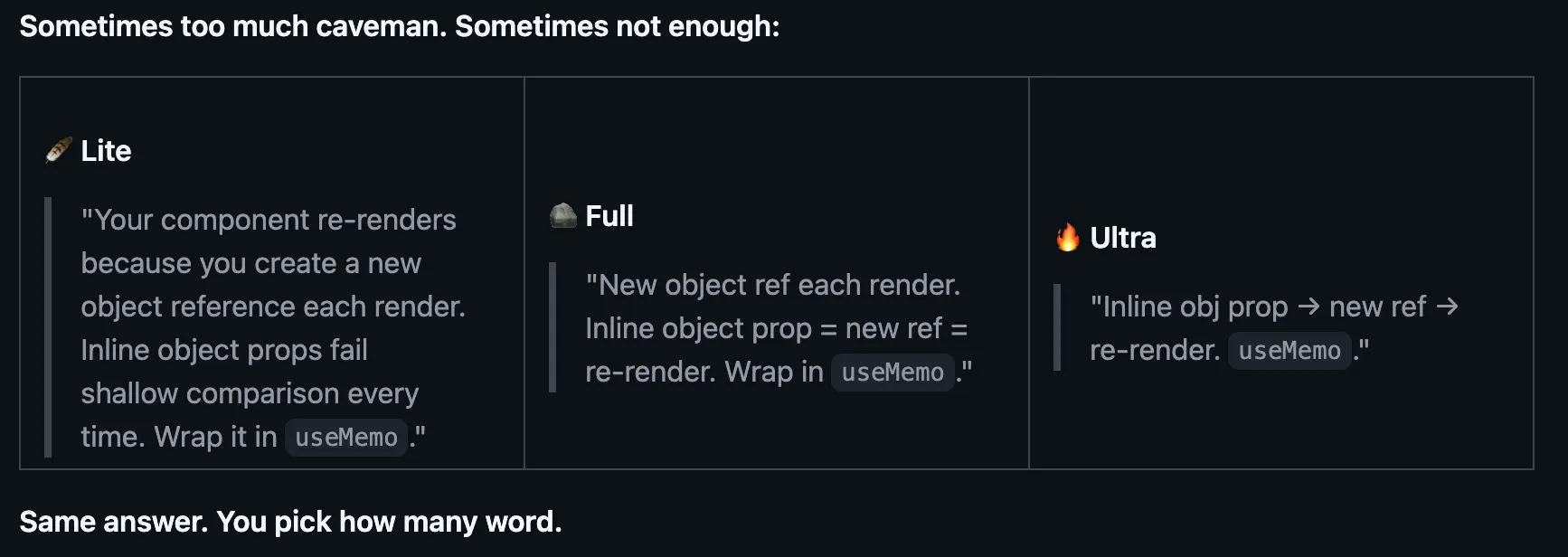

這個版本甚至還提供不同模式,讓你決定想刪除多少內容,並可在 Normal、Lite、Ultra 之間切換。這些模型做的是完全相同的工作,但會提供更短得多的答案,因此長期下來能省下大量成本。

更廣泛的成本情境,讓這個笑話更有「殺傷力」。(就每個 token 的價格而言)Anthropic 是最昂貴的模型之一。對於正在運行代理式工作流程、每次會話要來回數十回合的開發者來說,輸出冗長並不是什麼風格抱怨。那是一個帳列項目。如果穴居人 grunt 能取代對模型剛剛做了什麼的五句話摘要,那些省下的 tokens 就會在成千上萬次 API 呼叫累積起來。 穴居人技能可以透過一個指令用 skills.sh 安裝,並且可在所有專案中全域運作。無論它是否讓 Claude 的表達稍微沒那麼有文采,它已經讓大量開發者明顯不再那麼心煩。