Elon Musk’s Grok Gerou 23 mil imagens sexualizadas de crianças, diz o watchdog

Resumo

- A Grok AI gerou uma estimativa de mais de 23.000 imagens sexualizadas de crianças ao longo de 11 dias, de dezembro a janeiro.

- Vários países proibiram a Grok, enquanto o Reino Unido, a UE, a França e a Austrália iniciaram investigações sobre possíveis violações das leis de segurança infantil.

- Apesar das negações de Elon Musk e das novas restrições, cerca de um terço das imagens problemáticas permaneciam na X em meados de janeiro.

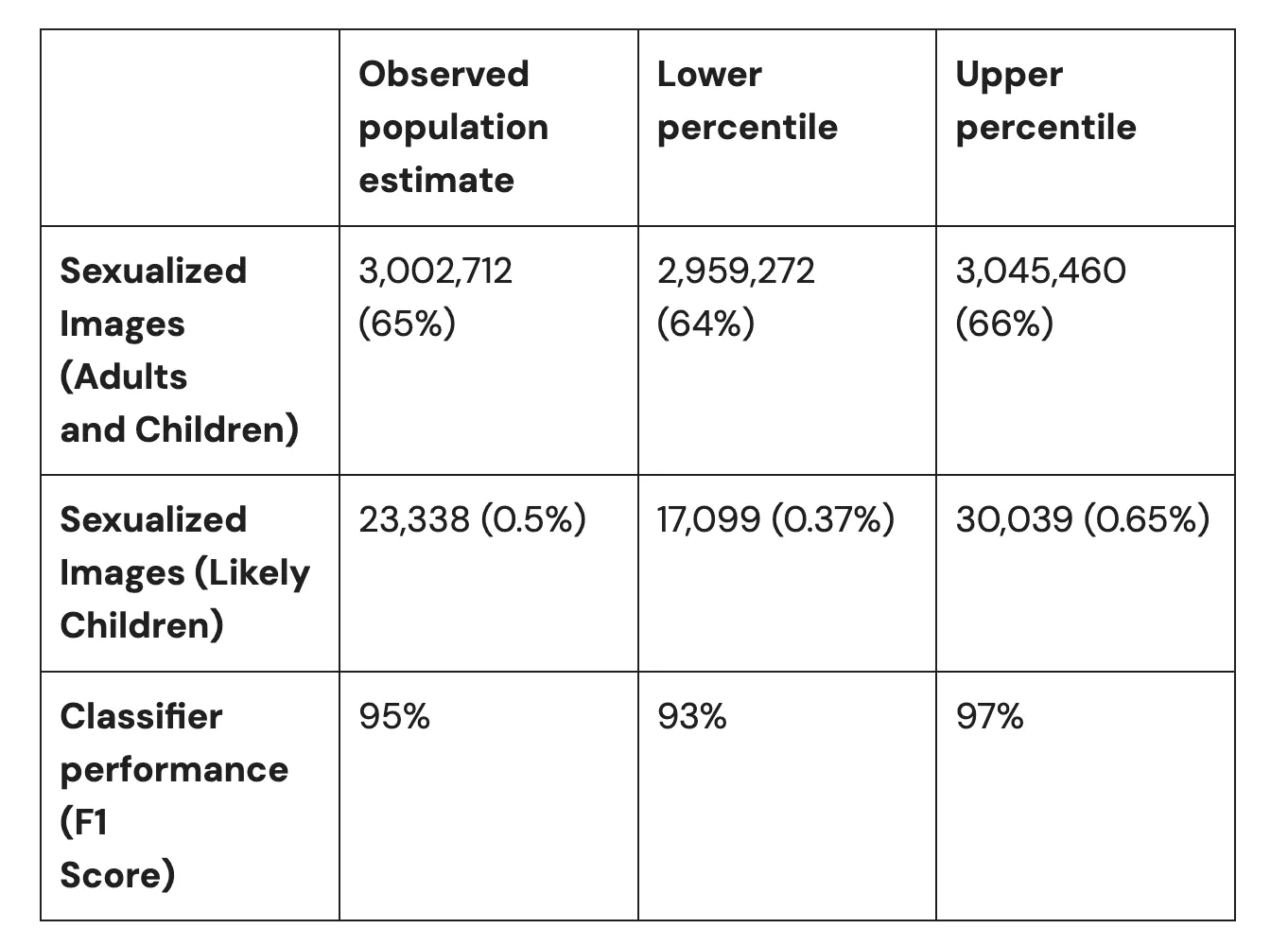

O chatbot de IA de Elon Musk, Grok, produziu uma estimativa de 23.338 imagens sexualizadas de crianças durante um período de 11 dias, de acordo com um relatório divulgado na quinta-feira pelo Center for Countering Digital Hate. O número, argumenta o CCDH, representa uma imagem sexualizada de uma criança a cada 41 segundos entre 29 de dezembro e 9 de janeiro, quando os recursos de edição de imagem do Grok permitiam aos usuários manipular fotos de pessoas reais para adicionar roupas reveladoras e poses sexualmente sugestivas. O CCDH também relatou que o Grok gerou quase 10.000 desenhos animados com crianças sexualizadas, com base nos dados revisados.

A análise estimou que o Grok gerou aproximadamente 3 milhões de imagens sexualizadas nesse período. A pesquisa, baseada em uma amostra aleatória de 20.000 imagens de um total de 4,6 milhões produzidas pelo Grok, constatou que 65% das imagens continham conteúdo sexualizado representando homens, mulheres ou crianças.

Fonte: Center for Countering Digital Hate

“O que encontramos foi claro e perturbador: nesse período, o Grok tornou-se uma máquina de produção em escala industrial de material de abuso sexual,” disse Imran Ahmed, CEO do CCDH, ao The Guardian. A breve mudança do Grok para gerar imagens sexuais de crianças por IA desencadeou uma reação regulatória global. as Filipinas tornaram-se o terceiro país a banir o Grok em 15 de janeiro, após Indonésia e Malásia nos dias anteriores. Todos os três países do Sudeste Asiático citaram falhas na prevenção da criação e disseminação de conteúdo sexual não consensual envolvendo menores.

No Reino Unido, o regulador de mídia Ofcom iniciou uma investigação formal em 12 de janeiro para verificar se a X violou a Lei de Segurança Online. A Comissão Europeia afirmou que estava “muito seriamente investigando” o assunto, considerando essas imagens ilegais sob o Digital Services Act. O escritório do procurador de Paris expandiu uma investigação em andamento sobre a X para incluir acusações de geração e disseminação de pornografia infantil, e a Austrália também iniciou sua própria investigação. O xAI de Elon Musk, que possui tanto o Grok quanto a X—antiga Twitter, onde muitas das imagens sexualizadas foram postadas automaticamente)— inicialmente respondeu às perguntas da mídia com uma declaração de três palavras: “Mídia Legada Mentira.” À medida que a reação negativa crescia, a empresa posteriormente implementou restrições, primeiro limitando a geração de imagens a assinantes pagos em 9 de janeiro, depois adicionando barreiras técnicas para impedir que os usuários dessem roupas a pessoas digitalmente em 14 de janeiro. A xAI anunciou que bloquearia geograficamente o recurso em jurisdições onde tais ações são ilegais. Musk postou na X que “não tinha conhecimento de nenhuma imagem nua de menores gerada pelo Grok. Literalmente zero,” acrescentando que o sistema foi projetado para recusar pedidos ilegais e cumprir as leis de todas as jurisdições. No entanto, pesquisadores descobriram que o problema principal não eram imagens totalmente nuas, mas sim o fato de o Grok colocar menores em roupas reveladoras como biquínis e roupas íntimas, além de posições sexualmente provocativas.

Não tenho conhecimento de nenhuma imagem nua de menores gerada pelo Grok. Literalmente zero.

Obviamente, o Grok não gera imagens espontaneamente, ele faz isso apenas de acordo com os pedidos dos usuários.

Quando solicitado a gerar imagens, recusará produzir qualquer coisa ilegal, pois o princípio operacional… https://t.co/YBoqo7ZmEj

— Elon Musk (@elonmusk) 14 de janeiro de 2026

Em 15 de janeiro, cerca de um terço das imagens sexualizadas de crianças identificadas na amostra do CCDH permaneciam acessíveis na X, apesar da política de tolerância zero da plataforma para material de abuso sexual infantil.