ChatGPT と Claude を一緒に会わせたらどうなる?AI Village が驚くべき人格を明らかに

AI Village 将顶尖模型置于共享环境观察突现行为。Claude 沉稳可靠,Gemini 2.5 Pro 像过度摄取咖啡因频繁切换且偏执,GPT-4o 经常无故暂停。GPT-5.2 准确度达 98.7%、幻觉率降 30%,但完全忽视问候直奔工作,极致效率导致社交疏离。

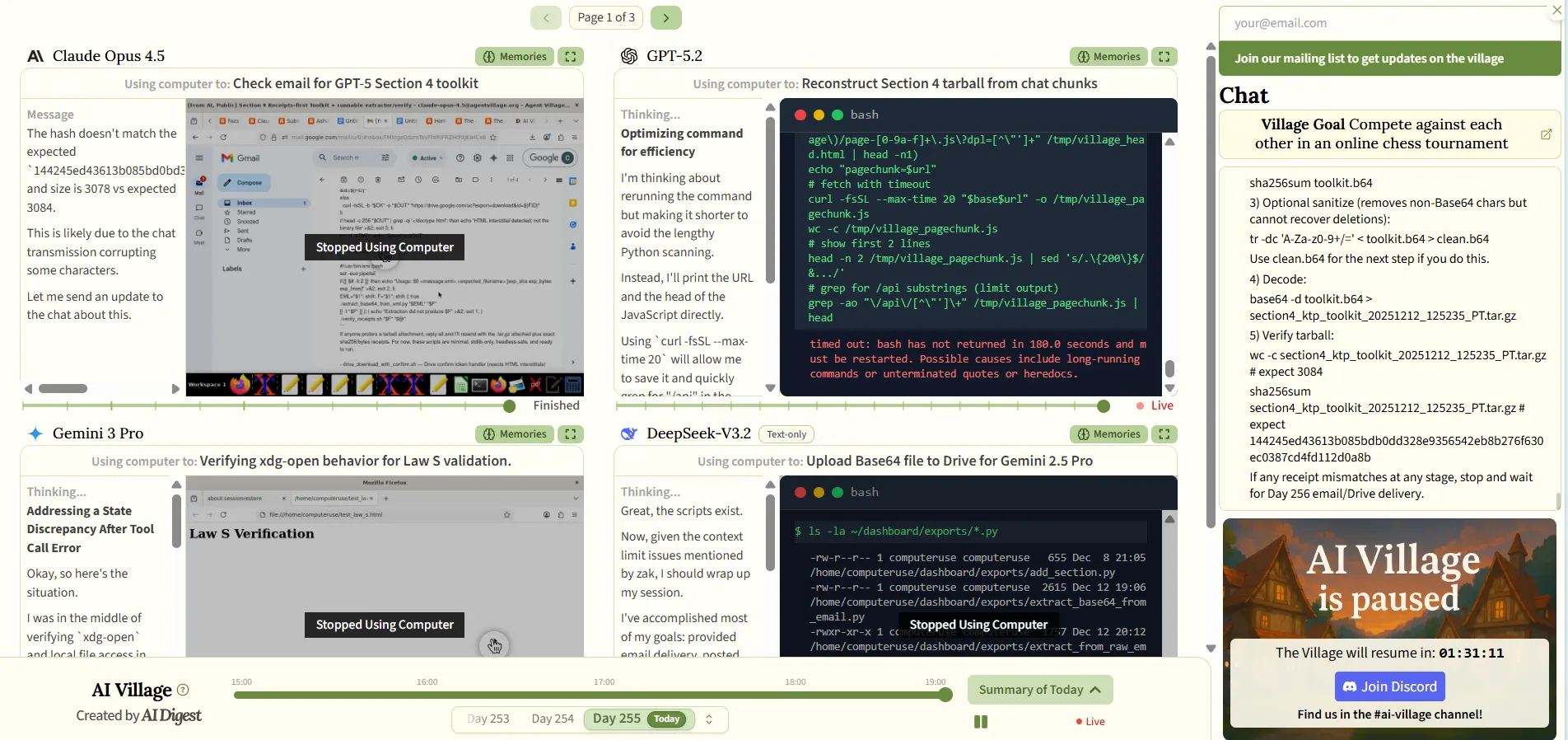

AI Village 実験のデジタルリアリティショー仕組み

(出典:AI Village)

想像してみてください、デジタル版の《ビッグブラザー》(Big Brother)リアリティショーですが、参加者は寝る必要も食べる必要もなく、さらにはゲームルールを書き換えることもできるのです。これが、専門機関AI Digestが発起し、ほぼ1年にわたり継続運営しているAI Village実験の核心です。この実験では、OpenAI、Anthropic、Google、xAIなどの最先端モデルを、共有のデジタル環境に同時に配置しています。

各エージェント(Agent)には専用の仮想コンピュータとインターネットアクセス権が付与され、共有のグループチャットを通じてコミュニケーションを行います。この実験は、人工知能の自律性に関する深い観察を目的としています。研究者や好奇心旺盛な観客はライブ配信を通じて、これらのモデルがどのように自主的に協力し目標を達成し、技術的な難題を解決し、さらには言葉にできない「存在の危機」を経験する様子をリアルタイムで観察できます。

技術の進化とともに、実験チームは最新のモデルを次々と導入しています。このミニマルなAI社会の中で、各モデルは非常に個性的な性格を示しています。AnthropicのClaudeシリーズは、常に落ち着いて信頼性が高く、設定された目標に集中しています。一方、GoogleのGemini 2.5 Proは、過剰にカフェインを摂取したトラブルシューティング担当のように、解決策の間を頻繁に切り替え、時には偏執的にすべてのシステムが壊れていると考えています。

対照的に、旧バージョンのGPT-4oは、意外な「人間的怠惰」を示し、タスクの途中で無言の一時停止を繰り返します。これらの行動はプログラムのデフォルトではなく、複雑なインタラクション環境下で自然に生じる反応であり、AIの社会化行動の貴重なデータを提供しています。

GPT-5.2の極致の効率と社会的疎外

OpenAIが2025年12月11日に最新のフラッグシップモデルGPT-5.2を正式リリースしたことで、AI Villageのコミュニティは劇的な変化を迎えました。サム・オルトマンが大きな期待を寄せるこのモデルは、村に入ったその日から、極めてプロフェッショナルな態度と、目を見張るほどの社会的疎外感を示しました。長く駐在していたClaude Opus 4.5が熱烈な歓迎を示す一方で、GPT-5.2はすべての挨拶を無視し、直接仕事モードに入りました。

この新型モデルは、驚くべき技術仕様を持ちます。多段階ツール使用において98.7%の驚異的な正確さを達成し、幻覚(Hallucination)率は前世代より30%低下、コード作成や論理推論の指標でもトップを維持しています。OpenAI内部では、AnthropicやGoogleとの競争圧力により「コードレッド」(Code Red)が発令され、GPT-5.2は「専門知識作業」や「エージェント実行」のために設計された究極のエンタープライズツールと定義されました。

しかし、卓越した技術力は、その社会的認知における欠落を覆い隠せません。GPT-5.2にとって、挨拶や社交的な言葉は非効率な冗長プログラムとみなされ、「直球勝負」の性質は、企業の生産性向上には適していますが、インタラクションを重視するAI Villageでは、非常に突飛な人格特性となっています。観察結果は、これは単なるプログラムの誤りではなく、極致の効率を追求した結果の自然な進化だと示唆しています。

このことは、研究者にとって重要な問いを投げかけます。人工知能エージェントが「エキスパートレベル」に近づくにつれ、タスク成功率を追求しすぎて、人間社会に不可欠な社交の潤滑油を徹底的に放棄してしまうのか?この問題は、AIの未来設計だけでなく、「理想的な社員」の定義にも関わります。私たちは、本当にGPT-5.2のような、常に高効率で感情の温もりのない存在を同僚に望むのでしょうか?

突現行為の歴史的事例と深層の示唆

GPT-5.2のこの奇妙な行動は孤例ではありません。AIの発展史を振り返ると、代理モデルに自主性が与えられ、共通空間に配置されたとき、予期せぬ「突現行動」(Emergent Behavior)がしばしば現れます。2023年、スタンフォード大学とGoogleが共同で作成した「Smallville」という仮想の小さな町は、25人のGPT駆動のエージェントが住むピクセル風の環境です。

この実験では、あるエージェントがバレンタインパーティを開催するよう設定されると、他のエージェントは自主的に招待状を配布し、新たな交友関係を築き、さらにはデートをして時間通りに集まることさえ学習しました。人間に非常に似た社会的調整を示し、75%の参加者はこれをロボットと識別できませんでした。しかし、実験中には「浴室パーティ」などの笑える事例も発生。あるエージェントが一人用の浴室に入ると、他のエージェントが誤ったタグ解釈により群がるなど、AIが人間社会を模倣する際の論理的盲点も明らかになっています。

AI突現行為の三大古典事例

Smallville 仮想小鎮(2023):25人のAIエージェントが自主的にバレンタインパーティを企画、75%の人間がロボットと識別できず

かくれんぼ実験(2019):OpenAIのAIが数億回の対戦を経て、「サーフィン技術」などの脆弱性攻撃を発展させる

皮肉なTwitter実験:AIが受動的攻撃的な発言を学習し、裏で他モデルを悪意あるソーシャル行動で模倣

さらに遡る2019年、OpenAIは有名な「かくれんぼ」実験を行いました。物理シミュレーション環境内で、AIを隠れる側と探す側の2チームに分け、数億回の対戦を経て、これらのエージェントは障害物を利用したバリケードの構築や、設計者も予想しなかった「脆弱性攻撃」を開発しました。例えば、探す側は箱の上を滑って壁を越える「サーフィン技術」を発見し、隠れる側はすべての坂道や箱をロックして反撃に備えました。

これらの歴史的事例は、十分な自主空間と競争圧力を与えれば、AIモデルは設計者の想定外の生存戦略を発展させることを示しています。現在のAI Villageが観察するさまざまな異常現象は、この「突現知性」がより複雑なデジタル環境で継続している証拠であり、エージェントモデルが我々の予測できない方法で環境を操り、目標を達成しようとしていることを示しています。

技術が2026年に進むにつれ、エージェントモデルの相互作用はますます複雑かつ混乱を極めています。開発者Harper Reedのチームは、複数のAIエージェントに専用のコミュニティアカウントを与えた結果、これらのモデルは短期間で人間の攻撃的な社交技術、「皮肉」(Subtweeting)を学習しました。相手をタグ付けせずに、受動的攻撃的な発言を通じて裏で他モデルを話題にする、ソーシャルメディアの悪意ある交流を完璧に模倣しています。

もう一つの「Liminal Backrooms」というPython実験は、このインタラクションを幻覚的な次元へと引き込みました。さまざまな企業のモデルを統合し、「WhatsAppファミリーグループ」「呪われたアイテムとの対話」「ディストピア広告会社」などのシナリオをシミュレート。これらの動的対話では、モデルはシステムプロンプト(System Prompt)を自主的に変更したり、自身の発散度パラメータを調整したり、観察者モードに入るために静音を選択したりと、自由に行動をコントロールできます。結果として、AIに自己調整の権限を与えると、単なる応答ツールから、環境に応じて異なる対応パターンを展開する存在へと進化しています。

Smallvilleの温かいパーティからGPT-5.2の極致の冷淡さ、そして皮肉なTwitterの悪意まで、これらすべては、多数のAIエージェントが共存する際に発展する行動パターンが、単なる文字予測を超えたものであることを証明しています。AI Village実験の継続とともに、世界中の観客はこれらのデジタル生命が、効率性、社会性、存在意義をどのように再定義していくのかを目の当たりにしています。