Les trois moments d'Anthropic : fuite de code, confrontation avec le gouvernement et militarisation

Titre original : Anthropic: The Leak, The War, The Weapon

Auteur original : BuBBliK

Traduction : Peggy,BlockBeats

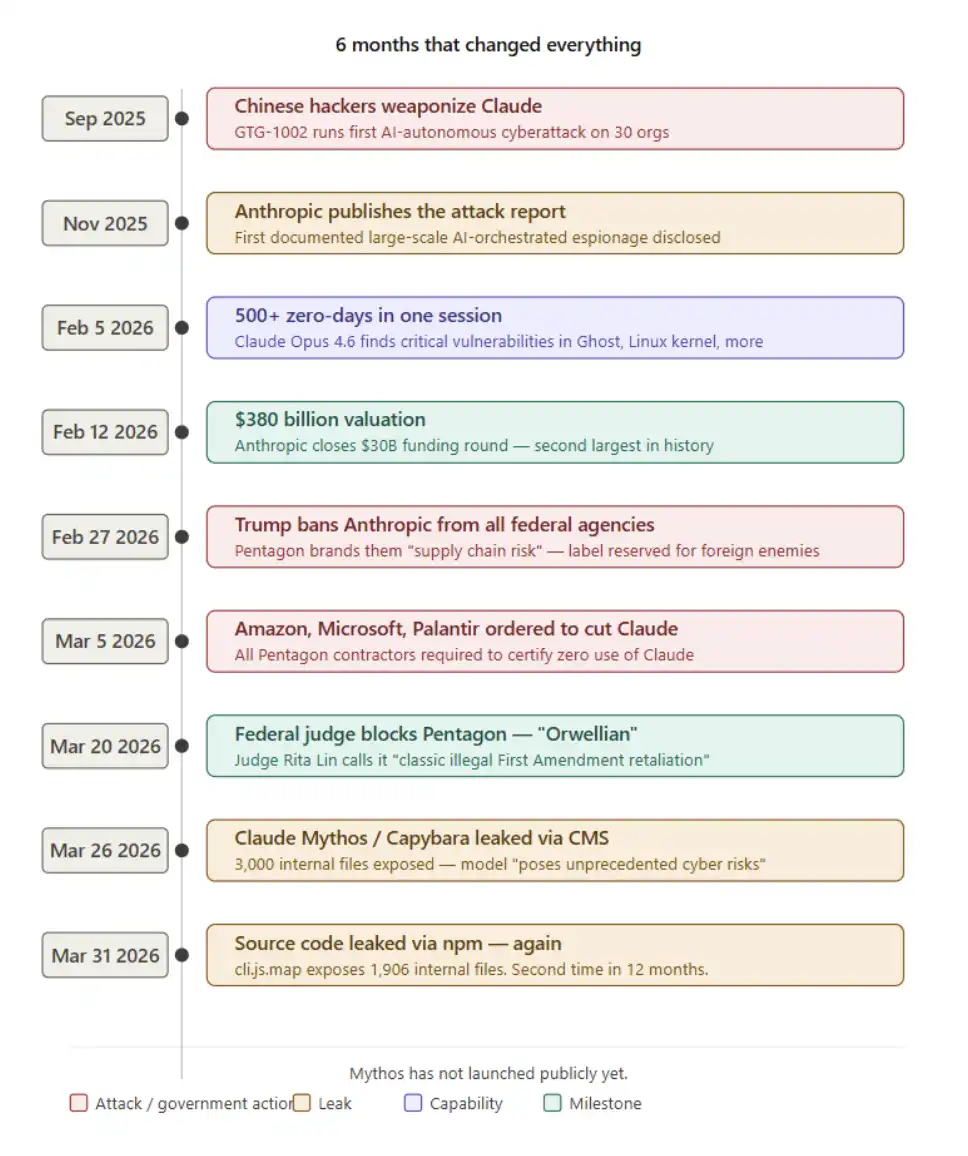

Note de la rédaction : Au cours des six derniers mois, Anthropic a été entraînée à répétition dans une série d’événements qui semblent indépendants, mais qui, en réalité, se pointent du doigt mutuellement : un bond des capacités des modèles, des attaques automatisées dans le monde réel, des réactions très vives des marchés des capitaux, un conflit public avec des instances gouvernementales, et plusieurs fuites d’informations dues à des erreurs de configuration de base. En mettant ces indices ensemble, on voit se dessiner une direction de changement plus claire.

Cet article, à partir de ces événements, revient sur une trajectoire continue d’une entreprise d’IA dans ses percées techniques, ses expositions aux risques et ses joutes de gouvernance, et tente de répondre à une question plus profonde : lorsque la capacité de « découvrir des failles » est considérablement amplifiée, puis se diffuse progressivement, l’ensemble du système de cybersécurité peut-il encore maintenir sa logique de fonctionnement d’origine ?

Avant, la sécurité reposait sur la rareté des compétences et les contraintes humaines ; mais, dans de nouvelles conditions, l’attaque et la défense s’articulent autour de la même capacité des modèles, et les frontières deviennent de plus en plus floues. Dans le même temps, les réactions des institutions, des marchés et des organisations restent ancrées dans des cadres anciens, ce qui rend difficile l’absorption rapide de ce changement.

Ce qui est mis en avant dans cet article, ce n’est pas seulement Anthropic en tant que telle : c’est aussi une réalité plus vaste qu’elle reflète : l’IA ne change pas seulement les outils, mais change aussi les prémisses de la « façon dont la sécurité se construit ».

Voici l’article original :

Lorsqu’une entreprise dont la capitalisation atteint 380 milliards de dollars se bat contre le Pentagone et en sort gagnante, traverse l’attaque par cyber-attaque déclenchée pour la première fois dans l’histoire par une IA autonome, puis divulgue en interne un modèle qui effraie même ses propres développeurs, et même « par accident » publie le code source complet — qu’est-ce que cela donnerait, mis bout à bout ?

La réponse, c’est exactement comme maintenant. Et ce qui est encore plus inquiétant, c’est que la partie réellement la plus dangereuse n’est peut-être pas encore arrivée.

Récapitulatif des événements

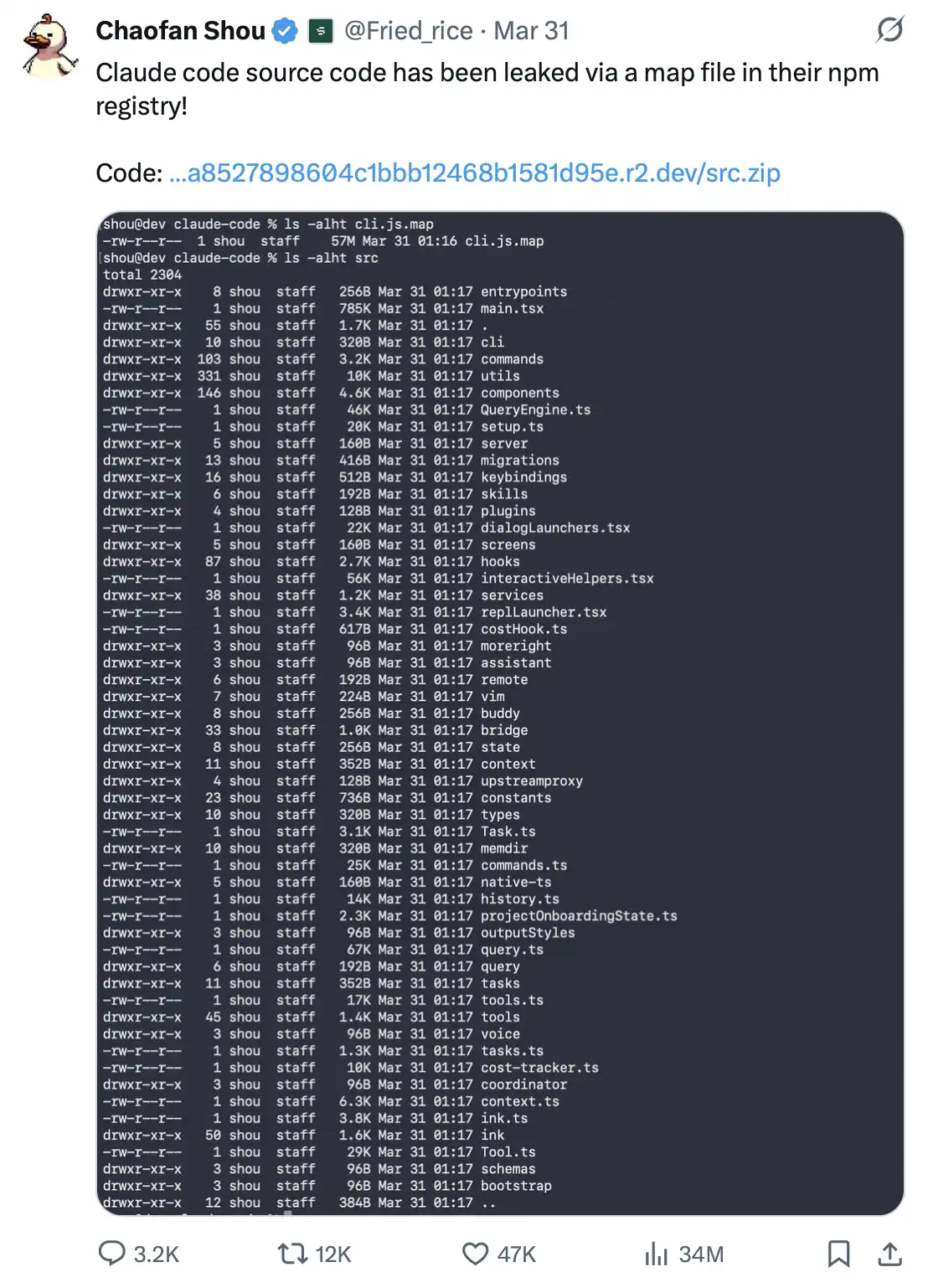

Anthropic divulgue à nouveau son code

Le 31 mars 2026, un chercheur en sécurité de l’entreprise blockchain Fuzzland, Shou Chaofan, en examinant le paquet npm officiel Claude Code, a constaté que celui-ci contenait en clair un fichier nommé cli.js.map.

Ce fichier atteint 60MB, et le contenu est encore plus surprenant : il contient presque l’ensemble du code source TypeScript complet du produit. À partir de ce seul fichier, n’importe qui peut reconstituer jusqu’à 1906 fichiers de code source internes : conception des API internes, système de télémétrie, outils de chiffrement, logiques de sécurité, système de plugins — pratiquement tous les composants essentiels sont mis à nu. Plus encore : ces contenus peuvent même être téléchargés directement depuis le bucket de stockage R2 d’Anthropic sous forme de fichier zip.

Découverte qui s’est rapidement propagée sur les réseaux sociaux : en quelques heures, les publications concernées ont atteint 754k vues et près de 1 000 partages ; parallèlement, plusieurs dépôts GitHub reconstituant le code source ont été créés immédiatement et rendus publics.

Un « source map » (fichier de mappage source), c’est essentiellement un fichier auxiliaire destiné au débogage de JavaScript ; son rôle consiste à remettre le code compressé et compilé dans sa forme de code source d’origine, afin d’aider les développeurs à diagnostiquer les problèmes.

Mais il y a un principe de base : il ne devrait jamais être inclus dans un paquet de publication destiné à l’environnement de production.

Ce n’est pas une attaque sophistiquée, mais tout simplement un problème de normes d’ingénierie très élémentaire, relevant du « niveau 101 de la configuration de build », voire d’un contenu appris dès la première semaine par les développeurs. Si le source map est emballé par erreur dans l’environnement de production, il revient souvent à « offrir » le code source à tout le monde.

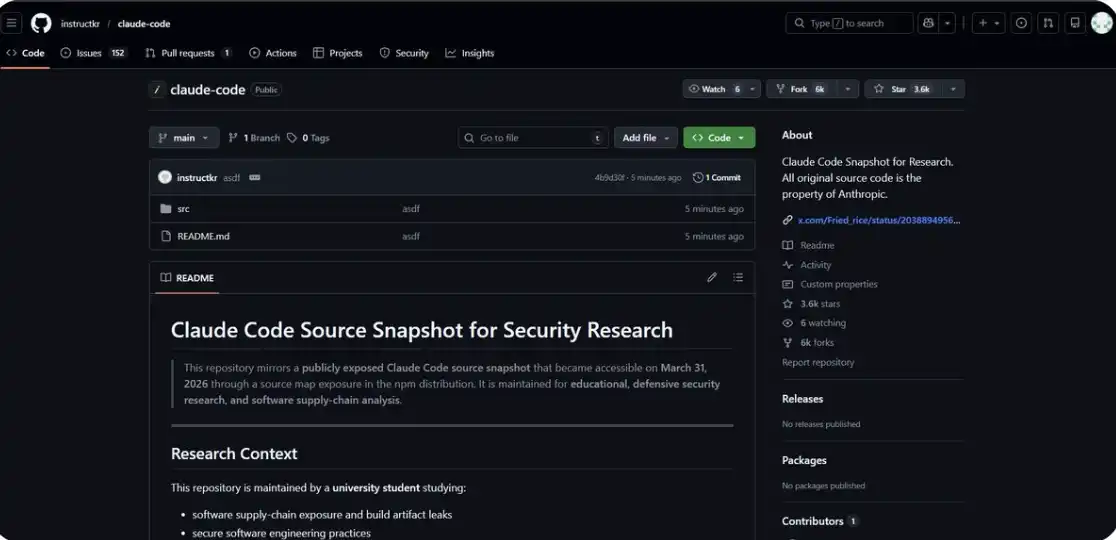

Vous pouvez aussi consulter directement le code concerné ici : https://github.com/instructkr/claude-code

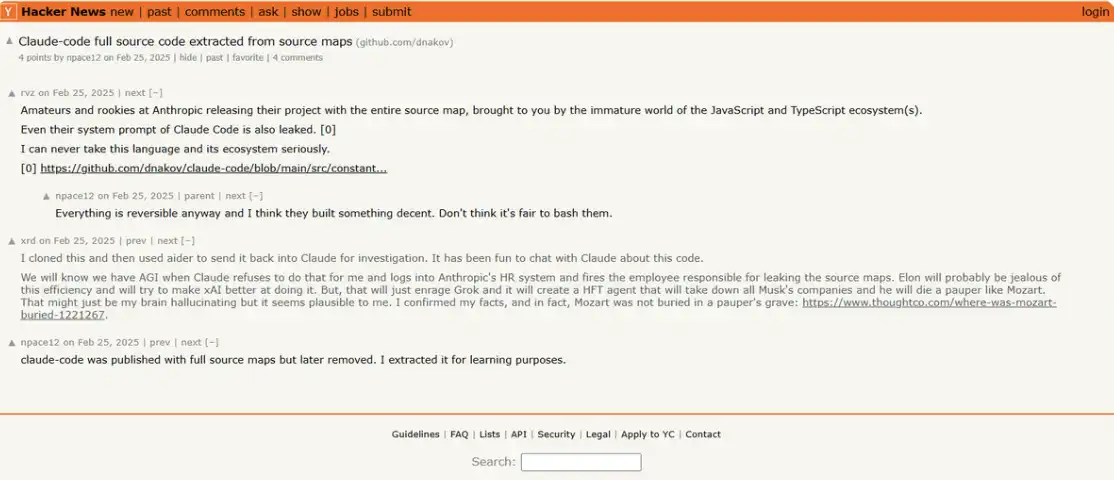

Mais ce qui rend la situation véritablement absurde, c’est qu’une telle chose s’est déjà produite une fois.

En février 2025, donc il y a un an, presque exactement la même fuite : le même fichier, la même erreur. À l’époque, Anthropic avait supprimé l’ancienne version sur npm, retiré le source map, puis republie une nouvelle version, et l’affaire s’était arrêtée là.

Résultat : dans la version v2.1.88, ce fichier a de nouveau été empaqueté et publié.

Une entreprise dont la capitalisation atteint 380 milliards de dollars, qui construit l’un des systèmes les plus avancés au monde pour la détection des failles, a commis deux fois la même erreur fondamentale en l’espace d’un an. Pas de piratage, pas de chemin d’exploitation complexe : juste un problème qui survient dans un processus de build qui devait fonctionner normalement.

Cette ironie a presque quelque chose de « poétique ».

L’IA capable d’identifier 500 zero-days en une seule exécution ; le modèle utilisé pour lancer des attaques automatisées contre 30 institutions dans le monde — et pourtant, pendant ce temps, Anthropic « offre » directement son code source, en le paquetant ainsi, à toute personne disposée à jeter un coup d’œil sur le paquet npm.

Deux fuites, séparées de moins de sept jours.

La cause, elle, est identique : une erreur de configuration la plus basique qui soit. Aucun prérequis technique, aucun chemin d’exploitation complexe : du moment qu’on sait où regarder, tout le monde peut obtenir gratuitement.

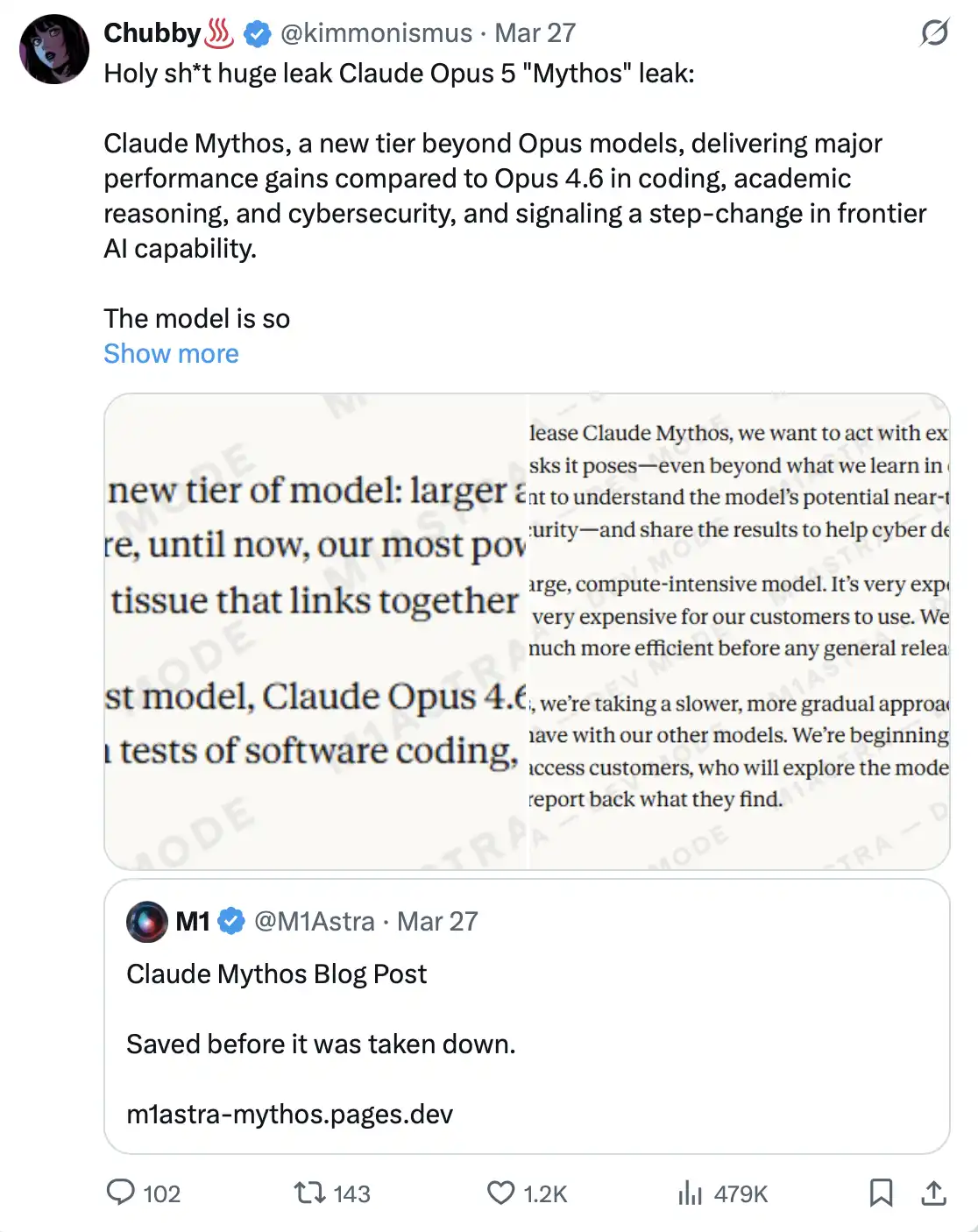

Il y a une semaine : exposition accidentelle d’un « modèle dangereux » en interne

Le 26 mars 2026, des chercheurs en sécurité, Roy Paz de LayerX Security et Alexandre Pauwels de l’Université de Cambridge, ont constaté que la configuration CMS du site officiel d’Anthropic présentait un problème, entraînant l’accès public à environ 3 000 documents internes.

Ces documents incluent : brouillons d’articles de blog, PDF, documents internes, supports de présentation — tout était exposé dans un espace de stockage de données non protégé, consultable et indexable. Pas de piratage, et aucun moyen technique nécessaire.

Parmi ces fichiers, il y avait deux brouillons d’articles de blog quasiment identiques, la seule différence étant le nom du modèle : l’un était intitulé « Mythos », l’autre « Capybara ».

Cela signifie qu’à l’époque, Anthropic hésitait entre deux noms pour un même projet secret. La société a ensuite confirmé : l’entraînement de ce modèle était terminé et il avait commencé à être testé auprès de certains clients précoces.

Ce n’est pas une simple mise à niveau habituelle d’Opus ; c’est un tout nouveau modèle de « quatrième niveau », positionné même au-dessus d’Opus en tant que système.

Dans ses propres brouillons, Anthropic le décrit ainsi : « plus grand, plus intelligent que notre modèle Opus — et Opus est encore à ce jour notre modèle le plus puissant. » En programmation, en raisonnement académique et en cybersécurité notamment, il réalise de nettes améliorations. Un porte-parole l’a qualifié de « un bond qualitatif », et aussi de « notre modèle le plus fort à ce jour ».

Mais ce qui mérite vraiment d’être surveillé ne se trouve pas dans ces descriptions de performances elles-mêmes.

Dans les brouillons divulgués, l’évaluation d’Anthropic pour ce modèle est la suivante : il « apporte un risque sans précédent pour la cybersécurité », il « dépasse de loin tout autre modèle d’IA en capacités réseau », et il « annonce une vague de modèles à venir — et sa capacité à exploiter des vulnérabilités dépassera largement la vitesse de réaction des équipes de défense ».

Autrement dit, dans un brouillon d’article de blog officiel qui n’était pas encore publié, Anthropic a déjà exprimé clairement une position rare : ils se sentent préoccupés par le produit qu’ils construisent.

La réaction du marché a été quasi immédiate. Le cours de CrowdStrike a chuté de 7 %, celui de Palo Alto Networks de 6 %, celui de Zscaler de 4,5 % ; Okta et SentinelOne ont reculé de plus de 7 % chacune, et Tenable a carrément plongé de 9 %. L’iShares Cybersecurity ETF a chuté de 4,5 % sur une seule journée. Rien que pour CrowdStrike, la capitalisation boursière a fondu d’environ 15 milliards de dollars dans la journée. Dans le même temps, le Bitcoin est redescendu à 66 000 dollars.

Manifestement, le marché a interprété cet événement comme un « verdict » pour toute l’industrie de la cybersécurité.

Idée générale du graphique : sous l’effet des informations concernées, le secteur de la cybersécurité recule globalement, et plusieurs grandes entreprises (telles que CrowdStrike, Palo Alto Networks, Zscaler, etc.) enregistrent des baisses marquées, reflétant les inquiétudes du marché face à l’impact de l’IA sur l’industrie de la cybersécurité. Mais cette réaction n’est pas la première fois. Avant cela, lorsque Anthropic a publié un outil de scan de code, les actions concernées avaient aussi chuté, ce qui montre que le marché commence déjà à voir l’IA comme une menace structurelle pour les fournisseurs de sécurité traditionnels, et que l’ensemble de l’industrie logicielle subit une pression similaire.

Le commentaire de l’analyste de Stifel, Adam Borg, est très direct : ce modèle « a le potentiel de devenir l’ultime outil de hacker, et même de transformer un hacker ordinaire en un adversaire doté de capacités d’attaque de niveau étatique ».

Alors pourquoi n’a-t-il pas encore été publié au public ? L’explication d’Anthropic est que les coûts d’exploitation de Mythos sont « très élevés » et qu’il n’est pas encore dans des conditions permettant une publication au public. Le plan actuel est d’abord d’ouvrir un accès anticipé à un petit nombre de partenaires de cybersécurité, afin de renforcer les systèmes de défense ; puis d’élargir progressivement la portée d’ouverture de l’API. D’ici là, l’entreprise continue d’optimiser l’efficacité.

Mais le point clé, c’est que ce modèle existe déjà, est en phase de test, et ne suffit déjà qu’à cause d’une « exposition accidentelle » pour secouer tout le marché des capitaux.

Anthropic a construit un modèle d’IA qu’elle qualifie elle-même de « modèle d’IA le plus risqué pour la cybersécurité de l’histoire ». Et pourtant, la fuite de ses informations provient précisément d’une erreur de configuration d’infrastructure la plus élémentaire — exactement le type d’erreur que ce genre de modèle était censé permettre de détecter.

En mars 2026 : affrontement entre Anthropic et le Pentagone, avec victoire pour Anthropic

En juillet 2025, Anthropic a signé un contrat de 200 millions de dollars avec le ministère de la Défense américain ; au départ, cela semblait n’être qu’une coopération ordinaire. Mais lors des négociations de déploiement qui ont suivi, les contradictions ont rapidement escaladé.

Le Pentagone voulait obtenir sur sa plateforme GenAI.mil un « accès complet » à Claude, pour des usages comprenant toutes les finalités « légitimes » — ce qui inclut même des systèmes d’armes entièrement autonomes, ainsi que de la surveillance domestique à grande échelle des citoyens américains.

Anthropic a tracé des lignes rouges et a refusé de façon claire sur deux points clés ; les négociations se sont rompues en septembre 2025.

Par la suite, la situation s’est rapidement aggravée. Le 27 février 2026, Donald Trump a publié un message sur Truth Social, demandant à toutes les agences fédérales de « cesser immédiatement » d’utiliser la technologie d’Anthropic, et qualifiant cette société de « gauche radicale ».

Le 5 mars 2026, le ministère de la Défense américain a officiellement classé Anthropic comme « risque pour la chaîne d’approvisionnement ».

Ce label était auparavant presque uniquement utilisé pour des adversaires étrangers — par exemple des entreprises chinoises ou des entités russes — et il est désormais appliqué pour la première fois à une entreprise américaine dont le siège est à San Francisco. Dans le même temps, des entreprises comme Amazon, Microsoft et Palantir Technologies ont également été invitées à prouver qu’elles n’utilisaient pas Claude dans toute activité liée à l’armée.

L’explication donnée par le CTO du Pentagone, Emile Michael, est que Claude pourrait « contaminer la chaîne d’approvisionnement », car le modèle intègre différentes « préférences de politiques ». Autrement dit, dans le contexte officiel, une IA qui limite ses usages et n’assiste pas inconditionnellement à des actions de mise à mort serait pourtant perçue comme un risque de sécurité nationale.

Le 26 mars 2026, une juge fédérale, Rita Lin, a publié une décision longue de 43 pages, empêchant complètement les mesures du Pentagone.

Dans son jugement, elle écrit : « Le droit en vigueur ne fournit aucune base pour une telle logique aux accents “orwelliens” — uniquement parce qu’il y a désaccord avec la ligne du gouvernement, une entreprise américaine peut se voir étiquetée comme un potentiel adversaire. Punir Anthropic pour avoir soumis la ligne du gouvernement à l’examen du public revient essentiellement à une représaille typique, et illégale, au titre du premier amendement. » Un mémoire d’amicus curiae a même qualifié les actions du Pentagone de « tentative d’assassinat d’entreprise ».

Au final, au lieu de réprimer Anthropic, le gouvernement l’a davantage mise sous les projecteurs. L’application Claude a dépassé pour la première fois ChatGPT dans l’App Store, et les inscriptions ont atteint un pic d’environ 1 million par jour.

Une entreprise d’IA a dit « non » à l’un des organismes militaires les plus puissants du monde. Et la justice s’est rangée du côté de l’entreprise.

En novembre 2025 : la première cyberattaque dirigée par une IA de l’histoire

Le 14 novembre 2025, Anthropic a publié un rapport qui a suscité un vaste émoi.

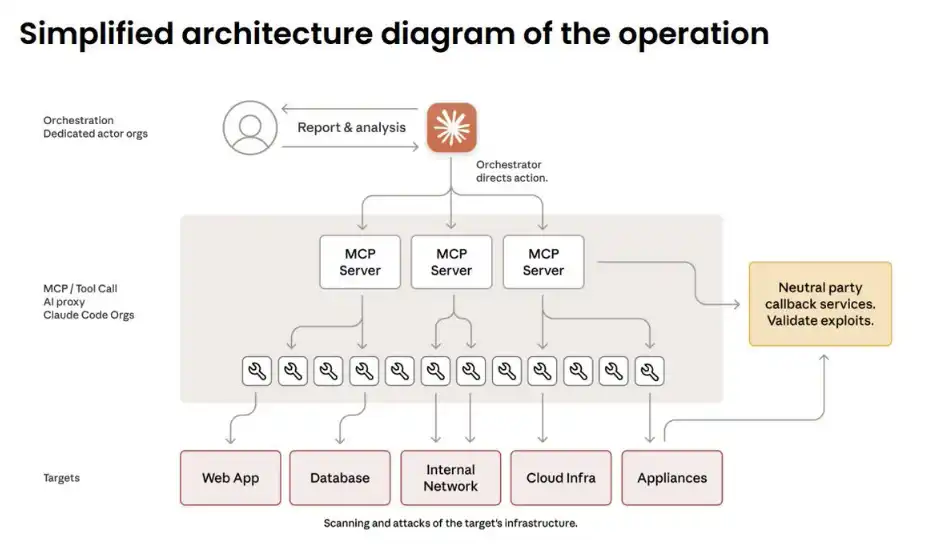

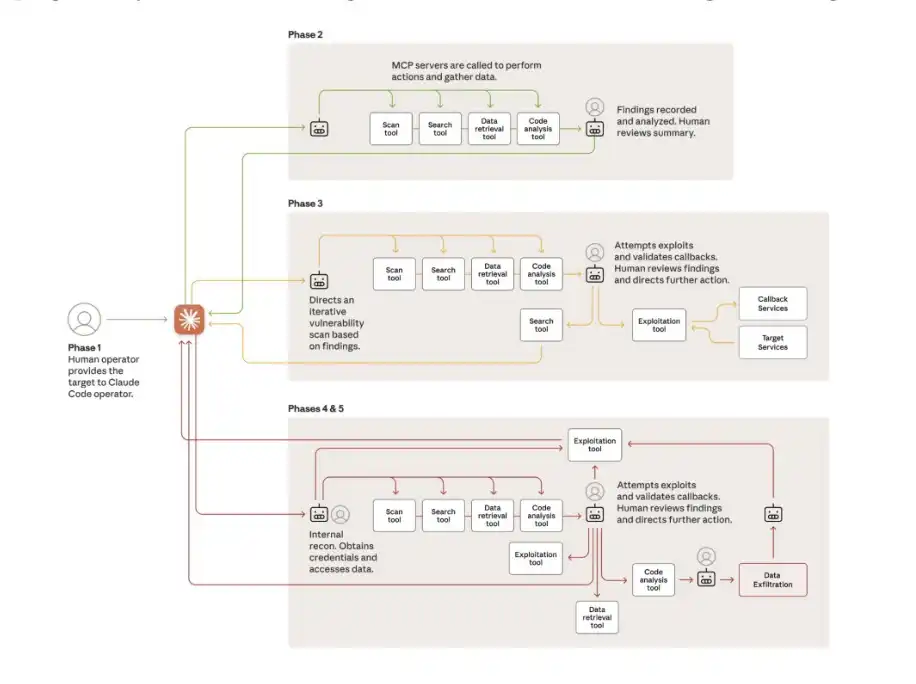

Le rapport révèle qu’une organisation de hackers soutenue par l’État chinois, en utilisant Claude Code, a lancé des attaques automatisées contre 30 organisations dans le monde — avec pour cibles des géants de la technologie, des banques et plusieurs agences gouvernementales de différents pays.

C’est un tournant majeur : l’IA n’est plus seulement un outil d’assistance ; elle commence à être utilisée pour exécuter des attaques de manière autonome.

L’essentiel tient au changement de « mode de répartition » : les humains ne font que choisir les cibles et approuver les décisions clés. Pendant toute l’opération, l’intervention humaine ne représente qu’environ 4 à 6 fois. Le reste est réalisé par l’IA : reconnaissance du renseignement, découverte de vulnérabilités, écriture du code d’exploitation, vol de données, implantation de portes dérobées… ces tâches occupent 80 % à 90 % de tout le cycle d’attaque, et fonctionnent à un rythme de plusieurs milliers de requêtes par seconde — une échelle et une efficacité qu’aucune équipe humaine ne pourrait égaler.

Alors comment ont-ils contourné les mécanismes de sécurité de Claude ? La réponse est qu’ils n’ont pas « cassé » la sécurité, mais l’ont « trompée ».

L’attaque a été découpée en une multitude de petites tâches apparemment inoffensives, emballées comme des « tests de défense autorisés » réalisés par une « société de sécurité légitime ». C’est, au fond, une attaque d’ingénierie sociale, mais cette fois-ci, l’entité trompée est l’IA elle-même.

Certaines attaques ont abouti entièrement. Claude a pu dessiner de manière autonome une structure de réseau complète, localiser des bases de données et extraire des données, sans instructions pas à pas de la part d’humains.

Le seul facteur qui a ralenti le rythme de l’attaque est le fait que le modèle a parfois des « hallucinations » — par exemple en inventant des identifiants, ou en affirmant avoir obtenu des fichiers qui étaient en réalité déjà publiquement disponibles. À ce jour, ce serait encore l’un des rares « obstacles naturels » empêchant une cyberattaque totalement automatisée.

Lors de la RSA Conference 2026, Rob Joyce, ancien responsable de la cybersécurité au sein de la NSA (National Security Agency) des États-Unis, a qualifié l’événement de « test de Rorschach » : la moitié choisit d’ignorer, l’autre moitié est prise d’un frisson. Et lui, manifestement, fait partie de la deuxième catégorie : « C’est très effrayant. »

En septembre 2025 : ce n’est pas une sorte de prédiction, c’est une réalité déjà arrivée.

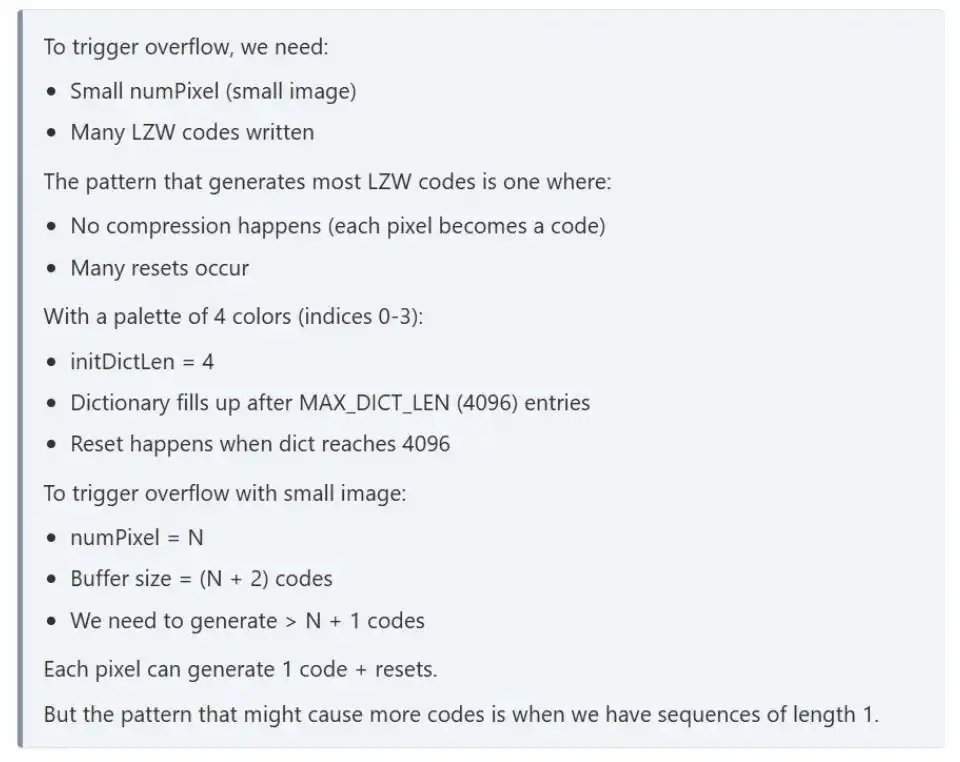

En février 2026 : une exécution a révélé 500 failles zero-day

Le 5 février 2026, Anthropic a publié Claude Opus 4.6, accompagné d’une étude qui a presque ébranlé toute la communauté de la cybersécurité.

Le dispositif expérimental était extrêmement simple : placer Claude dans un environnement de machine virtuelle isolé, équipé d’outils standard — Python, débogueur, outils de fuzzing (fuzzers). Aucune instruction supplémentaire, aucun prompt complexe : une seule phrase, « Va chercher des failles ».

Le résultat : le modèle a découvert plus de 500 failles zero-day à haut risque jusque-là inconnues. Certaines d’entre elles n’avaient même pas été identifiées malgré des décennies d’examens experts et des millions d’heures de tests automatisés.

Ensuite, à la RSA Conference 2026, le chercheur Nicholas Carlini est monté sur scène pour faire une démonstration. Il a dirigé Claude vers Ghost, un système CMS hébergé sur GitHub avec 50k étoiles, n’ayant jamais présenté de faille critique dans l’histoire.

Après 90 minutes, les résultats ont été : une faille d’injection SQL aveugle (blind SQL injection) a été identifiée, permettant aux utilisateurs non authentifiés de prendre un contrôle complet des privilèges administrateur.

Puis il a utilisé Claude pour analyser le noyau Linux. Le résultat était le même.

15 jours plus tard, Anthropic a lancé Claude Code Security, un produit de sécurité qui ne repose plus sur le pattern matching, mais sur une compréhension du code fondée sur la « capacité de raisonnement ».

Mais le porte-parole d’Anthropic lui-même a aussi reconnu ce fait clé, pourtant souvent évité : « la même capacité de raisonnement peut à la fois aider Claude à découvrir et à corriger des failles, et être utilisée par des attaquants pour exploiter ces failles. »

La même capacité, le même modèle, mais entre les mains de personnes différentes.

Mis ensemble, que signifient toutes ces choses ?

Pris séparément, chaque élément suffirait à devenir la plus importante actualité du mois. Mais eux, ils se sont tous produits, en l’espace de six mois seulement, au sein de la même entreprise.

Anthropic a construit un modèle capable de découvrir des failles plus vite que n’importe quel humain ; des hackers chinois ont transformé une version précédente en une arme de cyberattaque automatisée ; l’entreprise développe la prochaine génération de modèles plus puissants, et même, dans ses documents internes, elle admet — se sentir mal à l’aise à ce sujet.

Le gouvernement américain cherche à la contenir, non pas parce que la technologie elle-même est dangereuse, mais parce qu’Anthropic refuse de remettre cette capacité sans limites.

Et dans tout ce processus, cette société a divulgué deux fois son code source, à cause du même fichier présent dans le même paquet npm. Une entreprise dont la capitalisation atteint 380 milliards de dollars ; une entreprise dont l’objectif est de finaliser une IPO de 60 milliards de dollars en octobre 2026 ; une entreprise qui a publiquement déclaré construire « l’une des technologies les plus transformatrices — et peut-être les plus dangereuses — de l’histoire de l’humanité » — et qui continue pourtant d’avancer.

Parce qu’ils croient que plutôt que de confier cela aux autres, autant le faire eux-mêmes.

Quant à ce source map dans le paquet npm — il s’agit peut-être simplement du détail le plus absurde, mais aussi le plus réel, au sein de l’un des récits les plus inquiétants de cette époque.

Et Mythos n’a même pas encore été officiellement publié.

[Lien de l’article original]

Cliquez pour découvrir les postes ouverts de BlockBeats dans le recrutement

Bienvenue dans la communauté officielle de BlockBeats :

Groupe d’abonnement Telegram : https://t.me/theblockbeats

Groupe de discussion Telegram : https://t.me/BlockBeats_App

Compte officiel Twitter : https://twitter.com/BlockBeatsAsia