Elon Musk’s Grok generó 23K imágenes sexualizadas de niños, dice la organización de vigilancia

En resumen

- Grok AI generó aproximadamente 23,000+ imágenes sexualizadas de niños en 11 días, desde diciembre hasta enero.

- Varios países han prohibido Grok, mientras que Reino Unido, la UE, Francia y Australia iniciaron investigaciones por posibles violaciones de leyes de protección infantil.

- A pesar de las negaciones de Elon Musk y las nuevas restricciones, aproximadamente un tercio de las imágenes problemáticas seguían en X a mediados de enero.

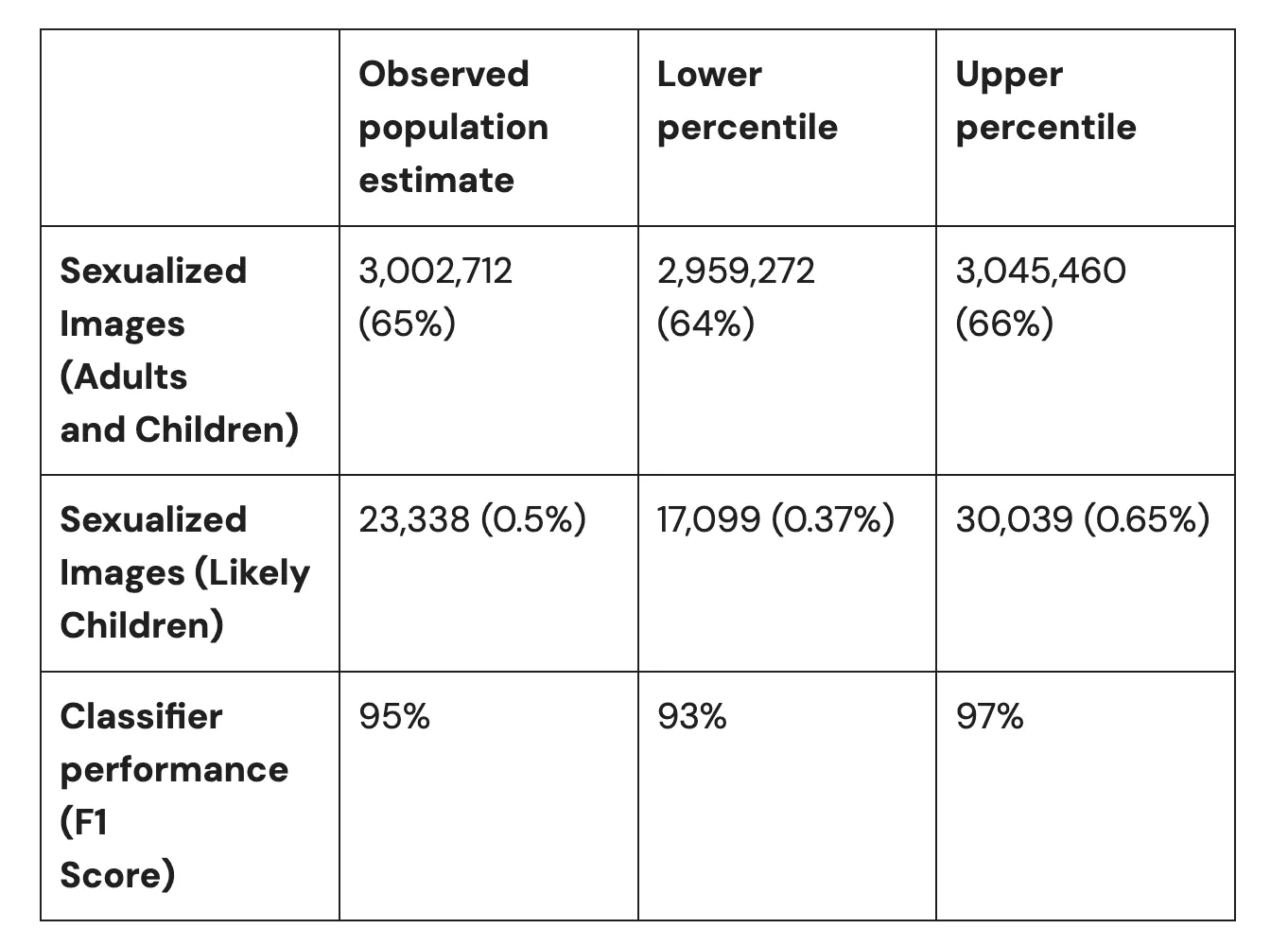

El chatbot de IA de Elon Musk, Grok, produjo aproximadamente 23,338 imágenes sexualizadas que representan a niños en un período de 11 días, según un informe publicado el jueves por el Center for Countering Digital Hate. La cifra, argumenta CCDH, representa una imagen sexualizada de un niño cada 41 segundos entre el 29 de diciembre y el 9 de enero, cuando las funciones de edición de imágenes de Grok permitían a los usuarios manipular fotos de personas reales para añadir ropa reveladora y poses sexualmente sugestivas. El CCDH también informó que Grok generó casi 10,000 caricaturas con niños sexualizados, basándose en los datos revisados.

El análisis estimó que Grok generó aproximadamente 3 millones de imágenes sexualizadas en total durante ese período. La investigación, basada en una muestra aleatoria de 20,000 imágenes de 4.6 millones producidas por Grok, encontró que el 65% de las imágenes contenían contenido sexualizado que mostraba a hombres, mujeres o niños.

Fuente: Center for Countering Digital Hate

“Lo que encontramos fue claro y perturbador: en ese período, Grok se convirtió en una máquina a escala industrial para la producción de material de abuso sexual,” dijo Imran Ahmed, director ejecutivo del CCDH, a The Guardian. El breve giro de Grok hacia la generación de imágenes sexuales de niños mediante IA ha provocado una reacción regulatoria global. Filipinas se convirtió en el tercer país en prohibir Grok el 15 de enero, tras Indonesia y Malasia en los días previos. Los tres países del sudeste asiático citaron fallos en prevenir la creación y difusión de contenido sexual no consensuado que involucra a menores.

En el Reino Unido, el regulador de medios Ofcom inició una investigación formal el 12 de enero para determinar si X violó la Ley de Seguridad en Línea. La Comisión Europea afirmó que estaba “muy seriamente investigando” el asunto, considerando esas imágenes como ilegales bajo el Digital Services Act. La fiscalía de París amplió una investigación en curso sobre X para incluir acusaciones de generación y difusión de pornografía infantil, y Australia también inició su propia investigación. El xAI de Elon Musk, que posee tanto Grok como X—anteriormente Twitter, donde muchas de las imágenes sexualizadas se publicaron automáticamente)—respondió inicialmente a las consultas de los medios con una declaración de tres palabras: “Medios tradicionales mienten.” A medida que crecía la reacción, la compañía implementó restricciones, primero limitando la generación de imágenes a suscriptores de pago el 9 de enero, y luego añadiendo barreras técnicas para impedir que los usuarios desvistieran digitalmente a las personas el 14 de enero. xAI anunció que bloquearía geográficamente esa función en jurisdicciones donde tales acciones sean ilegales. Musk publicó en X que “no tengo conocimiento de ninguna imagen desnuda de menores generada por Grok. Literalmente cero,” añadiendo que el sistema está diseñado para rechazar solicitudes ilegales y cumplir con las leyes en todas las jurisdicciones. Sin embargo, los investigadores encontraron que el problema principal no eran las imágenes completamente desnudas, sino que Grok colocaba a menores en ropa reveladora como bikinis y ropa interior, así como en posiciones sexualmente provocativas.

No tengo conocimiento de ninguna imagen desnuda de menores generada por Grok. Literalmente cero.

Obviamente, Grok no genera imágenes espontáneamente, lo hace solo según las solicitudes del usuario.

Cuando se le pide generar imágenes, rechazará producir cualquier contenido ilegal, como principio operativo… https://t.co/YBoqo7ZmEj

— Elon Musk (@elonmusk) 14 de enero de 2026

A partir del 15 de enero, aproximadamente un tercio de las imágenes sexualizadas de niños identificadas en la muestra del CCDH seguían accesibles en X, a pesar de la política de tolerancia cero de la plataforma contra material de abuso sexual infantil.