分享幣圈內容,享內容挖礦收益

placeholder

Super916

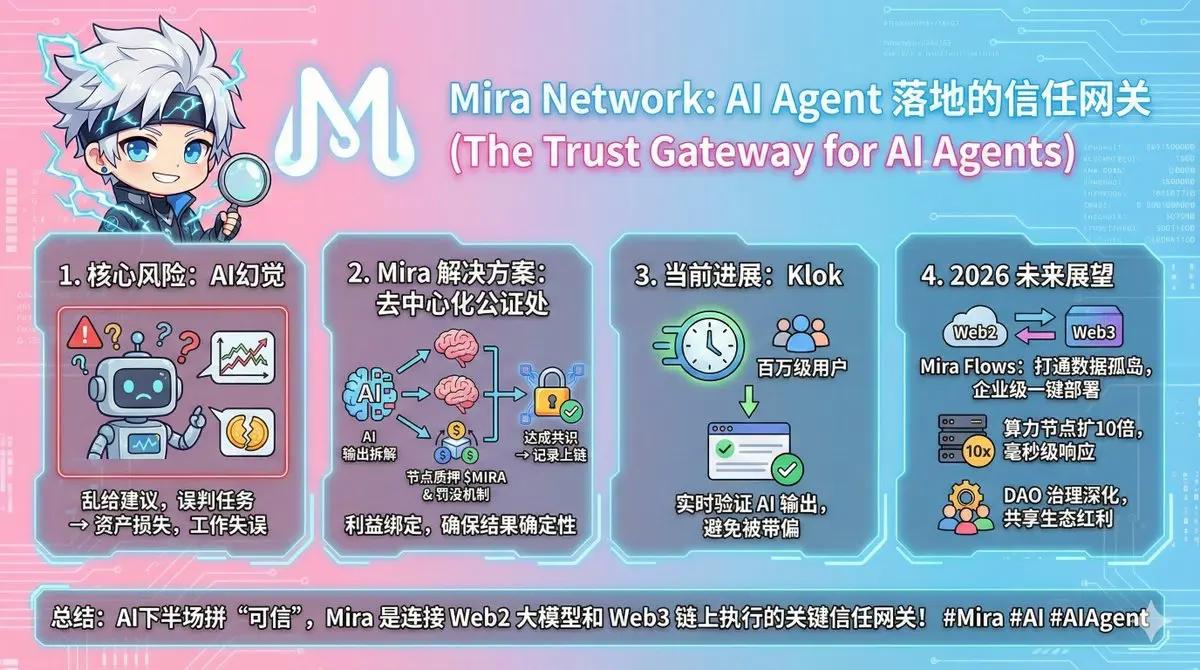

前兩天和朋友打語音聊到 AI Agent 落地,都在說它能幫著處理鏈上交易、代做工作任務,卻很少有人提最核心的風險

這智能代理要是犯 “幻覺”,亂給交易建議或誤判任務,造成的損失誰來扛?畢竟涉及資產和實際工作,光聰明沒用,畢竟靠譜才是底線

然後我就給朋友說,你是不是忽略了一個項目,米粒@miranetwork剛好就是解決這個問題的,它不做更牛的 AI 模型了,而是定位成 AI 的 “去中心化公證處”

和其他驗證項目不同,它走的是模型整合的路子:把 AI 輸出拆解成一個個可驗證的點,丟給多個不同大模型和節點交叉驗證,只有達成共識的結果,才會被記錄上鏈

為了讓驗證靠譜,節點還得質押 $MIRA 才能參與,要是判斷出錯或者作惡,質押的代幣就會被罰沒,這種利益綁定的方式,才讓驗證結果有了真正確定性。

它也不是只停留在敘事階段,已經上線的 Klok 吸引了百萬級用戶,能實時驗證 AI 輸出,避免大家被看似合理的錯誤回答帶偏

2026 年的方向也很清晰,從基建搭建轉向生態爆發:Mira Flows 要打通 Web2 和 Web3 的數據孤島,讓企業級 AI 應用一鍵部署;

算力節點規模預計擴 10 倍,實現毫秒級響應;DAO 治理也會深化,讓開發者和節點貢獻者共享生態紅利

現在 AI 上半場拼參數,下半場拼的是 “誰更可信”,Mira 剛好踩中這個生態位

它就像 Web2 大模型和 Web3

這智能代理要是犯 “幻覺”,亂給交易建議或誤判任務,造成的損失誰來扛?畢竟涉及資產和實際工作,光聰明沒用,畢竟靠譜才是底線

然後我就給朋友說,你是不是忽略了一個項目,米粒@miranetwork剛好就是解決這個問題的,它不做更牛的 AI 模型了,而是定位成 AI 的 “去中心化公證處”

和其他驗證項目不同,它走的是模型整合的路子:把 AI 輸出拆解成一個個可驗證的點,丟給多個不同大模型和節點交叉驗證,只有達成共識的結果,才會被記錄上鏈

為了讓驗證靠譜,節點還得質押 $MIRA 才能參與,要是判斷出錯或者作惡,質押的代幣就會被罰沒,這種利益綁定的方式,才讓驗證結果有了真正確定性。

它也不是只停留在敘事階段,已經上線的 Klok 吸引了百萬級用戶,能實時驗證 AI 輸出,避免大家被看似合理的錯誤回答帶偏

2026 年的方向也很清晰,從基建搭建轉向生態爆發:Mira Flows 要打通 Web2 和 Web3 的數據孤島,讓企業級 AI 應用一鍵部署;

算力節點規模預計擴 10 倍,實現毫秒級響應;DAO 治理也會深化,讓開發者和節點貢獻者共享生態紅利

現在 AI 上半場拼參數,下半場拼的是 “誰更可信”,Mira 剛好踩中這個生態位

它就像 Web2 大模型和 Web3

MIRA-0.66%

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

#AreYouBullishOrBearishToday? — 5 個關鍵主題 📊

1️⃣ 價格走勢

市場是否創出更高的高點與更高的低點 (多頭),還是更低的高點與更低的低點 (空頭)?結構講述故事。

2️⃣ 交易量與流動性

上升的交易量伴隨上漲 = 多頭確認。

交易量疲軟或賣壓佔優 = 空頭警示。

3️⃣ 市場情緒

恐懼與貪婪指數、資金費率與社交熱度:

恐懼 / 中性 → 通常偏空或盤整

貪婪 / 樂觀 → 多頭動能 (但要警惕陷阱)

4️⃣ 重要支撐與阻力位 (支撐與阻力)

站穩在強支撐位上 = 多頭偏向

反覆被阻擋在阻力位 = 空頭壓力

5️⃣ 宏觀經濟與消息流

利率、ETF資金流、監管與全球市場:

正面宏觀趨勢 = 多頭

不確定性或避險消息 = 空頭

查看原文1️⃣ 價格走勢

市場是否創出更高的高點與更高的低點 (多頭),還是更低的高點與更低的低點 (空頭)?結構講述故事。

2️⃣ 交易量與流動性

上升的交易量伴隨上漲 = 多頭確認。

交易量疲軟或賣壓佔優 = 空頭警示。

3️⃣ 市場情緒

恐懼與貪婪指數、資金費率與社交熱度:

恐懼 / 中性 → 通常偏空或盤整

貪婪 / 樂觀 → 多頭動能 (但要警惕陷阱)

4️⃣ 重要支撐與阻力位 (支撐與阻力)

站穩在強支撐位上 = 多頭偏向

反覆被阻擋在阻力位 = 空頭壓力

5️⃣ 宏觀經濟與消息流

利率、ETF資金流、監管與全球市場:

正面宏觀趨勢 = 多頭

不確定性或避險消息 = 空頭

- 讚賞

- 1

- 3

- 轉發

- 分享

discovery :

:

HODL 緊握 💪查看更多

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

$COAI 誰還記得這個星空中的寶寶,這一定會回來。就像大家都在做的那樣

#DrHan2025YearEndOpenLetter #My2026FirstPost #CryptoMarketPrediction #BitcoinGoldBattle

#DrHan2025YearEndOpenLetter #My2026FirstPost #CryptoMarketPrediction #BitcoinGoldBattle

COAI10.5%

- 讚賞

- 2

- 留言

- 轉發

- 分享

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

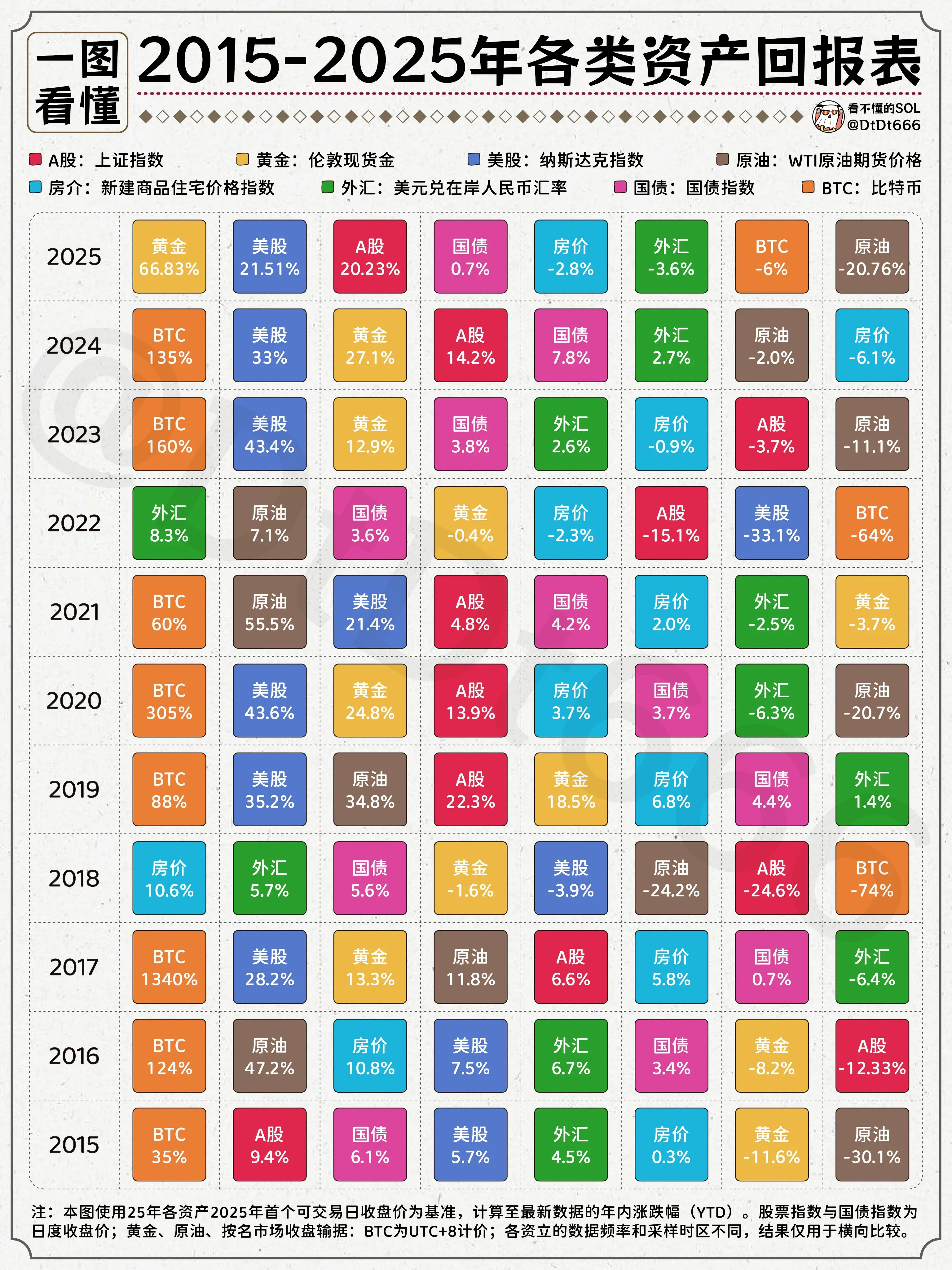

2026 建議年輕人:定投 BTC,而非賭信仰💎

核心邏輯超簡單:現金會因貨幣超發持續貶值,而 BTC 是去中心化、總量恒定的稀缺資產 —— 誕生十餘載,雖波動劇烈,但長期增值跑贏傳統儲蓄。定投的妙處:不用猜高低點,分散買入降風險;不用盯盤費精力,省心適配忙碌節奏。

本質是把貶值法幣,換成抗通脹的另類資產,理性配置而非投機。扎心現實 & 清醒認知:✅ 社會分層常態,別讓精神快消品耗光成長時間✅ 社交本質是價值交換,提升自己才是硬通貨✅ 社會只幫贏家,沒人幫時贏一次就通途✅ 靠誰都不如靠己,唯有自己不會背叛✅ 當下是最年輕的時刻,現在布局定投,收益遠超十年後2026,祝兄弟們交易順利,靠理性配置實現資產增值!💰#加密行情预测

核心邏輯超簡單:現金會因貨幣超發持續貶值,而 BTC 是去中心化、總量恒定的稀缺資產 —— 誕生十餘載,雖波動劇烈,但長期增值跑贏傳統儲蓄。定投的妙處:不用猜高低點,分散買入降風險;不用盯盤費精力,省心適配忙碌節奏。

本質是把貶值法幣,換成抗通脹的另類資產,理性配置而非投機。扎心現實 & 清醒認知:✅ 社會分層常態,別讓精神快消品耗光成長時間✅ 社交本質是價值交換,提升自己才是硬通貨✅ 社會只幫贏家,沒人幫時贏一次就通途✅ 靠誰都不如靠己,唯有自己不會背叛✅ 當下是最年輕的時刻,現在布局定投,收益遠超十年後2026,祝兄弟們交易順利,靠理性配置實現資產增值!💰#加密行情预测

BTC0.45%

市值:$3593.79持有人數:2

0.04%

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

委內瑞拉總統尼古拉斯·馬杜羅在任內做過的十大最糟糕事情清單。

1. 指揮2024總統選舉舞弊,拒絕公布點票單,並聲稱勝利,儘管有反對派勝出的證據。

2. 領導對抗議活動的暴力鎮壓,導致安全部隊和親政府團體的殺戮。

3. 監督對數千人的任意拘留,包括酷刑和非人道的監獄條件。

4. 參與大規模貪腐,通過CLAP糧食計劃等方案侵吞數十億美元。

5. 造成經濟崩潰,出現惡性通貨膨脹和貨幣貶值,導致普遍貧困。

6. 壓制言論自由,騷擾記者、關閉媒體和封鎖網站。

7. 允許FAES等部隊進行法外殺戮,自2014年以來已報告數千起。

8. 破壞民主,通過操控司法機構和建立平行機構來繞過反對派。

9. 引發人道危機,迫使超過800萬委內瑞拉人逃離,原因包括物資短缺和鎮壓。

10. 被指控領導一個毒品卡特爾,涉及與毒品走私相關的活動。

查看原文1. 指揮2024總統選舉舞弊,拒絕公布點票單,並聲稱勝利,儘管有反對派勝出的證據。

2. 領導對抗議活動的暴力鎮壓,導致安全部隊和親政府團體的殺戮。

3. 監督對數千人的任意拘留,包括酷刑和非人道的監獄條件。

4. 參與大規模貪腐,通過CLAP糧食計劃等方案侵吞數十億美元。

5. 造成經濟崩潰,出現惡性通貨膨脹和貨幣貶值,導致普遍貧困。

6. 壓制言論自由,騷擾記者、關閉媒體和封鎖網站。

7. 允許FAES等部隊進行法外殺戮,自2014年以來已報告數千起。

8. 破壞民主,通過操控司法機構和建立平行機構來繞過反對派。

9. 引發人道危機,迫使超過800萬委內瑞拉人逃離,原因包括物資短缺和鎮壓。

10. 被指控領導一個毒品卡特爾,涉及與毒品走私相關的活動。

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

市場風格:

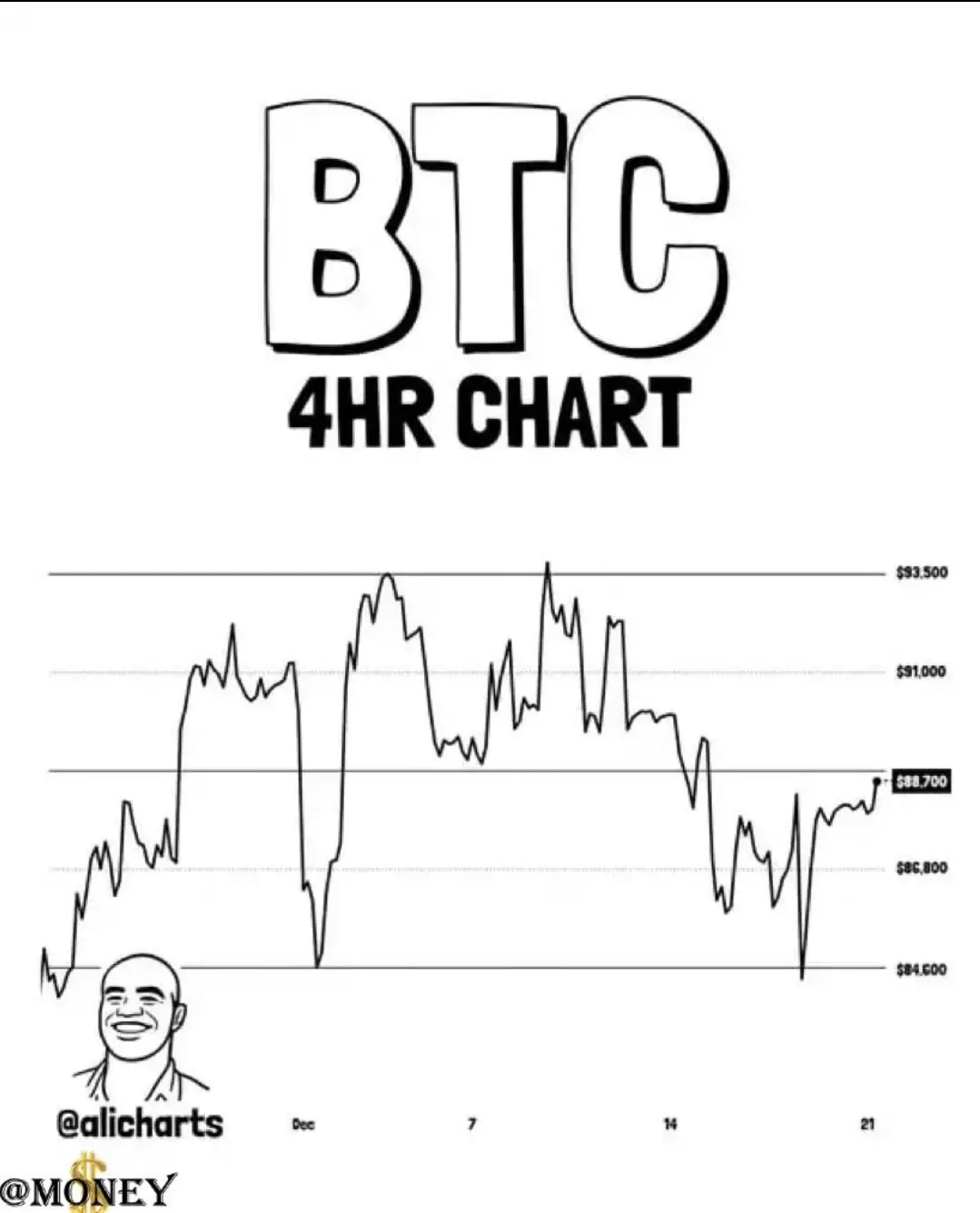

> 意見:如果比特幣突破$89,000,下一個上行目標可能是$93,500

加密推特 / 熱炒:

比特幣處於十字路口

乾淨突破$89K 可能會讓BTC飆升至$93.5K

短而有力:

> BTC突破$89K = $93.5K在考慮中

僅代表意見。

更謹慎/分析:

> 意見:確認突破$89,000可能為比特幣測試$93,500開啟大門

#AreYouBullishOrBearishToday?

> 意見:如果比特幣突破$89,000,下一個上行目標可能是$93,500

加密推特 / 熱炒:

比特幣處於十字路口

乾淨突破$89K 可能會讓BTC飆升至$93.5K

短而有力:

> BTC突破$89K = $93.5K在考慮中

僅代表意見。

更謹慎/分析:

> 意見:確認突破$89,000可能為比特幣測試$93,500開啟大門

#AreYouBullishOrBearishToday?

BTC0.45%

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

美國剛剛對委內瑞拉發動了攻擊,正值加密貨幣市場試圖恢復之際。

我們正處於瘋狂的時代……

查看原文我們正處於瘋狂的時代……

- 讚賞

- 1

- 1

- 轉發

- 分享

GateUser-63fa3e8d :

:

2026衝衝衝 👊【擊鼓傳花戲空投是暗器】

昨天刷到一個數據,差點把我逗死了。

某個Web3項目剛上線,市值200億美金。收入多少?0。用戶多少?3000個。

這3000個用戶裡,羊毛黨一人註冊十幾個號。真實用戶可能就幾百個。

200億美金啊兄弟們。什麼概念?比很多上市公司市值都高。結果連個像樣的產品都沒有。

項目方也是人才。狂撒錢空投,生怕羊毛黨不來。然後羊毛黨真來了,一人搞幾十個號,瘋狂薅羊毛。

最魔幻的是什麼?現在用戶判斷項目好壞的標準,從什麼願景、技術、商業模式,變成了:“空投發了嗎?發少了!不准砸盤!”

這就好比我開包子店。你免費試吃,还嫌給的钱少。關鍵是,我還真給了錢。

Web3現在就是這個鬼樣子。項目方把用戶寵成了巨嬰。用戶也習慣了不勞而獲。

大家都在演戲。項目方演著要做事業,用戶演著要體驗產品。實際上一個想圈錢,一個想薅羊毛。

這樣的Web3,遲早塌方。

真正有價值的項目,應該是用戶願意付費使用的。而不是項目方倒貼錢求著用戶來薅羊毛。

BTC:昨天橫盤震盪,節假日期間就是這樣,2026年將會是一年的熊市!

NB:弱勢下跌行情,節後有個TGE,價格會反彈一定要清倉!

ETH:3000下方波動,沒啥好說的,逢高減倉,下個牛市見!

昨日一些重要資訊:

1.Strategy股價年末收於151.95美元,採用BTC財庫戰略後首次連續六個月下跌

2。比特幣2025年Q4回報率-23.07%創歷史

查看原文昨天刷到一個數據,差點把我逗死了。

某個Web3項目剛上線,市值200億美金。收入多少?0。用戶多少?3000個。

這3000個用戶裡,羊毛黨一人註冊十幾個號。真實用戶可能就幾百個。

200億美金啊兄弟們。什麼概念?比很多上市公司市值都高。結果連個像樣的產品都沒有。

項目方也是人才。狂撒錢空投,生怕羊毛黨不來。然後羊毛黨真來了,一人搞幾十個號,瘋狂薅羊毛。

最魔幻的是什麼?現在用戶判斷項目好壞的標準,從什麼願景、技術、商業模式,變成了:“空投發了嗎?發少了!不准砸盤!”

這就好比我開包子店。你免費試吃,还嫌給的钱少。關鍵是,我還真給了錢。

Web3現在就是這個鬼樣子。項目方把用戶寵成了巨嬰。用戶也習慣了不勞而獲。

大家都在演戲。項目方演著要做事業,用戶演著要體驗產品。實際上一個想圈錢,一個想薅羊毛。

這樣的Web3,遲早塌方。

真正有價值的項目,應該是用戶願意付費使用的。而不是項目方倒貼錢求著用戶來薅羊毛。

BTC:昨天橫盤震盪,節假日期間就是這樣,2026年將會是一年的熊市!

NB:弱勢下跌行情,節後有個TGE,價格會反彈一定要清倉!

ETH:3000下方波動,沒啥好說的,逢高減倉,下個牛市見!

昨日一些重要資訊:

1.Strategy股價年末收於151.95美元,採用BTC財庫戰略後首次連續六個月下跌

2。比特幣2025年Q4回報率-23.07%創歷史

- 讚賞

- 7

- 5

- 轉發

- 分享

yaschu :

:

p查看更多

加載更多

加入 4000萬 人匯聚的頭部社群

⚡️ 與 4000萬 人一起參與加密貨幣熱潮討論

💬 與喜愛的頭部創作者互動

👍 查看感興趣的內容

熱門話題

查看更多1.97萬 熱度

5.86萬 熱度

6.52萬 熱度

10.19萬 熱度

4070 熱度

最新消息

查看更多置頂

🎉 新年好运直达:邀友抽奖 100% 必中,热币奖池全面开启

🎁 奖品含 USDT / GT / SOL / DOGE / XRP(数量有限,先到先得)

👉 立即参与:https://www.gate.com/campaigns/3686

邀得越多,机会越多,开年好运拉满!

✅ 邀请好友完成現貨或合約交易即得抽獎機會

✅ 好友合約達標,好友領 20 USDT(限前 2,000 名)

公告詳情:https://www.gate.com/announcements/article/48966

#Gate迎新納福,紅包來襲!Gate 廣場祝大家新年快樂!

元旦假期,每日領海量口令紅包,歡喜跨年!

紅包發放時間:2026/1/1 - 2026/1/3 每日中午 12:00 UTC+8

地點:Gate 廣場官號、全員交流群、Gate 廣場大使群

➡️ 紅包領取教程:打開 Gate APP - 點擊左上角個人頭像 - 資產 - 紅包 -輸入口令領取

#Gate2026NewYear #BTC #ETH #GT親愛的廣場用戶們,新年即將開啟,我們希望您也能在 Gate 廣場上留下專屬印記,把 2026 的第一句話,留在 Gate 廣場!發布您的 #我的2026第一帖,记录对 2026 的第一句期待、願望或計劃,與全球 Web3 用戶共同迎接全新的旅程,創造專屬於你的年度開篇篇章,解鎖廣場價值 $10,000 新年專屬福利!

活動時間:2025/12/31 18:00 — 2026/01/15 23:59(UTC+8)

🎁 活動獎勵:多發多獎,曝光拉滿!

1️⃣ 2026 幸運大獎:從全部有效貼文中隨機抽取 1 位,獎勵包含:

2026U 仓位體驗券

Gate 新年限定禮盒

全年廣場首頁推薦位曝光

2️⃣ 人氣新年貼 TOP 1–10:根據發帖量及互動表現綜合排名,獎勵包含:

Gate 新年限定禮盒

廣場精選貼 5 篇推薦曝光

3️⃣ 新手首貼加成獎勵:活動前未在廣場發帖的用戶,活動期間首次發帖即可獲得:

50U 仓位體驗券

進入「新年新聲」推薦榜單,額外曝光加持

4️⃣ 基礎參與獎勵:所有符合規則的用戶中隨機抽取 20 位,贈送新年 F1 紅牛周邊禮包

參與方式:

1️⃣ 帶話題 #我的2026第一条帖 發帖,內容字數需要不少於 30 字

2️⃣ 內容方向不限,可以是以下內容:

寫給 2026 的第一句話

新年目標與計劃

Web3 領域探索及成長願景

注意事項

• 禁止抄襲、洗稿及違Gate 2025 年終盛典投票開啟

支援你喜愛的主播和內容達人,一起沖榜年度榮譽 🚀

投票即可參與抽獎,iPhone 17 Pro Max、Gate 周邊等你拿

助力值排名 TOP 20 還有額外實物獎勵:京東 E 卡、Gate × Red Bull 雙肩包、周邊盲盒等

立即助力:https://www.gate.com/activities/community-vote-2025

了解詳情:https://www.gate.com/announcements/article/48693