GPT-5.4 Mini online! Velocidade de execução duplicada, modelo compacto mais prático

OpenAI em 18 de março lançou o GPT-5.4 Mini e o GPT-5.4 Nano, duas versões leves projetadas para cargas de trabalho de IA de alta capacidade, que iteraram novamente menos de duas semanas após o lançamento da versão flagship GPT-5.4. O GPT-5.4 Mini é duas vezes mais rápido que o anterior GPT-5 Mini, enquanto o GPT-5.4 Nano foi otimizado para cenários de diálogo em tempo real com custos mais baixos.

Lógica central dos modelos pequenos: precisão nem sempre é o maior obstáculo

OpenAI posiciona o GPT-5.4 Mini e Nano como “os modelos menores mais poderosos até agora”, mas isso não significa que sejam versões reduzidas do flagship. São baseados em escolhas de design com prioridades diferentes: quando o gargalo real da tarefa é velocidade e custo, e não profundidade de raciocínio, modelos menores costumam ser mais práticos.

Tomemos como exemplo um sistema de atendimento ao cliente: responder a 200 perguntas fixas por dia, com raciocínio de nível doutor, oferece ganhos marginais quase nulos. O que realmente importa para escalar o sistema é uma resposta em menos de um segundo e um custo de frações de centavo por resposta.

Atualmente, uma estrutura de fluxo de trabalho eficiente é: usar o modelo flagship (como GPT-5.4) para planejamento e coordenação de tarefas, enquanto Mini ou Nano processam em paralelo muitas tarefas repetitivas — como busca em repositórios de código, leitura de documentos ou processamento de formulários. Jerry Ma, vice-chefe de tecnologia da Perplexity, afirmou após testes: “O modelo Mini tem forte capacidade de raciocínio, enquanto o Nano responde rapidamente e de forma eficiente, ideal para fluxos de diálogo em tempo real.”

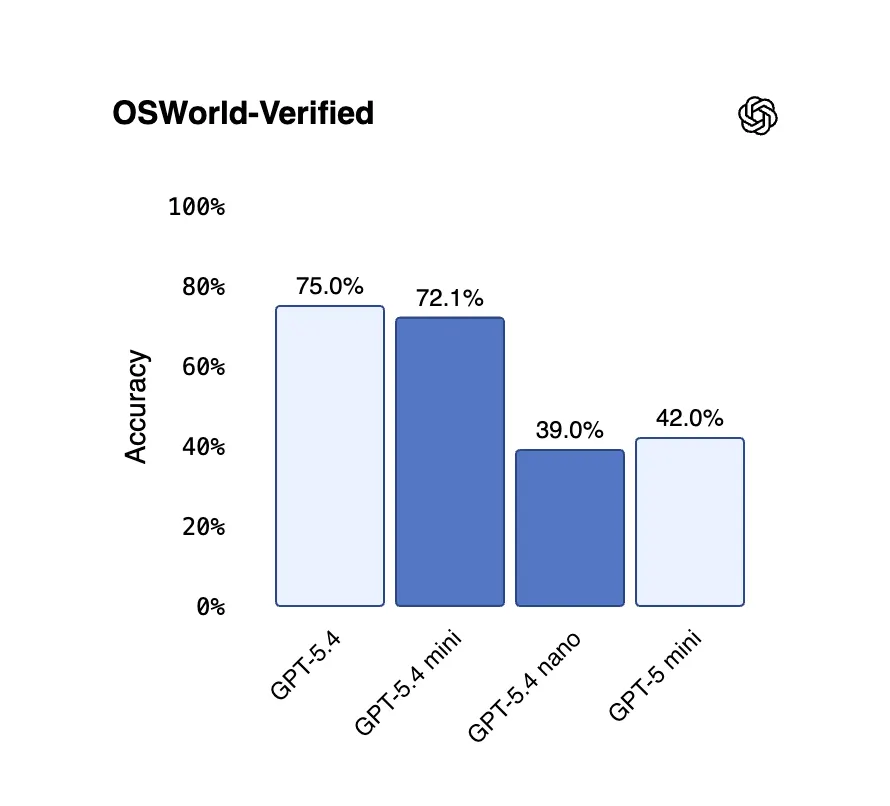

Dados de benchmark: Mini já supera padrões humanos de operação de computador

(Fonte: OpenAI)

(Fonte: OpenAI)

Segundo dados públicos de benchmark, o desempenho do GPT-5.4 Mini está bastante próximo do flagship:

SWE-Bench Pro (avalia a capacidade de resolver problemas reais de código no GitHub): GPT-5.4 Mini pontua 54,4%; a versão anterior GPT-5 Mini, 45,7%; GPT-5.4 flagship, 57,7%.

OSWorld-Verified (avalia a capacidade de operar na interface de desktop via captura de tela): Mini pontua 72,1%; GPT-5.4 flagship, 75,0%; a linha de base humana, 72,4% — Mini já supera o padrão humano.

GPT-5.4 Nano: SWE-Bench Pro 52,4%, OSWorld-Verified 39,0%, abaixo do Mini, mas ainda uma grande evolução em relação às versões Nano anteriores.

Esses dados mostram que, em cenários que envolvem operação de desktop ou manipulação de código, Mini quase iguala o desempenho do flagship; Nano, embora menos preciso, mantém vantagens de custo-benefício em cenários que exigem resposta rápida.

Estrutura de preços e acessibilidade: diferentes entradas para desenvolvedores e usuários comuns

Preços da API: GPT-5.4 Mini custa $0,75 por milhão de tokens de entrada e $4,50 por milhão de tokens de saída; GPT-5.4 Nano, $0,20 por milhão de tokens de entrada e $1,25 por milhão de tokens de saída — o preço de entrada do Nano é cerca de um quarto do Mini.

Acessibilidade ao usuário: GPT-5.4 Mini já está disponível para usuários do ChatGPT Free e do plano Go, acessível via opção “+” no menu “Pensar”. Quando o limite de uso do GPT-5.4 for atingido, o sistema automaticamente troca para Mini. O GPT-5.4 Nano atualmente só está disponível via API, voltado para desenvolvedores, não sendo acessível diretamente ao consumidor.

Perguntas frequentes

Qual é a principal diferença entre GPT-5.4 Mini e GPT-5.4 flagship?

GPT-5.4 Mini é mais de duas vezes mais rápido que o GPT-5 Mini anterior, atingindo 72,1% na avaliação OSWorld-Verified, superando a linha de base humana de 72,4%, ficando apenas um pouco abaixo do flagship com 75,0%. A principal diferença está na profundidade de raciocínio e na capacidade de lidar com tarefas complexas, enquanto a velocidade e o custo do Mini o tornam mais prático para tarefas repetitivas em grande escala.

Qual é o melhor cenário de uso para GPT-5.4 Nano?

GPT-5.4 Nano é voltado para desenvolvedores via API, ideal para fluxos de diálogo leves que exigem respostas em tempo real, como sistemas de atendimento ao cliente ou consultas automatizadas diárias em grande escala. Com preço de entrada de apenas $0,20 por milhão de tokens, é economicamente viável para startups em larga escala.

Como usar o GPT-5.4 Mini no ChatGPT?

GPT-5.4 Mini já está disponível para usuários do ChatGPT Free e Go, acessível na interface do ChatGPT pelo menu “+” na opção “Pensar”. Usuários pagos, ao atingirem o limite de uso do GPT-5.4, terão automaticamente a troca para a versão Mini.