Inferência de IA empresarial e implementação de agentes: implementação multi-modelo, híbrida e estrutura de governança segura

Após a rápida evolução das capacidades dos modelos de grande dimensão, as empresas passaram a preocupar-se menos com “se um modelo está disponível” e mais com “se pode funcionar de forma fiável e sustentável em ambientes empresariais reais”. Embora os clusters de treino agreguem poder de hash, os sistemas de produção precisam de gerir pedidos contínuos, latência de cauda, iteração de versões, permissões de dados e responsabilidade por incidentes. Em resumo, o principal campo de batalha da IA empresarial está a mover-se para as estruturas de inferência e operação. Os agentes ampliam os desafios, passando de “Q&A de uma só volta” para “tarefas multi-etapas, invocação de ferramentas e gestão de estado”, elevando consideravelmente os requisitos para infraestrutura e governança.

Ao encarar a infraestrutura de IA como uma cadeia contínua desde chips a centros de dados, serviços e governança, este artigo foca-se no ponto final dessa cadeia: serviços de inferência, acesso a dados e governança organizacional. Temas a montante, como HBM, energia e centros de dados, são mais adequados a discussões do lado da oferta; este artigo pressupõe que os leitores já têm uma base sobre arquiteturas em camadas.

Porque “inferência de produção” e “poder de hash de treino” são desafios distintos

Apesar de treino e inferência partilharem hardware como GPU, redes e armazenamento, os seus objetivos de otimização são diferentes. O treino valoriza o throughput e o paralelismo de longa duração; a inferência privilegia a concorrência, a latência de cauda, o custo por pedido e o ritmo de lançamentos e reversões de versões. Para as empresas, estas diferenças afetam diretamente as decisões arquitetónicas e os limites de aquisição:

- Estrutura de custos: O treino é normalmente um investimento de capital faseado, enquanto os custos de inferência escalam linearmente com o volume de negócios e são mais sensíveis a cache, batching, routing e seleção de modelos.

- Definição de disponibilidade: As tarefas de treino podem ser enfileiradas e repetidas; a inferência online está geralmente sujeita a SLA, exigindo limitação de taxa, degradação e estratégias de múltiplas réplicas.

- Frequência de mudança: Atualizações de modelo, prompt, política de ferramentas e base de conhecimento ocorrem com maior frequência, exigindo processos de libertação auditáveis em vez de implementações únicas.

- Limites de dados: Os dados de treino estão geralmente em ambientes controlados, enquanto a inferência acede frequentemente a dados de clientes, documentos internos e interfaces de sistemas empresariais, exigindo permissões mais rigorosas e mascaramento de dados.

Por isso, ao avaliar a infraestrutura de IA empresarial, é mais eficaz focar nas capacidades da camada de serviço—como gateways, routing, observabilidade, libertação, permissões e auditoria—do que simplesmente comparar a escala dos clusters de treino.

Stack de inferência de produção: da entrada à observabilidade

Um stack de inferência robusto inclui pelo menos os seguintes módulos. Embora os fornecedores possam usar nomes de produto diferentes, as funções principais mantêm-se consistentes.

API Gateway e governança de tráfego

Um ponto de entrada unificado para autenticação, quotas, limitação de taxa e terminação TLS; ao expor capacidades de modelos externamente, o gateway é a primeira linha de defesa para segurança e estratégia empresarial.

Routing de modelos e gestão de versões

As empresas operam frequentemente múltiplos modelos em simultâneo (para tarefas, custos e níveis de conformidade distintos). O routing deve suportar desvios por inquilino, cenário e nível de risco, bem como libertações cinzentas e reversões, para evitar falhas causadas por substituições “tudo de uma vez”.

Serialização, batching e cache

Sob alta concorrência, a serialização/deserialização, estratégias de batching e design de cache KV ou semântico influenciam significativamente a latência de cauda e o custo. O cache introduz também riscos de consistência, exigindo políticas claras de invalidação e dados sensíveis.

Recuperação vetorial e integração RAG (se aplicável)

A geração aumentada por recuperação liga fortemente a inferência aos sistemas de dados: atualizações de índice, filtragem de permissões, exibição de fragmentos de referência e controlo de risco de alucinação são parte integrante da estrutura operacional, não “ad-ons” fora do modelo.

Observabilidade, logging e contabilização de custos

No mínimo, a utilização de tokens, percentis de latência e tipos de erro devem ser discriminados por inquilino, versão de modelo e política de routing. Sem isto, o planeamento de capacidade é difícil e as análises pós-incidente não permitem identificar com precisão se o problema teve origem no modelo, dados ou gateway.

Estes módulos determinam se as experiências online são estáveis, os custos controláveis e os problemas rastreáveis. A falta de qualquer componente resulta frequentemente em sistemas que funcionam bem em demos de baixa carga, mas revelam defeitos sob cargas máximas ou mudanças.

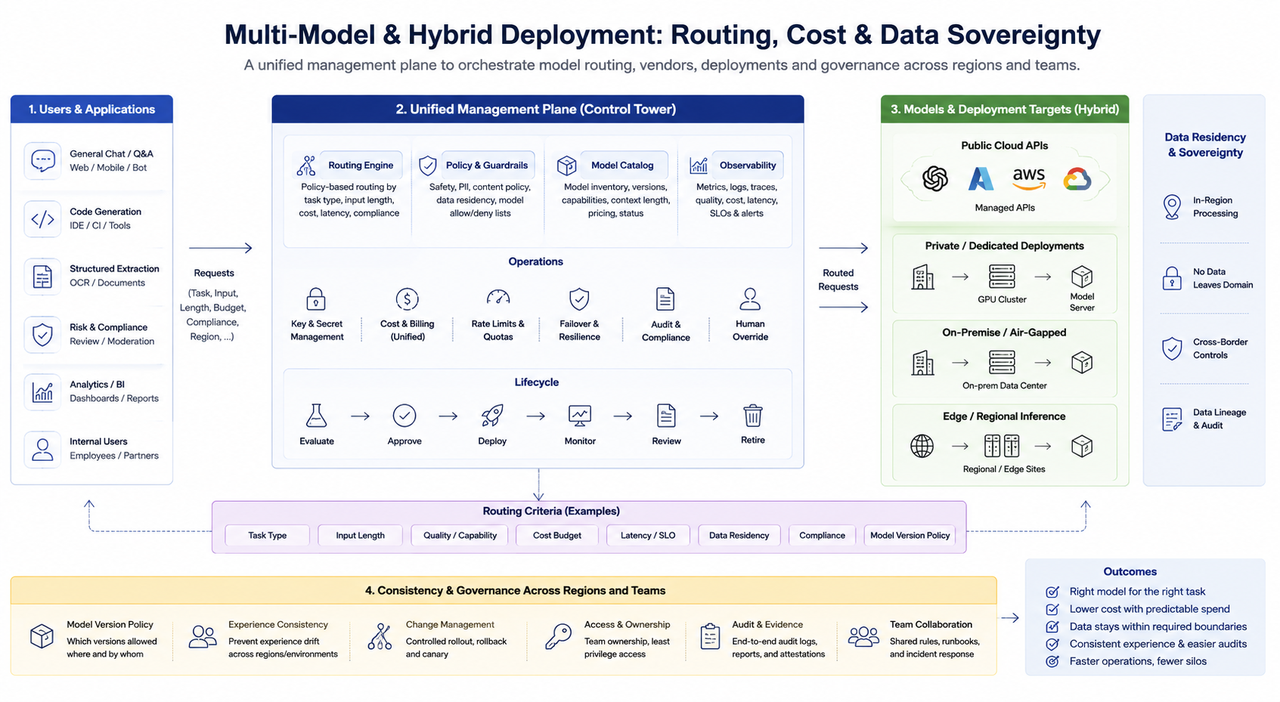

Multi-modelo e implantação híbrida: routing, custo e soberania de dados

Em ambientes empresariais, é comum coexistirem vários modelos: tarefas como conversação geral, código, extração estruturada e revisão de controlo de risco não são adequadas a um único modelo ou estratégia de parâmetros. Os principais desafios de engenharia dos setups multi-modelo incluem:

- Estratégia de routing: Selecionar modelos com base no tipo de tarefa, comprimento do input, restrições de custo e requisitos de conformidade; requer estratégias predefinidas interpretáveis e substituições operacionais manuais.

- Mistura de fornecedores: API de cloud pública, implementações locais e clusters dedicados podem coexistir; gestão unificada de chaves, normas de faturação e failover são essenciais para evitar que “vários fornecedores se tornem silos isolados”.

- Cloud híbrida e residência de dados: Operações financeiras, governamentais e transfronteiriças exigem frequentemente que os dados permaneçam dentro de um domínio ou jurisdição; a implantação de inferência molda a arquitetura de rede e a colocação de cache, interagindo com infraestruturas de terceira camada como centros de dados, energia e redes regionais.

- Governança de consistência: São necessárias políticas claras para determinar se o mesmo negócio em diferentes regiões ou ambientes pode utilizar versões de modelos diferentes; caso contrário, ocorrerá divergência de experiência e desafios de auditoria.

Do ponto de vista organizacional, a dificuldade dos sistemas multi-modelo reside frequentemente não no “número de modelos”, mas na ausência de um plano de gestão unificado. Quando regras de routing, chaves, monitorização e processos de libertação estão dispersos por equipas, os custos de troubleshooting e conformidade aumentam rapidamente.

Agente: orquestração, limites de ferramentas e auditabilidade

Os agentes expandem a inferência para tarefas multi-etapas: planeamento, invocação de ferramentas, operações de memória e geração de próximas ações. Para sistemas empresariais, isto significa que a superfície de risco se expande de “output de texto” para impactos executáveis em sistemas externos.

Os principais pontos de foco na prática incluem:

- Lista branca de ferramentas e privilégio mínimo: Cada ferramenta deve ter escopos de permissões claramente definidos (bases de dados apenas leitura, API restritas, caminhos de ficheiros limitados, etc.) para evitar invocações de ferramentas excessivamente amplas.

- Colaboração homem-máquina e pontos de confirmação: Para ações de alto risco como transferências de fundos, alterações de permissões ou exportações de dados em massa, impor fluxos obrigatórios de confirmação ou aprovação em vez de automação total.

- Estado de sessão e limites de memória: Memória de longo prazo envolve ciclos de privacidade e retenção; o contexto de curto prazo impacta o custo e as estratégias de truncagem. A hierarquização de dados e políticas de limpeza devem estar alinhadas com requisitos de conformidade.

- Trilhas auditáveis: Registar “quando o modelo, com base em que contexto, invocou que ferramentas e o que foi devolvido”; análises de incidentes e inquéritos regulatórios dependem frequentemente disto, não apenas da resposta final.

- Sandbox e isolamento: Execução de código e carregamento de plugins requerem ambientes de runtime isolados para evitar que injeções de prompt escalem para ataques ao nível de execução.

Os agentes proporcionam valor através da automação, mas apenas quando os limites estão claramente definidos. Se os limites forem pouco claros, a complexidade do sistema pode aumentar exponencialmente, e os custos operacionais e legais podem disparar antes de qualquer benefício empresarial ser concretizado.

Segurança e conformidade: o “conjunto mínimo” para lançamento e operação

Os requisitos de conformidade variam consoante o setor, mas os sistemas de produção empresariais devem pelo menos cumprir o seguinte “conjunto mínimo”, expandindo conforme necessário para satisfazer exigências regulatórias.

- Identidade e acesso: Contas de serviço, contas de utilizador, rotação de chaves API e princípio do privilégio mínimo; distinguir entre credenciais de “desenvolvimento/teste” e “invocação de produção”.

- Dados e privacidade: Mascaramento de campos sensíveis, mascaramento de logs, separação de dados de treino e inferência; definir claramente e manter acordos de processamento de dados com fornecedores de modelos externos.

- Cadeia de fornecimento de modelos: Rastreabilidade de fontes de modelos, hashes de versões, dependências e imagens de container; evitar que “pesos desconhecidos” entrem no caminho de produção.

- Segurança de conteúdo e prevenção de abusos

- Aplicar filtragem de políticas a inputs/outputs conforme necessário; implementar limitação de taxa e deteção de anomalias para chamadas automáticas em lote.

- Resposta a incidentes: Reversão de modelos, mudança de routing, revogação de chaves, procedimentos de notificação a clientes; especificar claramente partes responsáveis e caminhos de escalada.

Estas capacidades não substituem a defesa em profundidade da equipa de segurança, mas são essenciais para integrar serviços de IA no quadro existente de gestão de risco da empresa, em vez de os deixar como “exceções de inovação” a longo prazo.

Conclusão

A vantagem competitiva na IA empresarial está a deslocar-se de “se o modelo mais recente pode ser integrado” para “se múltiplos modelos e agentes podem ser operados com custos controláveis e limites seguros”. Isto exige o reforço das camadas de engenharia e governança: routing e libertação, observabilidade e gestão de custos, permissões de ferramentas e trilhas de auditoria devem ser considerados essenciais de produção ao nível dos próprios modelos.

Artigos relacionados

Tokenomics do USD.AI: análise aprofundada dos casos de utilização do token CHIP e dos mecanismos de incentivos

Análise das Fontes de ganhos de USD.AI: como os empréstimos de infraestrutura de IA geram retorno

Render, io.net e Akash: análise comparativa das redes DePIN de poder de hash

A aplicação da Render em IA: como o hashrate descentralizado potencia a inteligência artificial

Análise da arquitetura do protocolo Audiera: funcionamento dos sistemas económicos nativos para agentes