OpenAI Merilis GPT-5.4 Mini dan Nano, Yang Bisa Lebih Berguna Daripada Model Besar

Singkatnya

- OpenAI meluncurkan GPT-5.4 Mini dan Nano, dua model yang lebih cepat dan lebih murah dirancang untuk beban kerja AI dalam volume tinggi.

- Model-model ini mengorbankan sedikit akurasi demi kecepatan dan biaya, menargetkan tugas berulang dan mudah seperti dukungan pelanggan, dan alur kerja otomatis.

- Pengembang kini dapat menjalankan sistem AI hibrida di mana model unggulan merencanakan tugas sementara model yang lebih kecil menangani sebagian besar pekerjaan.

OpenAI tidak melambat. Kurang dari dua minggu setelah meluncurkan GPT-5.4—yang dirilis hanya dua hari setelah GPT-5.3—perusahaan merilis dua model lagi pada hari Selasa: GPT-5.4 Mini dan GPT-5.4 Nano. Ini bukan versi yang dipreteli dari model unggulan—mereka adalah mesin yang dirancang khusus untuk pekerjaan di mana menunggu setengah menit untuk jawaban bukanlah pilihan. OpenAI menyebut mereka sebagai “model kecil paling mampu yang pernah ada,” mengatakan bahwa GPT-5.4 Mini lebih dari dua kali lebih cepat dari GPT-5 Mini. Jika Anda pernah melihat asisten pengkodean berpikir selama 45 detik sebelum mengedit tiga baris kode, maka Anda memahami daya tarik model yang cepat.

Kami memperkenalkan GPT-5.4 mini dan nano, model kecil paling mampu yang pernah ada.

GPT-5.4 mini lebih dari 2x lebih cepat dari GPT-5 mini. Dioptimalkan untuk pengkodean, penggunaan komputer, pemahaman multimodal, dan subagen.

Untuk tugas yang lebih ringan, GPT-5.4 nano adalah yang terkecil dan termurah… pic.twitter.com/cdp5HWtM2M

— Pengembang OpenAI (@OpenAIDevs) 17 Maret 2026

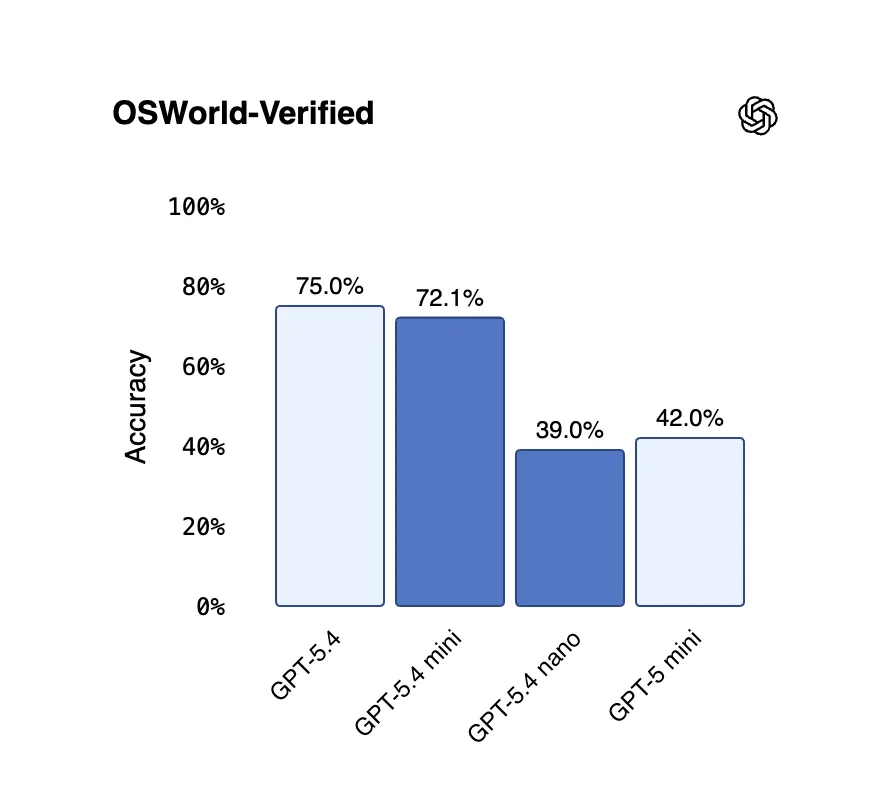

Lalu mengapa ada yang sengaja merilis model yang kurang akurat? Jawaban singkatnya: karena akurasi tidak selalu menjadi hambatan utama. Jika Anda menjalankan chatbot layanan pelanggan yang menjawab 200 pertanyaan yang sama sepanjang hari, Anda tidak membutuhkan model yang mendapatkan skor terbaik di ujian kimia tingkat PhD. Anda membutuhkan yang merespons dalam waktu kurang dari satu detik dan biayanya sepertiga sen per balasan. Itulah ruang di mana model-model ini dibangun. Namun, ini tidak berarti model-model ini bodoh atau tidak dapat diandalkan. Pada tolok ukur pengkodean, GPT-5.4 Mini mendapatkan skor 54,4% di SWE-Bench Pro—tes yang mengukur kemampuan model memperbaiki masalah nyata di GitHub—dibandingkan 45,7% untuk GPT-5 Mini lama dan 57,7% untuk GPT-5.4 lengkap. Di OSWorld-Verified, yang menguji seberapa baik model dapat mengoperasikan komputer desktop dengan membaca tangkapan layar, Mini mencapai 72,1%, sedikit di bawah flagship yang mencapai 75,0%—dan keduanya melampaui baseline manusia sebesar 72,4%. Sementara itu, GPT-5.4 Nano mendapatkan skor 52,4% di SWE-Bench Pro dan 39,0% di OSWorld—lebih rendah dari Mini, tetapi tetap merupakan lonjakan besar dibanding model Nano sebelumnya.

“GPT-5.4 menandai langkah maju bagi model Mini dan Nano dalam evaluasi internal kami,” kata Wakil CTO Perplexity Jerry Ma setelah menguji keduanya. “Mini memberikan penalaran yang kuat, sementara Nano responsif dan efisien untuk alur kerja percakapan langsung.” Alih-alih mengarahkan setiap tugas melalui model flagship yang mahal, Anda sekarang dapat membangun sistem di mana model besar merencanakan dan mengoordinasikan sementara model yang lebih kecil menangani pekerjaan nyata secara paralel—mencari di basis kode di sini, membaca dokumen di sana, atau memproses formulir di tempat lain. Seperti yang kami lihat dalam perbandingan GPT-5.4 vs. Grok 4.20, posisi model dalam alur kerja sama pentingnya dengan model yang Anda pilih. GPT-5.4 Mini berjalan dengan biaya $0,75 per juta token input dan $4,50 per juta token output melalui API. GPT-5.4 Nano bahkan lebih murah: $0,20 per juta token input dan $1,25 per juta token output—harga yang membuat menjalankan banyak query per hari secara finansial realistis untuk startup. Sebagai gambaran, Nano sekitar empat kali lebih murah dari Mini untuk input. Bagi pengguna ChatGPT reguler, GPT-5.4 Mini tersedia hari ini untuk pengguna Free dan Go melalui opsi “Thinking” di menu plus. Pelanggan berbayar yang mencapai batas penggunaan GPT-5.4 mereka akan secara otomatis kembali ke Mini. Sementara itu, GPT-5.4 Nano saat ini hanya melalui API—OpenAI secara jelas menempatkannya sebagai alat pengembang, bukan alat konsumen.