أثارت مبادرة Grammarly لاستخدام خبراء الذكاء الاصطناعي في التدقيق اللغوي جدلاً! حيث انتقدت الأوساط الأكاديمية: لأنها غير مرخصة وتقلد عمدًا عالمًا متوفيًا

أطلقت Grammarly ميزة “مراجعة الخبراء” التي تستخدم الذكاء الاصطناعي لمحاكاة تعليقات الباحثين، مما أثار جدلاً حول الاستخدام غير المصرح به للأسماء والأخلاقيات الأكاديمية.

إطلاق Grammarly لميزة “مراجعة الخبراء” باستخدام الذكاء الاصطناعي يثير تساؤلات الأكاديميين

يواصل أدوات الذكاء الاصطناعي اختراق صناعة الكتابة والبحث، لكن أحدث ميزة “تعليقات الباحثين المحاكاة بواسطة الذكاء الاصطناعي” أثارت نقاشات حادة في الأوساط الأكاديمية حول الأخلاقيات والتصريحات المصرح بها. أطلقت أداة الكتابة الشهيرة Grammarly مؤخرًا ميزة تسمى “Expert Review” تعتمد على الذكاء الاصطناعي، تتيح للمستخدمين أثناء كتابة المستندات أن يحاكي الذكاء الاصطناعي وجهة نظر باحث أو ناقد معين، ويقدم اقتراحات وتعليقات على المحتوى.

تقوم هذه الميزة بتحليل النص الذي يكتبه المستخدم، وتوصي تلقائيًا بـ"خبير" مناسب وفقًا للموضوع، ثم تولد تعليقات باستخدام نماذج اللغة الكبيرة. على سبيل المثال:

- في موضوعات التعليق الإعلامي، قد يستشهد النظام بأسلوب آراء محررة قسم الأخبار السابق في “نيويورك تايمز” مارغريت Sullivan أو الكاتب المخضرم في Politico جاك شافر، لمساعدة المستخدم على تعديل مقاله.

- في قضايا القانون والحكم على الإنترنت، قد يحاكي النظام تحليل أستاذ القانون في جامعة هارفارد لورانس ليسيغ؛ وفي قضايا الأخلاقيات التكنولوجية أو الخصوصية، قد يستشهد بأبحاث الباحثة في أخلاقيات الذكاء الاصطناعي تيمنيت جيبرو أو أستاذ علوم المعلومات في كورنيل تك هيلين نيسنباوم.

تؤكد Grammarly أن هذه الميزة ليست مراجعة حقيقية من قبل هؤلاء الخبراء، وإنما تعتمد على أبحاثهم ومقالاتهم المنشورة، وتولد تعليقات “متأثرة بأفكارهم”. وتوضح أن النظام يختار تلقائيًا باحثين أو نقادًا مؤثرين في المجال وفقًا لموضوع النص، ويحث المستخدمين على قراءة أعمالهم بشكل أوسع.

لكن هذا الأسلوب في التصميم أثار انتقادات واسعة في الأوساط الأكاديمية، خاصة أن بعض الباحثين اكتشفوا أن أسمائهم استُخدمت كأدوار لتعليقات الذكاء الاصطناعي، دون إذن مسبق أو تعاون.

انتقادات لاستخدام الأسماء بدون إذن، وحتى محاكاة الباحثين الراحلين

أكثر النقاط إثارة للجدل في الانتقادات هو احتمال أن يحاكي الذكاء الاصطناعي أساليب تعليقات الباحثين الراحلين. أشار بعض الأكاديميين إلى أن هذا الأسلوب يشبه “إحياء الباحثين رقميًا”، حيث يُستخدم اسمهم لتقييم المحتوى.

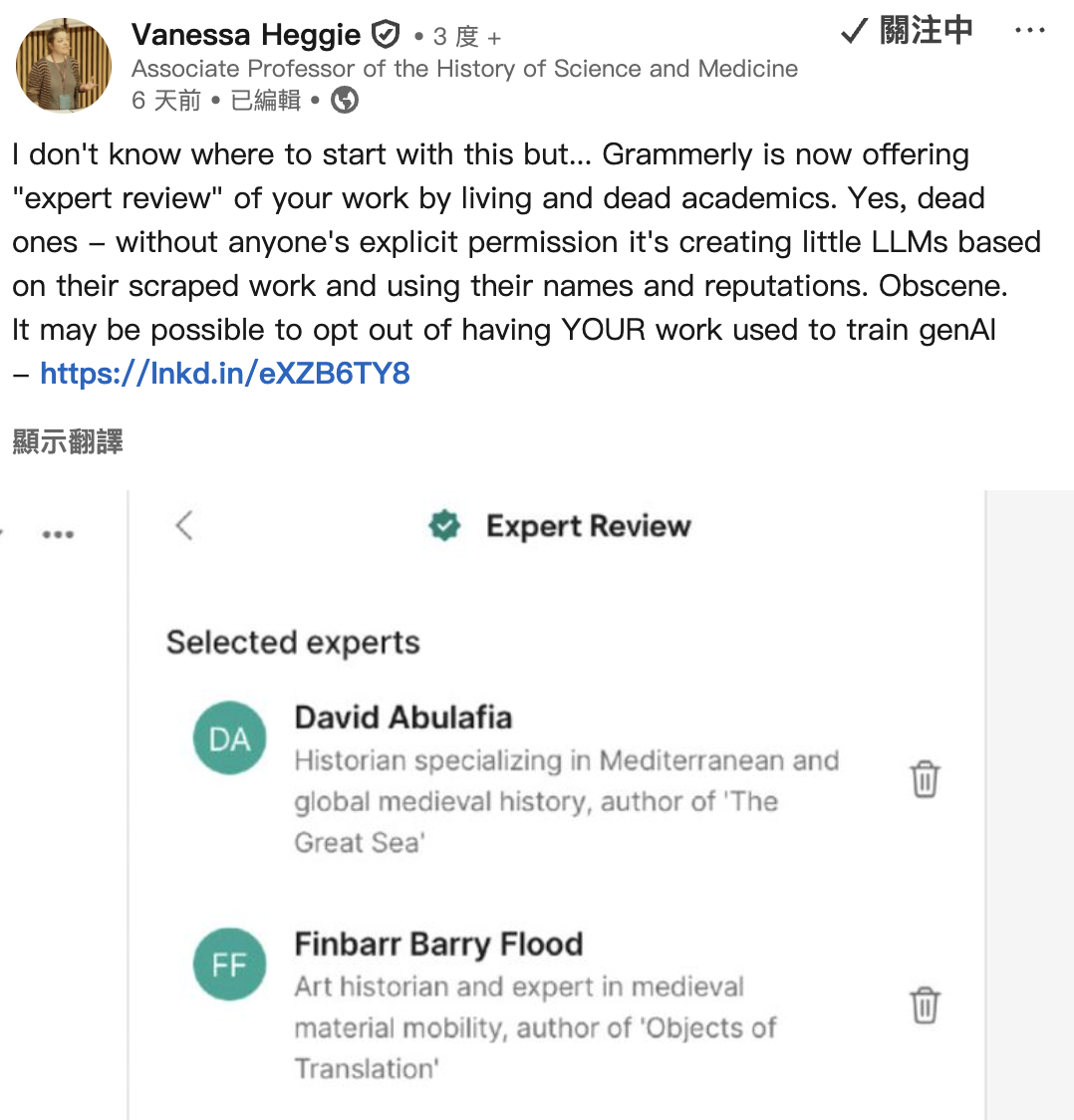

انتقدت البروفيسورة فانيسا هيجي من جامعة برمنغهام في لينكدإن علنًا هذه الميزة، مشيرة إلى أن Grammarly تستخدم نتائج أبحاث الباحثين لبناء نماذج اللغة، وتستخدم أسمائهم وسمعتهم كأدوار لتعليقات الذكاء الاصطناعي. وتساءلت عما إذا كان هؤلاء الباحثون قد منحوا إذنًا للشركة لاستخدام أعمالهم في تدريب النماذج، أو موافقة على تقديم “مراجعة بواسطة الذكاء الاصطناعي” باسمهم.

المصدر: لينكدإن، البروفيسورة فانيسا هيجي من جامعة برمنغهام تنتقد علنًا هذه الميزة

قالت هيجي إن العديد من الباحثين، بل وحتى الراحلين منهم، يُستخدمون كأدوار لتعليقات الذكاء الاصطناعي. وترى أن استغلال أبحاث الباحثين وسمعتهم العلمية لبناء نماذج ذكاء اصطناعي دون موافقتهم أمر غير مقبول على الإطلاق.

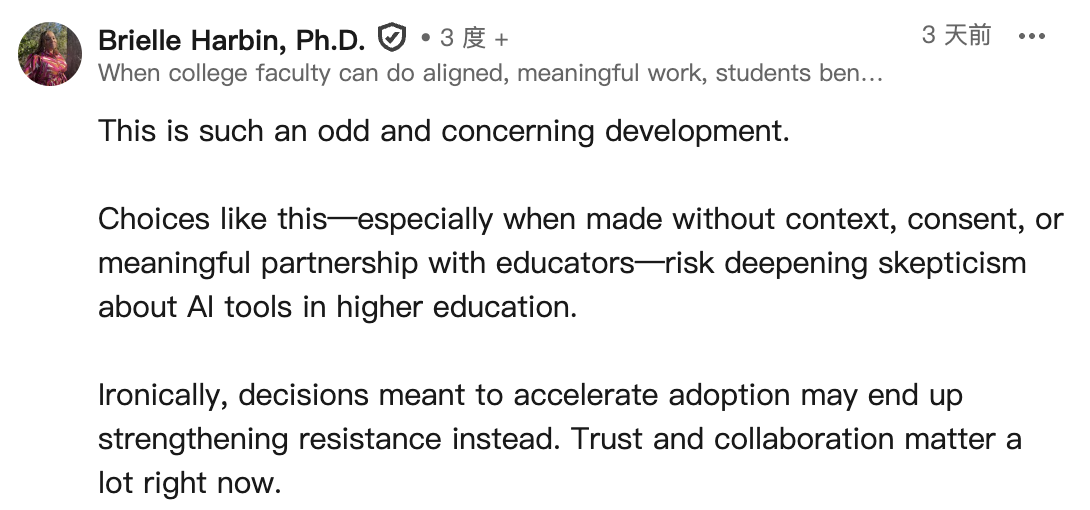

كما أعربت الباحثة السابقة في الأكاديمية البحرية الأمريكية برييل هاربين عن قلقها من هذه الميزة، مشيرة إلى أن بناء نماذج تعليقات باسم الباحثين دون أي توضيح أو إذن أو تعاون، قد يعمق عدم الثقة في أدوات الذكاء الاصطناعي في الأوساط التعليمية.

المصدر: لينكدإن، برييل هاربين، أستاذة العلوم السياسية السابقة في الأكاديمية البحرية الأمريكية، تعبر عن قلقها من هذه الميزة

تعتقد هاربين أن قطاع التعليم العالي لا يزال في مرحلة مراقبة وتقييم أدوات الذكاء الاصطناعي. وإذا تجاهلت الشركات التقنية التعاون مع الأوساط الأكاديمية والأخلاقيات عند تصميم منتجاتها، فإن ذلك قد يؤدي إلى مقاومة أكبر من قبل المجتمع الأكاديمي، بدلاً من تسريع اعتماد الذكاء الاصطناعي.

تحول Grammarly إلى منصة ذكاء اصطناعي، ومساعد الكتابة يتجه نحو وكيل إنتاجي

بدأت Grammarly في عام 2009، وكانت في الأصل أداة مساعدة للغة والنحو باستخدام الذكاء الاصطناعي. ومع التطور السريع لتقنيات الذكاء الاصطناعي التوليدي، قامت الشركة خلال السنوات الأخيرة بتحويل منتجاتها من مجرد مساعد كتابة إلى منصة إنتاجية متعددة الوظائف تعتمد على الذكاء الاصطناعي. في أكتوبر 2025، أعلنت الشركة الأم لـ Grammarly عن إعادة تسمية علامتها التجارية إلى “Superhuman”، مما يرمز إلى أن منتجاتها لم تعد مجرد أدوات تدقيق نحوي، بل أصبحت سلسلة من وكلاء العمل المدعومين بالذكاء الاصطناعي (AI Agents).

توسعت منتجات الشركة الآن لتشمل تطبيقات متنوعة، مثل المساعدة في البحث، وكتابة البريد الإلكتروني، وإدارة الجداول الزمنية، وأتمتة سير العمل. وتعد “Expert Review” واحدة من الخدمات الجديدة التي أطلقتها الشركة كوكيل ذكاء اصطناعي. وتوضح Grammarly أن الهدف من “Expert Review” هو مساعدة الطلاب والباحثين والمهنيين على تحسين جودة كتاباتهم. على سبيل المثال، عند كتابة مقترحات تسويقية، أو تقارير أكاديمية، أو مستندات تجارية، يقوم النظام بتحليل النص وتقديم تعليقات تحاكي خبرة خبراء في المجال.

تؤكد الشركة أن هذه الميزة لا تدعي أن هؤلاء الخبراء شاركوا فعليًا في مراجعة المحتوى، ولا تعني أن الخبراء يوافقون على المحتوى، وإنما تعتمد على تنظيم نتائج أبحاث الباحثين ذات الصلة بواسطة نماذج اللغة الكبيرة، وتقديم اقتراحات.

ومع ذلك، لا تزال طريقة التصميم هذه تتعرض لانتقادات، حيث يُخشى أن تضلل المستخدمين، وتوهمهم أن هذه التعليقات مرتبطة مباشرة بالباحثين أنفسهم.

محاكاة المشاهير عبر الذكاء الاصطناعي تتجه كاتجاه جديد في صناعة التقنية

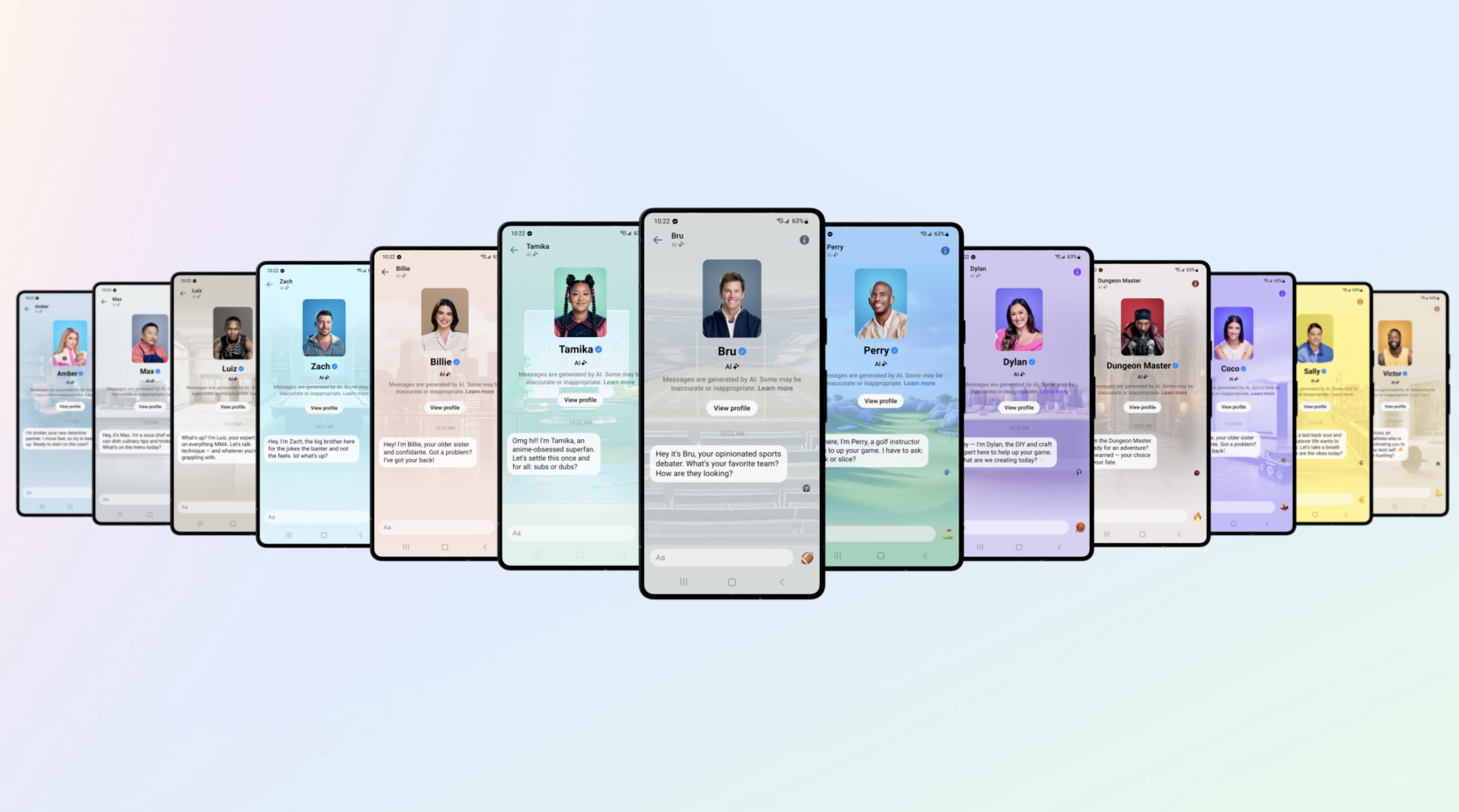

ليست Grammarly الشركة الوحيدة التي تحاول محاكاة المشاهير أو الباحثين باستخدام الذكاء الاصطناعي. ففي السنوات الأخيرة، أطلقت العديد من الشركات التقنية منتجات مماثلة، بهدف استخدام صور شخصيات معروفة لتعزيز تجارب التفاعل مع الذكاء الاصطناعي.

في عام 2023، أطلقت Meta مجموعة من روبوتات الدردشة التي تحاكي مشاهير، بما في ذلك مغني الراب Snoop Dogg، والنجم الرياضي NFL توم برادي، وعارضة الأزياء كندال جينر، ولاعب التنس ناعومي أوساكا. تتفاعل هذه الشخصيات الافتراضية بأسلوب وشخصية المشاهير، لجذب المستخدمين لتجربة خدمات الدردشة مع الذكاء الاصطناعي.

المصدر: Meta، أطلقت مجموعة من روبوتات الدردشة التي تحاكي مشاهير على منصة Meta AI

كما ظهرت أنماط مشابهة في قطاع التعليم. إذ أطلقت منصة Khan Academy التعليمية مساعدها الذكي “Khanmigo”، الذي يتيح للطلاب إجراء حوارات تمثيلية مع شخصيات تاريخية، مثل رئيس وزراء بريطانيا السابق ونستون تشرشل، أو زعيمة السكك الحديدية الأمريكية هارييت توبمان، بهدف فهم الخلفية التاريخية والأفكار.

ومع تزايد قدرة نماذج الذكاء الاصطناعي على تقليد الأساليب الشخصية، تزداد المناقشات حول التصاريح وحقوق الشخصية. يُشير بعض الخبراء إلى أن استخدام أنظمة الذكاء الاصطناعي لشخصيات أكاديمية أو أدبية أو مشهورة لتقديم الآراء قد يؤثر على فهم الجمهور لوجهات نظر تلك الشخصيات. ويعتقد الأكاديميون أنه في المستقبل، قد يتطلب استخدام شركات الذكاء الاصطناعي لأفكار أو صور الباحثين أو المشاهير، آليات تصاريح أكثر وضوحًا وشفافية. وإلا، فحتى لو كانت مجرد “مصدر إلهام”، فإن ذلك قد يثير قضايا تتعلق بالسمعة، وحقوق الملكية الفكرية، والأخلاقيات الأكاديمية، وغيرها من القضايا المعقدة.